Alexa Skills: Was sind die Sicherheitslücken?

In einer Studie zum Alexa-Skill-Ökosystem zeigen Forscher Sicherheitslücken auf. Wo liegen die Gefahren für Nutzer von Amazons Sprach-KI?

Amazons Sprachassistentin Alexa (Guide) beherrscht eine Vielzahl an verschiedenen Funktionen, die den Alltag ihrer Nutzer erleichtern. Per Sprachbefehl stellt sie Timer oder Wecker, ruft den Wetterbericht ab oder übersetzt in viele verschiedene Sprachen. Die Grundfunktionen der Sprach-KI lassen sich zudem um viele nützliche Skills erweitern.

Über 100.000 dieser Erweiterungen sollen laut Amazon bereits erhältlich sein. Vielen Kunden ist dabei nicht immer klar, dass sie durch das Aktivieren der Skills auch Drittanbieter-Dienste nutzen und nicht mehr nur direkt mit Amazons Servern kommunizieren.

Forscher haben nun eine Studie veröffentlicht, in der sie Alexas Skill-Ökosystem auf Privatsphäre und Sicherheit überprüft haben. Dabei erläutern sie detailliert, wie Alexa-Skills funktionieren und welche Methoden Amazon zur Prüfung der Services vor deren Veröffentlichung benutzt.

Was sind Alexa-Skills?

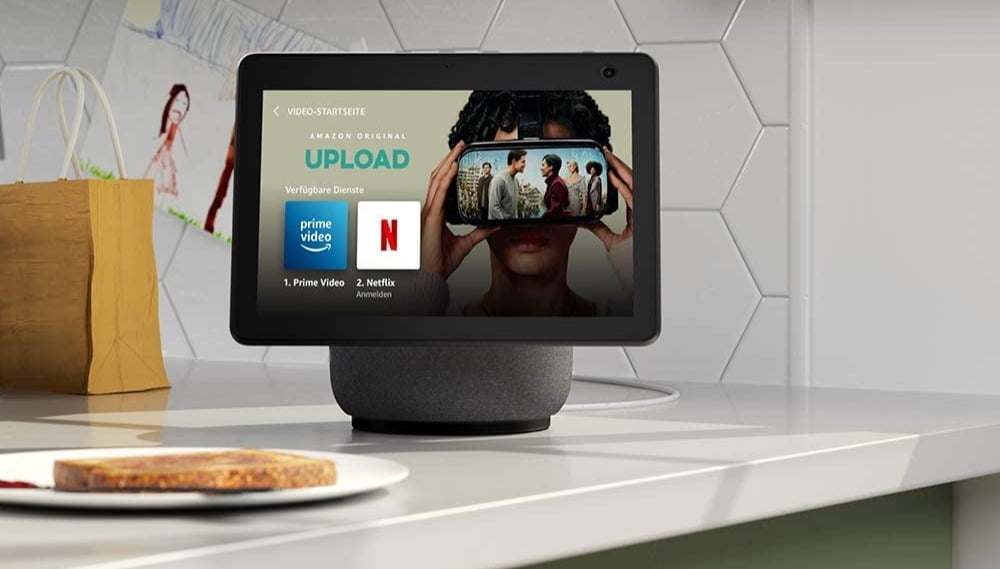

Skills sind verschiedene Anwendungen, die den Funktionsumfang von Amazons Sprachassistentin erweitern. Damit lassen sich beispielsweise Spiele spielen oder Nachrichtendienste, Podcasts und Webradios über Alexa-kompatible Geräte abrufen. Neben Amazon Music sind so auch noch andere Streamingdienste wie Spotify über Alexa (Musik-Guide) nutzbar.

Skills sind vergleichbar mit Smartphone-Apps. Google oder Apple ermöglichen es Entwicklern, unter bestimmten Auflagen ihre Anwendungen in den jeweiligen Android- oder iOS-App-Stores anzubieten. Smartphone-Nutzer laden die Apps dort herunter und installieren sie auf ihrem Gerät.

Das Gleiche gilt für Amazons Skill-Store. Wer ihn über die Alexa-App oder Amazons Website aufruft, findet dort zwei Arten von Skills: Native Skills, die von Amazon selbst entwickelt und angeboten werden und Anwendungen von Drittanbietern. Wie in den App-Stores der Smartphone-Anbieter müssen sich Skill-Entwickler einem Prüfprozess unterziehen, bevor sie ihre Software über Amazon anbieten dürfen.

Skills sind für Nutzer in der Regel kostenlos. Amazon stellt Entwicklern über die Alexa-Developer-Webseite sogar alle nötigen Tools und Dokumentationen kostenlos zur Verfügung, die für die Skill-Entwicklung benötigt werden.

Wie funktionieren Skills?

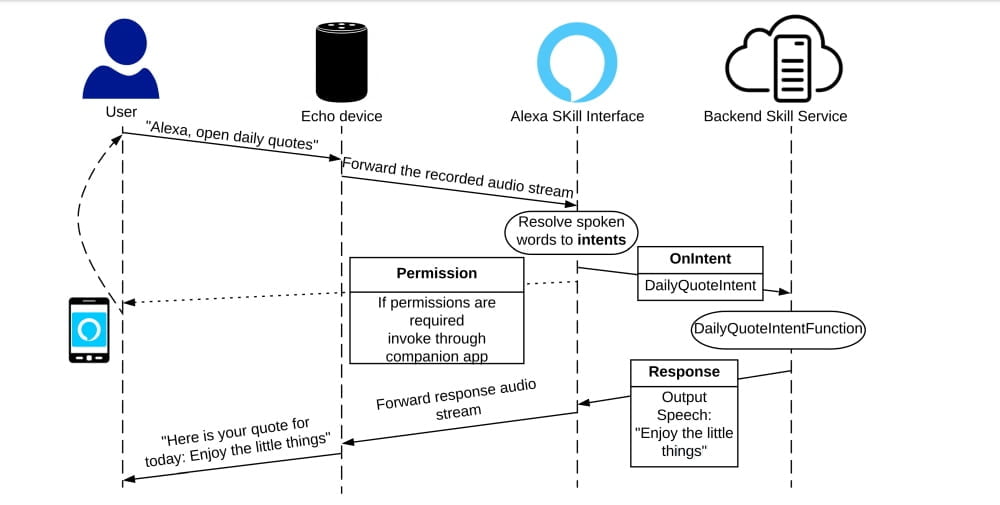

Alexa-Skills funktionieren wie folgt: Nutzer sprechen einen vom Entwickler vorgegebenen Befehl, der wie bei den Standardfunktionen mit dem Signalwort „Alexa“ beginnt. Die daraufhin aufgezeichnete Audiodatei wird in den Alexa Web-Service gestreamt, wo sie durch Amazons Spracherkennungsalgorithmen zur Verarbeitung natürlicher Sprache analysiert werden.

Jeder Skill verfügt über ein eigenes Interaktionsmodell, in dem Wörter und Phrasen definiert werden, die zu einer Aktion führen sollen. Wird eine Skill-Phrase erkannt, erstellt Alexa eine Textdatei im JSON-Format. Diese sendet sie als Anfrage an einen Backend-Server, der vom Entwickler für den entsprechenden Skill registriert wurde. Dort wird die Anfrage verarbeitet und eine entsprechende Antwort erstellt.

Der Skill-Server schickt die zur empfangenen Nutzer-Anfrage passende Antwort zurück an den Alexa-Server. Dort wird sie verarbeitet, mit der bekannten Alexa-Sprachvorlage gerendert und als Aktion an ein Alexa-kompatibles Gerät wie den Smart Speaker Echo 4 (Test) ausgegeben.

Die gesamte Spracherkennung wird dabei in der Alexa-Cloud verarbeitet. Skill-Entwickler erhalten keinen Zugriff auf die aufgezeichneten Audiodaten der Nutzer. Amazon bekräftigt immer wieder, dass Aufzeichnungen sicher auf ihren Servern abgelegt würden.

Zudem bietet der Online-Händler seinen Kunden umfassende Datenschutz-Optionen für Alexa an. Über ein entsprechendes Portal dürfen Alexa-Nutzer sämtliche Sprachfiles anhören, im Textformat einsehen und selbst löschen. Das funktioniert beispielsweise auch über den Sprachbefehl "Alexa, lösche alles, was ich heute gesagt habe".

Wie prüft Amazon Alexa-Skills vor der Veröffentlichung?

Haben Entwickler einen Skill fertiggestellt, müssen sie ihn vor der Veröffentlichung über die Alexa Developer Console einer Verifikation unterziehen. Dort wird überprüft, ob die Anwendung den Alexa-Richtlinien entspricht. Beispielsweise dürfen keine bestehenden Markenrechte verletzt werden, indem Skills geschützte Bezeichnungen verwenden.

Hinzu kommen verschiedene Tests zur Sprachschnittstellenkompatibilität und Grundfunktionalität sowie eine Überprüfung der Sicherheitsanforderungen, falls die Entwickler Services auf externen Servern hosten möchten.

Diese Prüfung entfällt, falls der Amazon Web Service (AWS) verwendet wird. Um die Qualität der Benutzererfahrung zu wahren, werden die Interaktionsmodelle auf Vollständigkeit geprüft und getestet, ob sie nach empfohlenen Vorgehensweisen für Sprachdesign erstellt wurden.

Möchte ein Skill sensible Nutzerdaten wie beispielsweise Standorte oder Kontaktdaten abrufen, muss der Entwickler eine öffentlich zugängliche Datenschutzrichtlinie bereitstellen und den Zweck der Datenerhebung dokumentieren. Der Link zu dieser Richtlinie wird ebenfalls überprüft.

Bemerkt Amazon Unregelmäßigkeiten, werden die entsprechenden Mängel als verdächtig eingestuft und der Skill bekommt keine Freigabe. Besteht die Anwendung sämtliche Tests, erscheint sie offiziell im Alexa Skill-Store. Werden nachträglich Änderungen an der Konfiguration oder dem Interaktionsmodell vorgenommen, muss der gesamte Prozess erneut durchlaufen werden.

Alexa-Skills: Diese Angriffe sind denkbar

Verschiedene Wissenschaftler haben bisher mehrere Methoden aufgezeigt, wie Sprach-KIs ausgetrickst werden könnten. Dies wurde beispielsweise mit synthetisierten Audiosignalen erreicht, die vom menschlichen Gehör nicht wahrgenommen werden. Eine Sprach-KI kann sie jedoch als Befehl annehmen.

Solche Signale können sogar unbemerkt in Songs eingebettet werden. Bislang wurden Attacken dieser Art allerdings nur in Laborumgebungen erfolgreich dokumentiert. Eine größere Gefahr sehen die Forscher in Attacken über das Alexa-Skillsystem.

Ein möglicher Vorgang sei das sogenannte „Skill-Squatting“: Dabei wird eine Art böser Zwillings-Skill erstellt, der einem harmlosen Skill in Design und Interaktionsmodell stark ähnelt. Nutzer könnten versehentlich die falsche Anwendung aktivieren oder durch ähnlich klingende Phrasen ungewollte Aktionen auslösen. Dadurch könnten sensible Informationen wie Kennwörter oder Bankdaten in falsche Hände gelangen.

Wie sicher ist Amazons Skill-Verifizierungs-Prozess?

Das Forschungsteam analysierte Amazons Skill-Registrierungs- und Zertifizierungsprozess, um potenzielle Sicherheitslücken zu identifizieren. Dazu wurde in einem ersten Schritt Alexas Auswahlverfahren geprüft. Die Forscher kamen zu dem Ergebnis, dass die Künstlichen Intelligenz Skills anhand ihrer Bewertungen auswählt.

Haben beispielsweise zwei Anwendungen eine Aktion auf die Anfrage „Alexa, was ist das Zitat des Tages?“ angemeldet öffnet Alexa tendenziell den beliebteren Skill. Gelingt es einem Entwickler, eine Reihe positiver Bewertungen abzugreifen, könnte er das ausnutzen. Vor allem, wenn man bedenkt, dass Amazon zwar keine nachträglichen Änderungen an der Konfiguration des Skills selbst zulässt, wohl aber in dessen Backend-Code.

Angreifer könnten beispielsweise während des Zertifizierungsprozesses beliebig viele Aktionen registrieren – auch inaktive. Diese würden bei der Prüfung nicht kontrolliert und dadurch nicht als verdächtig eingestuft. Wird der Skill daraufhin zugelassen, könnte der Backend-Code nachträglich geändert und somit ruhende Aktionen wieder aktiviert werden.

Phishing-Angriffe sind der Studie nach auch möglich, da Skills unter willkürlichen Entwicklernamen registriert werden dürfen. Obwohl gemäß Alexa-Richtlinien kein gültiges Markenrecht verletzt werden darf, gibt es keine Einschränkungen oder Überprüfungen bei der Entwickler-Namensgebung.

Der wird im Store direkt unter dem entsprechenden Skill-Namen aufgeführt. So könnte beispielsweise eine bösartige Anwendung unter einem vertrauenerweckenden Namen veröffentlicht werden, um Nutzer zu täuschen. Amazons Prüfverfahren des vorgeschriebenen Datenschutzlinks sei den Forschern nach ebenfalls verbesserungswürdig. In 23,3 Prozent der Fälle, bei denen Skills private Nutzerdaten erfassten, lagen unzureichende Datenschutzerklärungen vor.

Gibt es eine reale Bedrohung für Skill-Nutzer?

Die Forscher heben mit ihrer Arbeit mehrere Lücken in Amazons Überprüfungsprozess von Drittanbieter-Skills hervor. Zudem zeigen sie in ihrem Forschungspapier auf, wie Nutzer durch „Skill-Squatting“-Techniken getäuschten werden könnten.

Dennoch wurde kein systematischer Missbrauch durch Skills festgestellt. Es existiert demnach aktuell keine reale Bedrohung für Alexa-Nutzer durch das Aktivieren von Drittanbieter-Skills.

Das Forschungsteam überprüfte über 90.000 Skills in Stores aus sieben verschiedenen Ländern. Die aufgezeigten Sicherheitslücken in Amazons Skill-Ökosystem würden einen Missbrauch allerdings zumindest theoretisch ermöglichen.

Die Forscher mahnen den Online-Riesen deshalb, seinen Validierungsprozess dringend zu überarbeiten. Entwickler sollten sich verifizieren müssen und ihre Skills nicht unter jedem beliebigen Namen veröffentlichen dürfen.

Auch müsse Nutzern schon bei der Aktivierung angezeigt werden, wenn sie Skills nutzen, die auf identische oder ähnliche Sprachbefehle reagieren. Zudem werde aktuell lediglich geprüft, ob die Links zur vorgeschriebenen Datenschutzrichtlinie funktionieren. Der dahinter stehende Inhalt bleibe hingegen unbewertet.

Titelbild: Amazon, Quelle: Ruhr-Universität Bochum

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.