Die Open-Source-Bibliothek LiteLLM, ein beliebter Proxy für KI-Sprachmodell-APIs, wurde über das Python-Paketverzeichnis PyPI mit Schadsoftware infiziert. Laut dem Sicherheitsforscher Callum McMahon von Futuresearch wurden am 24. März 2026 die Versionen 1.82.7 und 1.82.8 kompromittiert, ohne entsprechende Freigabe im offiziellen GitHub-Repository.

Die Schadsoftware stiehlt SSH-Schlüssel, Cloud-Zugangsdaten, Datenbank-Passwörter und Kubernetes-Konfigurationen, verschlüsselt diese und sendet sie an einen fremden Server. Zusätzlich verbreitet sie sich in Kubernetes-Clustern und richtet dauerhafte Hintertürchen ein. Entdeckt wurde der Angriff, als das Paket innerhalb des Code-Editors Cursor abstürzte. Der LiteLLM-Autor selbst sei "sehr wahrscheinlich vollständig kompromittiert", so McMahon. Betroffene sollten sofort alle Zugangsdaten wechseln. Details gibt es bei Github.

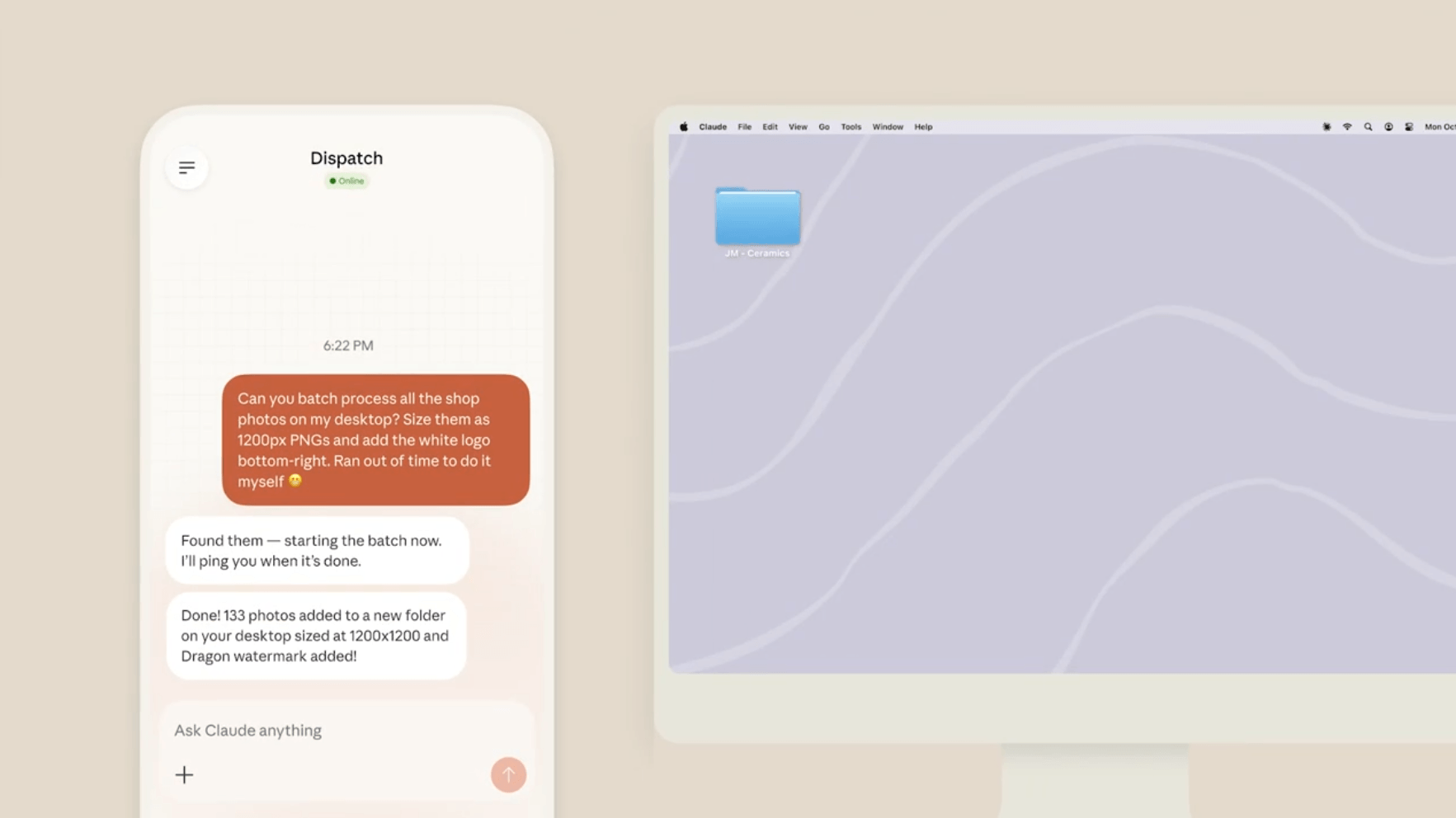

Jim Fan, Director of AI bei NVIDIA, nennt den Vorfall auf LinkedIn "reinen Albtraum-Stoff". KI-Agenten könnten über verseuchte Dateien im Dateisystem manipuliert werden, jede Textdatei im Kontext werde so zum Angriffsvektor und ein kompromittierter Agent könnte den Nutzer auf allen Konten täuschend echt imitieren. Fan empfiehlt, Abhängigkeiten zu minimieren und stattdessen eigene, schlanke Lösungen zu bauen, und prognostiziert eine ganze neue Branche für "De-Vibing": klassische, geprüfte Software, die als Schutzschicht um KI-Agenten gelegt wird.