Künstliche Intelligenz übersetzt Hirnsignale in verständliche Sätze

Einem Forscherteam der Universität von Kalifornien, San Francisco gelang es mittels Künstlicher Intelligenz, Hirnsignale beim Sprechen in recht gut verständliche synthetische Sätze zu übersetzen. Die Technologie soll eines Tages gelähmten Menschen beim Kommunizieren helfen oder das Diktieren von Sätzen direkt aus dem Gehirn ermöglichen. Der Nachteil der Technologie: Sie setzt ein Hirnimplantat voraus.

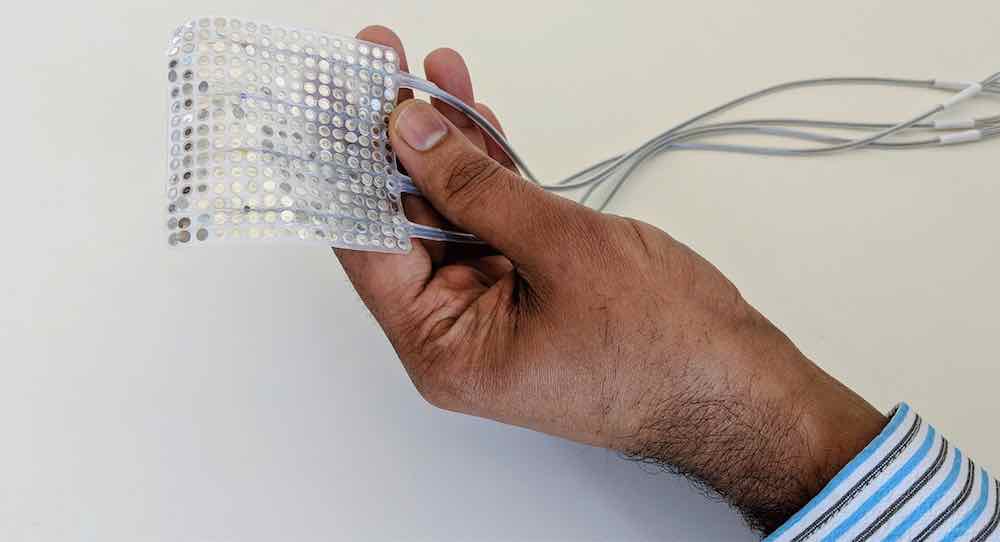

Der Neurochirurg Edward Chang und sein Team ließen fünf Epilepsiepatienten 100 Sätze sprechen und nahmen dabei deren Hirnsignale mit Hilfe einer Elektroden-Hirnauflage (siehe Titelbild) auf. Den Epilektikern wurde das Gerät zuvor für andere Forschungszwecke ins Gehirn implantiert.

Die beim Sprechen aufgezeichneten Hirnsignale wurden von einem KI-gestützten Computermodell des menschlichen Sprechapparats analysiert und übersetzt. Hierbei kamen halbwegs verständliche Sätze heraus, wie die folgenden zwei Beispiele zeigen. Auf den Beispielsatz folgt jeweils das synthetisierte Ergebnis.

Das Computermodell besteht aus zwei vorab trainierten künstlichen neuronalen Netzen: Das erste entschlüsselt die Hirnaktivität, das zweite synthetisiert das Ergebnis zu einem Satz.

Tests ergaben, dass durchschnittlich 50 bis 70 Prozent der Worte verständlich sind. Würde man die Elektroden nicht nur auf die Gehirnoberfläche legen, sondern direkt ins Hirngewebe implantieren, seien noch bessere Resultate zu erwarten, sagt ein Forscher der Universität von Pittsburgh gegenüber Technology Review.

Facebook forscht an nicht-invasiven Hirn-Computer-Interfaces

Das von den Forscher vorgestellte Hirn-Computer-Interface ist kein Gedankenlesegerät. Es übersetzt vielmehr die feinmotorischen Hirnsignale, die beim Sprechen an die entsprechenden Organe übermittelt werden.

Deshalb ist noch unklar, wie gut die Technologie funktionieren würde, wenn die Patienten gar nicht erst in der Lage wären, ihren Mund zu bewegen. Sprachen die Patienten die Sätze lautlos, fielen die Ergebnisse weitaus schlechter aus. Ein dichteres Elektrodengeflecht und ein besseres KI-Modell könnten die Resultate verbessern.

Facebook fördert die Forschung der Universität an Hirn-Computer-Interfaces, soll die vorliegende Arbeit jedoch nicht mitfinanziert haben. Das Unternehmen forscht selbst an ähnlichen Technologien und bezeichnet das implantierte System als einen Schritt in Richtung einer Technologie für Endverbraucher.

"Facebook entwickelt keine Produkte, die Hirn-Implantate voraussetzen, aber die vorliegende Arbeit könnten die Forschung an nicht-invasiven Technologien voranbringen", sagt das Unternehmen in einer Stellungnahme.

Aktuell

Angesagt

- Auf Vibe-Coding folgt Vibe-Design: Googles KI-Tool Stitch wandelt Text in Interfaces

- OpenClaw-RL: Forscher wollen KI-Agenten allein durch Nutzung verbessern

- OpenAI bringt GPT-5.4 mini und nano: Schneller, fähiger, aber auch deutlich teurer

- Google zeigt neue Vibe-Coding-App für die App-Entwicklung mit natürlicher Sprache

- Kampf gegen OpenAI und Anthropic: Cursor bringt neues KI-Modell für Programmierer

Alles was

wichtig ist

Die wichtigsten KI-Themen der Woche auf einen Blick.

Dauer

Brenner

- Autonomer KI-Agent startet Rufmordkampagne gegen Open-Source-Entwickler

- Google-Ingenieurin: Claude Code erzeugte in einer Stunde, woran Google ein Jahr baute

- Autonome Fahrzeuge lassen sich durch einfache Schilder in Fußgänger steuern

- KI-Entwickler Andrej Karpathy revidiert Meinung zu KI-Agenten: Von "funktionieren nicht" zu 80 Prozent KI-Coding in nur drei Monaten

- Neuer Anthropic-Prompt lässt ChatGPT und Co. das gesammelte Wissen über Nutzer verraten

- KI enttarnt Internetnutzer in wenigen Minuten für nur wenige Dollar

KI-Community

& Insights

The Decoder

Folgen Sie The Decoder für KI-News, Hintergründe und Analysen.