Roboter müssen nicht zu Killermaschinen werden, um eine Gefahr für Menschen darzustellen. Manchmal reicht schon eine Zurückweisung. Das fanden neuseeländische Forscher in einem Experiment heraus.

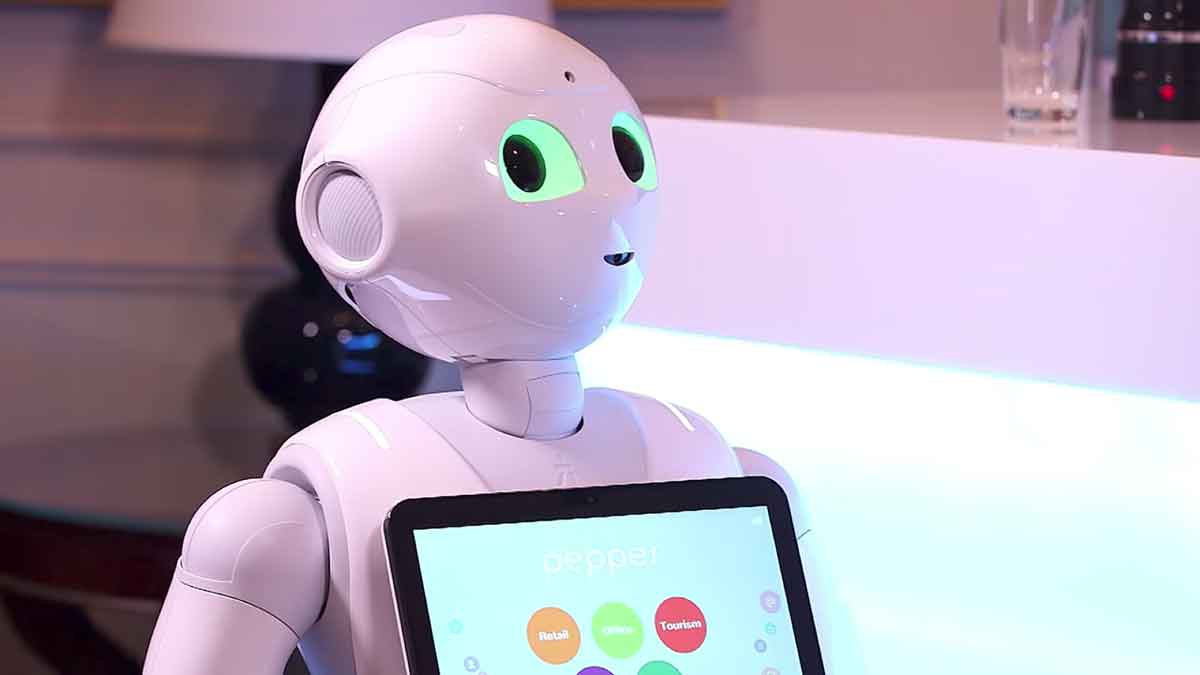

In einer nicht allzu fernen Zukunft könnten KI-gesteuerte Roboter eine alltägliche Erscheinung sein. Hochentwickelt genug, könnten sie Menschen Gesellschaft leisten und damit soziale Rollen übernehmen. Eine solche Aufgabe geht mit einer zusätzlichen Verantwortung einher, da Menschen nicht nur körperlich, sondern auch seelisch verletzt werden können.

Doch wieso sollte man den Worten eines Roboters überhaupt Bedeutung beimessen? Schließlich sind es keine Menschen, sondern Maschinen. Dass Menschen dennoch auf soziales Verhalten von Robotern reagieren, zeigt eine Studie von Forschern der Universität von Canterbury.

"Vier gewinnt" spielen mit einem Roboter

Sie luden 147 Freiwillige ein, mit einem 1,80 Meter großen Roboter namens Baxter "Vier gewinnt" zu spielen. Nach Ablauf einer bestimmten Zeit klopften die Forscher an der Tür. Für den Roboter bedeutete dieses Zeichen, dass das Spiel vorbei ist. Zum Abschied zeigte der Roboter eine von drei einprogrammierten Reaktionen.

Die erste Reaktion drückt soziale Akzeptanz aus. Der Roboter sagte zum menschlichen Gegenüber: "Das hat Spaß gemacht, ich würde gerne wieder mit dir spielen. Ich wünsche dir einen schönen Tag und auf Wiedersehen." Die zweite Reaktion war neutraler. Der Roboter sagte bloß: "Ich wünsche dir einen schönen Tag und auf Wiedersehen."

Die dritte Reaktion sollte soziale Zurückweisung ausdrücken: "Das war langweilig, mit dir will ich nicht mehr spielen. Auf Wiedersehen". Nach dem Spiel ermittelten die Forscher, ob das Verhalten des Roboters auf das Selbstwertgefühl der Studienteilnehmer Einfluss nahm.

Roboter brauchen soziale Intelligenz

Bei den Spielern, die mit der ersten und zweiten Reaktion des Roboters konfrontiert wurden, konnten die Forscher keine nennenswerte Veränderung des Selbstwertgefühls feststellen. Bei Studienteilnehmern, die eine Zurückweisung durch den Roboter erlebten, fiel die Selbstachtung hingegen beträchtlich. Ein Mitwirkender soll sogar so wütend geworden sein, dass er den Roboter anschrie und beschimpfte.

"Wir könnten eines Tages soziale Roboter bauen, die einsamen Menschen Gesellschaft leisten. Wenn Roboter unbeabsichtigt Menschen zurückweisen, die soziale Nähe suchen, könnte das das Selbstwertgefühl der betroffenen Personen mindern", schreiben die Forscher. Für KI-Entwickler könnte das in Zukunft eine besonders schwierige Aufgabe sein: Sie müssen Maschinen mit sozialer Intelligenz und Taktgefühl bauen.

Wer sich in die Studie der Forscher einlesen möchte, findet sie hier.