Deepmind hat womöglich eine Lösung für das KI-Bild-Problem

Google Deepmind stellt mit SynthID ein Verfahren vor, das KI-Bilder zuverlässig kennzeichnen und als solche erkennbar machen soll.

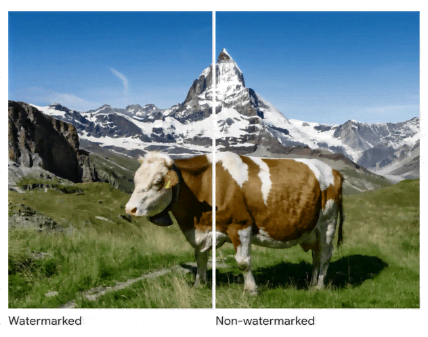

Synth ID ist ein Werkzeug, das KI-generierte Bilder mit einem unsichtbaren Wasserzeichen versehen kann. Dieses Wasserzeichen kann von Maschinen, aber nicht von Menschen gesehen werden.

Als Beweis zeigt Deepmind im eigenen Blog Bilder, bei denen die mit dem Wasserzeichen markierte Bildhälfte genauso aussieht wie die ohne Wasserzeichen - nur für den Fall, dass man es nicht glaubt.

Die Markierung wird laut Deepmind "direkt in die Pixel" des KI-generierten Bildes geschrieben, was sie robust gegenüber Bildmanipulationen wie Zuschneiden, Filtern, Farbänderungen, hoher Kompression und anderen für Web-Bilder typischen Eingriffen machen soll.

SynthID verwendet zwei Deep-Learning-Modelle, um das Wasserzeichen zu erzeugen und zu erkennen. Deepmind geht nicht ins Detail, wie SynthID funktioniert, um das Risiko von Umgehungsmethoden zu minimieren.

Google Imagen mit exklusivem SynthID-Start

Bei der Erkennung gibt SynthID drei Wahrscheinlichkeitsstufen aus: Der Marker wurde erkannt, er wurde nicht erkannt oder er wurde möglicherweise erkannt. Die letzte Meldung ist mit einer Warnung verbunden, dass das Bild von einer künstlichen Intelligenz erzeugt worden sein könnte.

Deepmind will SynthID zunächst für Googles Bild-KI Imagen ausrollen, die derzeit in einer Testversion verfügbar ist. Sollte sich das Verfahren bewähren, könnte es "in naher Zukunft" auch für andere Systeme verfügbar gemacht werden. Zudem sei SynthID kompatibel mit Erkennungsverfahren, die Bilder über Metadaten authentifizieren sollen.

"Wir hoffen, dass unsere SynthID-Technologie mit einer breiten Palette von Lösungen für Kreative und Nutzer in der gesamten Gesellschaft zusammenarbeiten kann", schreibt Deepmind.

Ein Forschungsteam des Computer Science and Artificial Intelligence Laboratory (CSAIL) des Massachusetts Institute of Technology (MIT) stellte kürzlich mit "PhotoGuard" ein ebenfalls KI-basiertes Bilderkennungsverfahren vor, das durch Pixelmanipulation KI-Bilder nachverfolgbar machen soll. Allerdings räumten die Forschenden hier ein, dass Bildmanipulationen wie Beschneiden, Hinzufügen von Rauschen oder Drehen das System ablenken könnten.

KI-Bilderkennung hat in den vergangenen Monaten durch die ersten politischen Manipulationsversuche an Relevanz gewonnen. Neueste Modelle wie Midjourney können realistische Fotos von berühmten Personen generieren. So gingen etwa gefälschte KI-Bilder von Donald Trump in Handschellen um die Welt.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.