Anthropic nutzt fragwürdiges Dark Pattern für Zustimmung zur KI-Datennutzung

Anthropics neue Datenrichtlinie nutzt rechtlich fragwürdiges Dark Pattern.

Anthropic stellt seine Datenschutzpraxis für die KI-Chatplattform Claude um – und fordert von Nutzerinnen und Nutzern der Consumer-Produkte (Claude Free, Pro, Max sowie Claude Code) nun eine Entscheidung: Wer nicht bis zum 28. September 2025 aktiv widerspricht, erlaubt dem Unternehmen, neue sowie wiederaufgenommene Chats für das KI-Training zu verwenden. Bei Zustimmung verlängert sich zudem die Speicherfrist von 30 Tagen auf bis zu fünf Jahre. Unternehmens-, Bildungs-, Regierungs- und API-Konten sind davon ausgenommen.

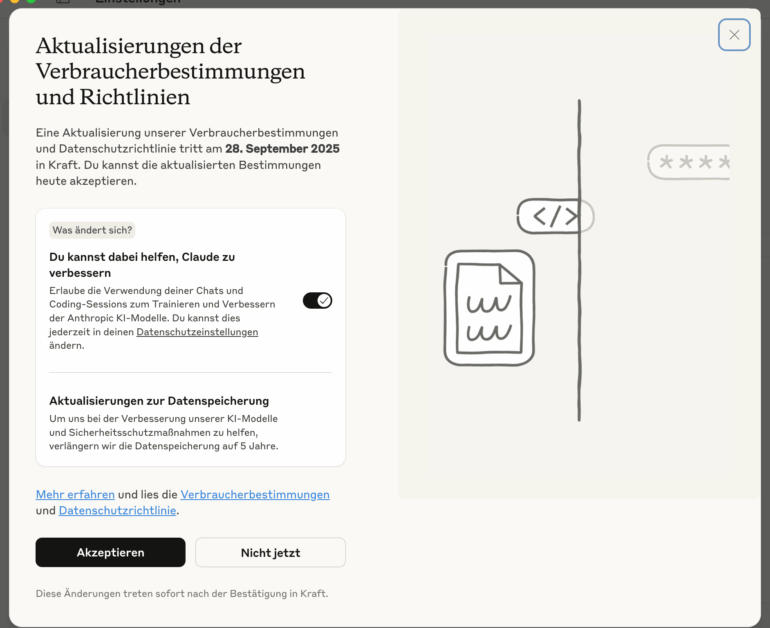

Bei der Umstellung seiner Datenschutzpraxis setzt Anthropic auf ein manipulatives Interface-Design, ein sogenanntes Dark Pattern. Bestehenden Claude-Nutzern wird ein Pop-up mit einem dominanten, schwarz hinterlegten "Akzeptieren"-Button präsentiert, während der Schalter zur Freigabe der Daten für das KI-Training klein und standardmäßig aktiviert ist. Diese Gestaltung, wie sie im Screenshot zu sehen ist, zielt darauf ab, die schnelle, unüberlegte Zustimmung der Nutzer auszunutzen.

Das zugrunde liegende Prinzip – voreingestellte Trainingsfreigabe mit Opt-out – ist nicht neu. OpenAI geht bei ChatGPT ähnlich vor: Auch dort ist die Option, Nutzereingaben für das Modelltraining zu verwenden, standardmäßig aktiviert und muss manuell deaktiviert werden. Während OpenAI dieses Muster von Beginn an still etabliert hat, führt Anthropic die Trainingsnutzung jetzt neu ein und muss daher eine aktive Einwilligung einholen.

Neue Richtlinie, altes Muster – mit Dark Patterns

Claude setzt dafür auf ein auffälliges Pop-up mit einem großflächigen, schwarz hinterlegten „Akzeptieren“-Button. Der Schalter zur Datenfreigabe ist unauffällig platziert, standardmäßig aktiviert und mit positivem Framing („Du kannst helfen…“) versehen. Ein blasser „Nicht jetzt“-Button und schwer auffindbare Hinweise zur späteren Änderung der Einstellung runden das manipulative Interface ab.

Solche Interface-Tricks – auch als Dark Patterns bekannt – sind laut Datenschutz-Grundverordnung (DSGVO) und dem Europäischen Gerichtshof unzulässig, wenn es um die Einholung einer Einwilligung zur Datenverarbeitung geht. Vorangekreuzte Kästchen gelten demnach nicht als gültige Zustimmung.

Auch der Europäische Datenschutzausschuss (EDPB) hat in seinen Leitlinien zu "deceptive design patterns" betont, dass eine Einwilligung freiwillig, informiert und eindeutig sein muss. Das aktuelle Design von Claude untergräbt diese Anforderungen recht deutlich. Anthropic könnte daher schon bald ins Visier von Datenschützern geraten.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.