OpenAIs neue Video-App Sora gerät wegen "AI Slop"-Vorwürfen in die Kritik

Mit der neuen KI-App Sora bietet OpenAI einen personalisierten Kurzvideo-Feed an, der langfristig nützlich sein soll. Kritiker sehen darin vor allem den Beginn eines neuen Sucht-Feeds mit minderwertigen KI-Inhalten, sogenanntem "AI Slop". Auch CEO Sam Altman räumt dieses Risiko ein.

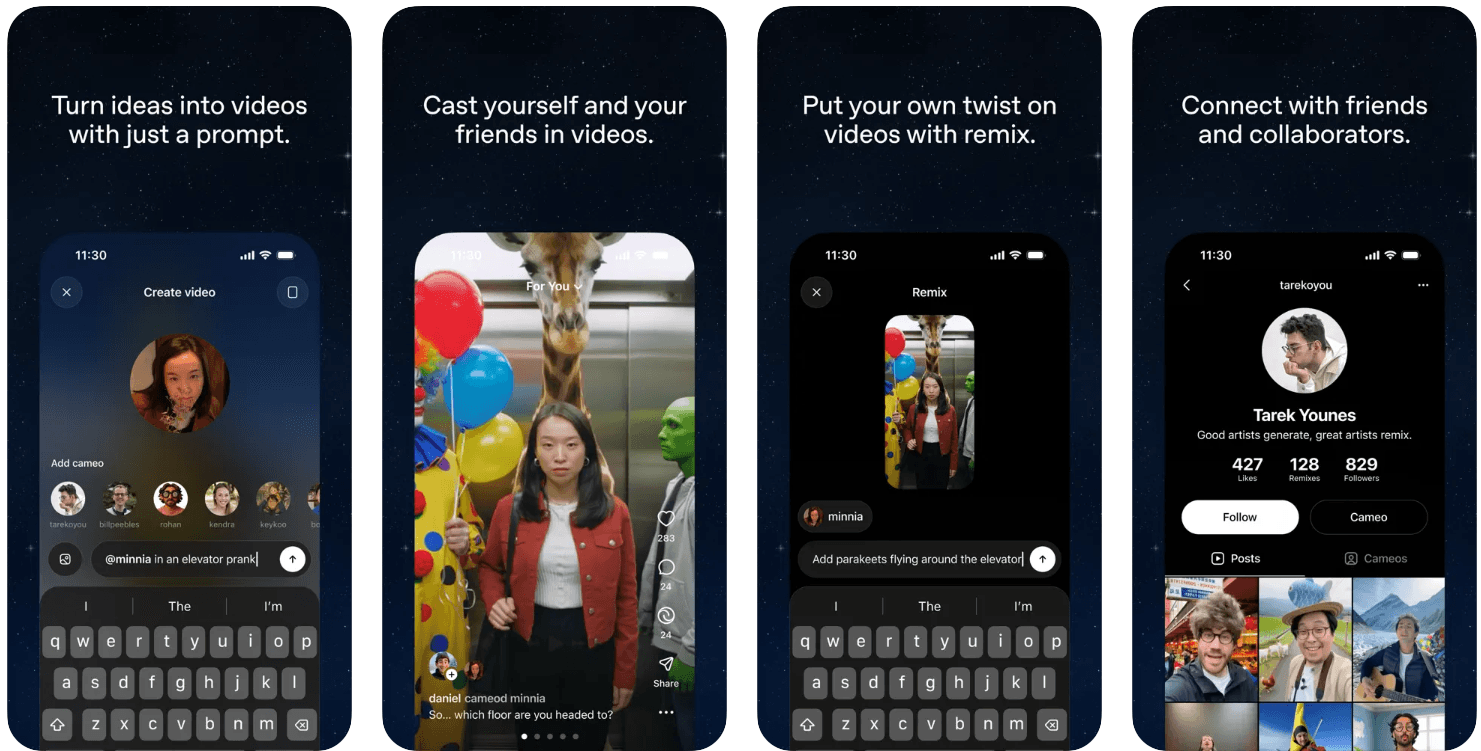

OpenAI hat mit Sora eine neue App veröffentlicht, in der Nutzer:innen kurze Videos mit Hilfe des neuen Videomodells Sora 2 erstellen und teilen können. Eine zentrale Funktion ist "Cameo": Nutzer:innen können sich selbst oder Freunde direkt als Hauptfiguren in die KI-generierten Clips einfügen. Die App zielt auf ein breites Publikum, das an personalisierten, leicht konsumierbaren Inhalten interessiert ist.

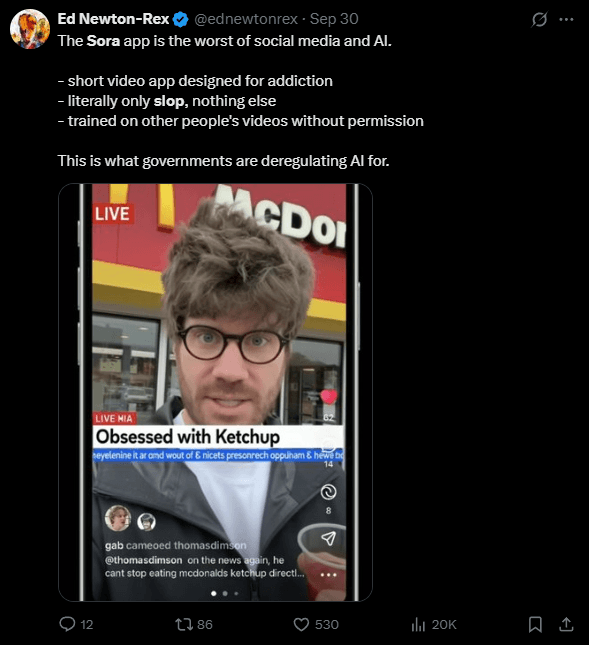

Kritik aus der KI-Community: "AI Slop" statt Fortschritt

Kurz nach dem Start wurde Sora zum Ziel scharfer Kritik auch aus der KI-Community. Der Vorwurf: Die App produziere primär sogenannten "AI Slop": generischen, oberflächlichen Content, der wenig kreativen oder informativen Mehrwert biete.

Gemeint sind Inhalte, die algorithmisch auf maximale Reaktion getrimmt sind, dabei aber oft austauschbar und substanzlos wirken. Das Format orientiert sich dabei stark an bestehenden Kurzvideo-Plattformen wie TikTok.

OpenAI-Chef Sam Altman hatte die erwartbare Kritik bereits in einem Statement antizipiert. Dort beschreibt er das Risiko eines "degenerierten Falls der KI-Videogenerierung, in dem wir alle in einen RL-optimierten Schrott-Feed hineingesogen werden".

Altman spielt damit auf sogenannte Reinforcement-Learning-Optimierungen an, bei denen Inhalte algorithmisch auf maximales Engagement ausgerichtet werden, oft zulasten von Qualität und Vielfalt. Die Gefahr sei real, heißt es, aber man wolle bewusst gegensteuern.

Sora solle nicht auf kurzfristige Aufmerksamkeit optimiert werden, sondern auf "langfristige Nutzerzufriedenheit". Nutzer:innen sollen ihren Feed gezielt anpassen können – etwa nach Stimmung, Interessen oder persönlichen Zielen. Die App solle Menschen dabei helfen,"ihre wahren Ziele" zu erreichen: etwa Muskelaufbau, berufliche Selbstverwirklichung oder soziale Vernetzung.

Typische Mechanismen – mit anderen Zielen?

Gleichzeitig setzt Sora auf genau jene Elemente, die in vergleichbaren Plattformen oft kritisiert werden: starke Personalisierung, emotionale Ansprache und soziale Interaktionsfeatures. Diese Mechanismen gelten als zentral für die Entstehung suchtähnlichen Nutzerverhaltens.

Der Zielkonflikt zwischen Anspruch und technischer Umsetzung wird damit offenkundig: Die App will Nutzer:innen beim Erreichen langfristiger Ziele unterstützen, nutzt aber Designprinzipien, die auf kurzfristige Belohnung ausgelegt sind.

Altman kündigt an, Sora kritisch zu evaluieren. Sollte sich in den kommenden Monaten herausstellen, dass die Mehrheit der Nutzer:innen durch die App keine positive Veränderung ihrer Lebensqualität erfährt, will OpenAI "weitreichende Maßnahmen" ergreifen.

Diese reichten von tiefgreifenden Änderungen bis hin zur vollständigen Einstellung der App. Was als Verbesserung der Lebensqualität gilt, beschreibt Altman so: Die Nutzer:innen sollen das Gefühl haben, "dass ihr Leben durch die Nutzung von Sora besser ist, als es ohne die App gewesen wäre".

Und Altman relativiert bereits: "Wenn Sie [die Nutzer] wirklich nur doomscrollen und wütend sein wollen, dann ist das okay – wir helfen Ihnen dabei." Damit öffnet er bereits die Tür für eine Nutzung, die dem zuvor formulierten Anspruch widerspricht und schiebt die Verantwortung auf die Nutzer:innen.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.