ChatGPT als Suchmaschine für Arbeitsdaten: OpenAI führt "Company Knowledge" ein

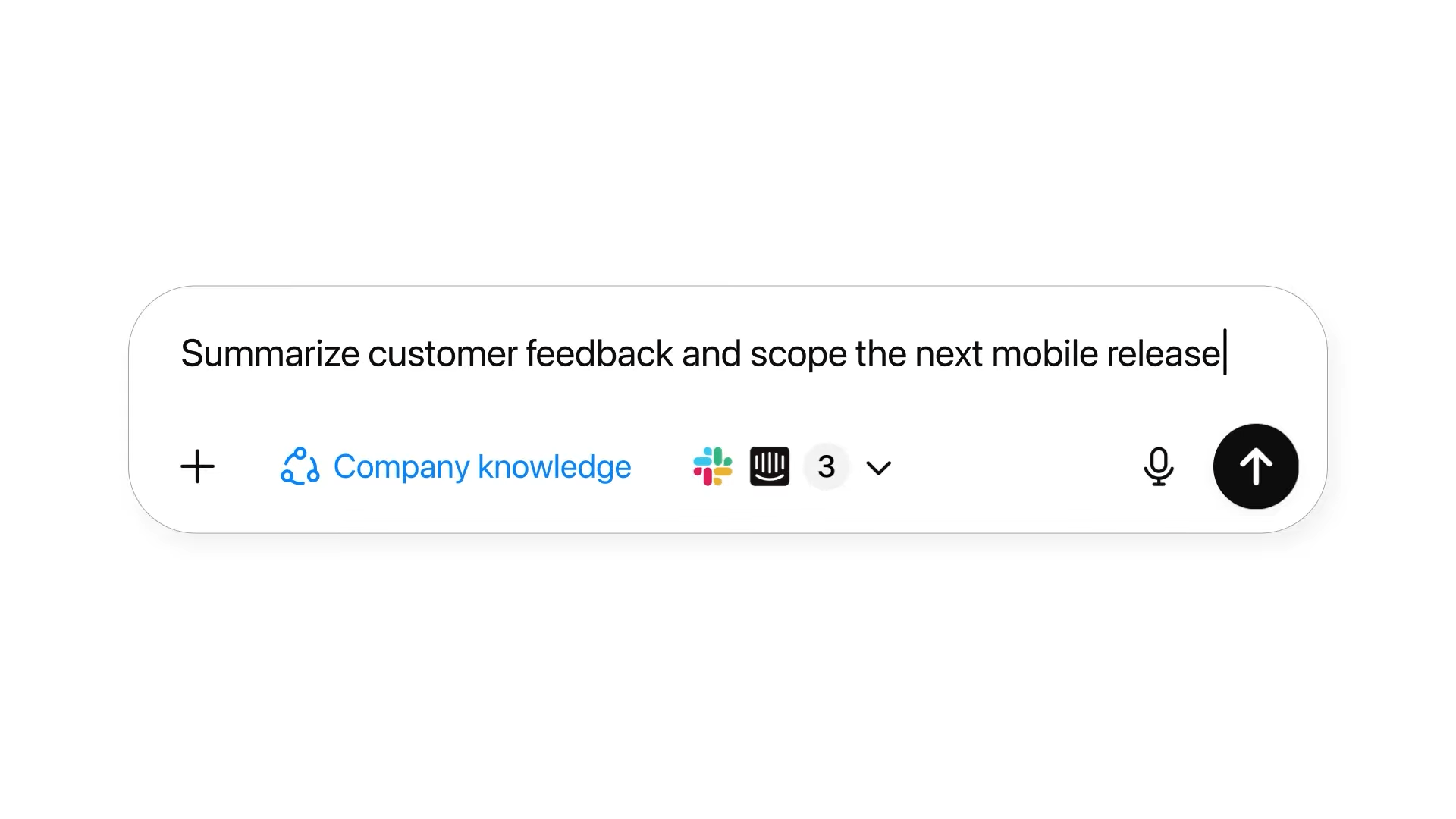

OpenAI hat mit "Company Knowledge" eine neue Funktion für ChatGPT vorgestellt, die Business-, Enterprise- und Education-Nutzern erlaubt, auf Daten aus Slack, SharePoint, Google Drive und GitHub zuzugreifen.

Die Funktion basiert auf GPT-5 und soll ChatGPT als Suchmaschine für Arbeitsdaten etablieren. Antworten enthalten laut OpenAI Quellenangaben und können auch vage formulierte Fragen auflösen. Die Funktion muss manuell aktiviert werden und unterstützt weder Websuche noch die Erstellung von Bildern oder Diagrammen.

LLMs sind als allgegenwärtige Zitiermaschine noch ungeeignet

In der Theorie ist eine Funktion wie "Company Knowledge" hilfreich – in der Praxis wird sich zeigen müssen, ob Systeme wie ChatGPT mit derart umfangreichen, offenen Datenquellen zuverlässig umgehen können. Besonders das gleichzeitige Zitieren aus mehreren Quellen gilt als technisch anspruchsvoll und birgt das Risiko von unklaren oder fehlerhaften Informationen – sogenanntem KI-"Workslop", der laut einer Studie Unternehmen bereits Geld kostet.

Die Praxis zeigt bislang, dass LLMs besonders dann wirkungsvoll sind, wenn sie mit klar umrissenen Aufgaben in einem festen Kontext arbeiten oder für explorative Suchvorgänge eingesetzt werden – etwa, um relevante Quellen überhaupt erst sichtbar zu machen. Beim Zitieren machen alle Systeme Fehler, sei es durch ungenaue Angaben, ausgelassene Inhalte oder falsch verstandene Aussagen im Kontext.

Studien zeigen außerdem, dass irrelevante Informationen in langen Kontexten die Modellleistung deutlich verschlechtern. Deshalb gewinnt das sogenannte "Context Engineering" an Bedeutung: Die Auswahl, Struktur und Länge des Kontexts beeinflussen die Qualität der Antworten direkt. Zu viel, zu wenig oder falsch platzierter Kontext kann das Modell aus dem Tritt bringen oder unnötige Kosten verursachen. Auch Google-DeepMind-Forscher Nikolay Savinov betont, es sei besser, den Kontext gezielt zu wählen.

Wer solche Systeme im Unternehmen ausrollt, sollte also zumindest seine Angestellten über deren Schwächen aufklären. Menschliches Fachwissen und Prüfung bleiben unerlässlich, denn die Verlockung ist groß, sich vollständig auf die Maschine zu verlassen. Beim aktuellen Stand der Technik führt das jedoch unweigerlich zu Fehlern. OpenAI erwähnt dieses Risiko in seiner offiziellen Ankündigung mit keiner Silbe.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.