Neues KI-Gedächtnis GAM soll den "Context Rot" bei langen Chats verhindern

Ein chinesisches Forschungsteam hat eine neue Speicherarchitektur für KI-Agenten entwickelt. "GAM" soll Informationsverlust bei langen Interaktionen minimieren, indem es Kompression mit Deep Research kombiniert.

Das Gedächtnis ist eine der größten Schwachstellen aktueller KI-Agenten. Werden Konversationen oder Aufgaben zu lang, stoßen die Modelle an die Grenzen ihrer Kontextfenster oder verlieren in der Menge der Daten den Überblick. Dieses Phänomen ist in der Fachwelt als "Context Rot" bekannt.

In einer neuen Forschungsarbeit stellen Wissenschaftler von Universitäten aus China und Hongkong nun das "General Agentic Memory", kurz GAM, vor. Das Framework soll das Problem lösen, indem es das Prinzip der "Just-in-Time Compilation" auf KI-Gedächtnisse anwendet, ein Verfahren aus der Softwareentwicklung, bei dem Programmcode erst im Moment der Ausführung für die jeweilige Situation optimiert wird.

Bisherige Ansätze verlassen sich oft auf statische Zusammenfassungen, die im Vorfeld erstellt werden. Laut den Forschern führt diese Kompression jedoch zwangsläufig zu Informationsverlusten. Details, die zum Zeitpunkt der Speicherung unwichtig erschienen, könnten später entscheidend sein, sind dann aber bereits wegoptimiert.

Zwei Agenten verwalten das Gedächtnis

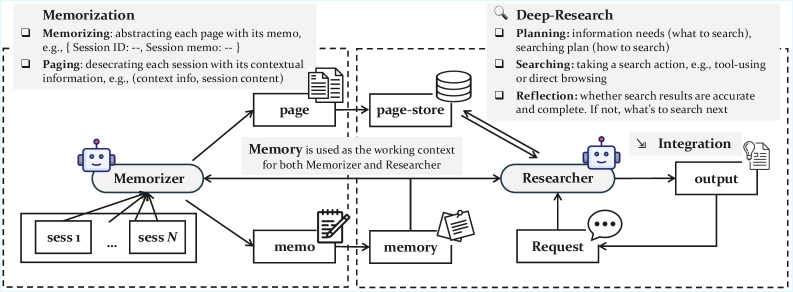

GAM setzt stattdessen auf eine duale Architektur, die aus zwei spezialisierten Komponenten besteht. Diese nennen die Autoren "Memorizer" und "Researcher".

Der Memorizer arbeitet im Hintergrund, während die Interaktion läuft. Er erstellt zwar ebenfalls leichte Zusammenfassungen der Ereignisse, speichert aber parallel dazu die vollständige Historie in einer Datenbank, dem sogenannten "Page-Store". Dabei werden einzelne Gesprächsabschnitte in Seiten unterteilt und mit Kontextinformationen angereichert, um sie später besser auffindbar zu machen.

Der Researcher wird aktiv, sobald eine konkrete Anfrage an den Agenten gestellt wird. Anstatt einfach nur im Gedächtnis nachzuschlagen, führt er eine Deep Research durch. Er analysiert die Anfrage, plant eine Suchstrategie und nutzt verschiedene Werkzeuge, um im Page-Store die relevanten Informationen zu finden.

Dazu stehen dem Researcher drei Methoden zur Verfügung. Er kann eine Vektorsuche für thematische Ähnlichkeiten nutzen, eine BM25-Suche für exakte Schlüsselwörter anwenden oder direkt über Seiten-IDs auf Inhalte zugreifen. Der Prozess ist iterativ gestaltet. Der Agent prüft seine Suchergebnisse und reflektiert, ob die Informationen ausreichen. Bei Bedarf startet er neue Suchanfragen, bevor er die Antwort generiert.

Hohe Genauigkeit bei komplexen Aufgaben

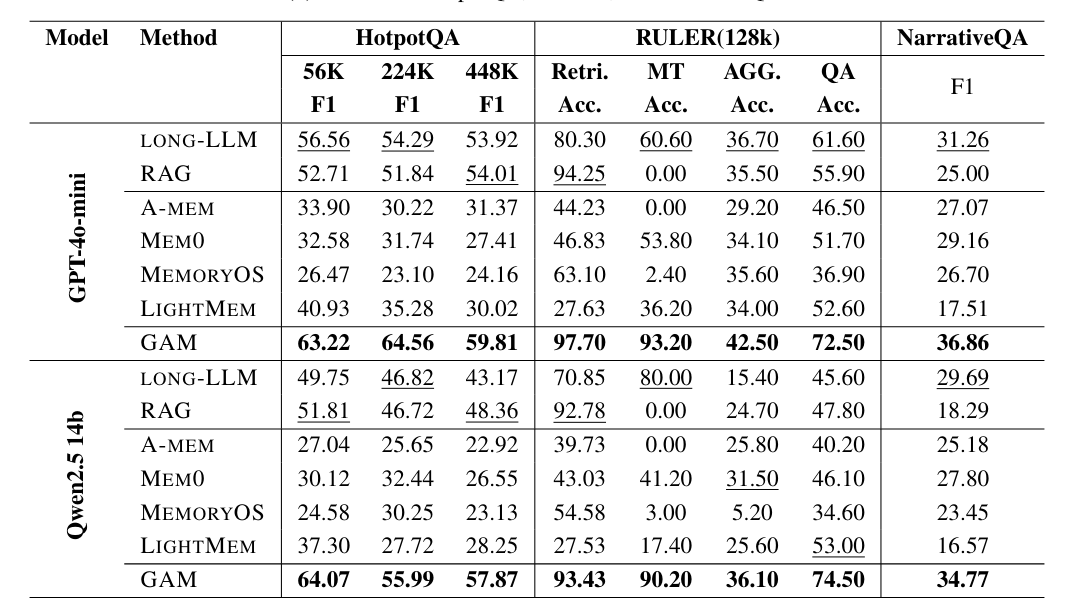

In Experimenten verglich das Team GAM mit herkömmlichen Methoden wie Retrieval-Augmented Generation, Modellen mit extrem langen Kontextfenstern sowie anderen Speicher-Ansätzen wie Mem0 oder MemoryOS. Als Basismodelle dienten GPT-4o-mini und Qwen2.5-14B.

Laut dem Paper übertraf GAM die Vergleichssysteme in allen getesteten Benchmarks. Besonders deutlich war der Vorsprung bei Aufgaben, die das Verknüpfen von Informationen über lange Zeiträume erfordern. Im Benchmark RULER, der unter anderem das Nachverfolgen von Variablen über viele Schritte testet, erreichte GAM eine Genauigkeit von mehr als 90 Prozent. Herkömmliche RAG-Ansätze und andere Speichersysteme versagten in diesem Szenario fast vollständig.

Die Forscher führen dies darauf zurück, dass GAM durch die iterative Suche in der vollständigen Historie auch versteckte Details finden kann, die in komprimierten Zusammenfassungen fehlen würden. Zudem zeigte sich, dass das System von mehr Rechenzeit profitiert. Erlaubt man dem Researcher mehr Suchschritte und Reflektionen zur Laufzeit, steigt die Qualität der Antworten weiter an.

Der Code und die Daten für das Projekt wurden auf GitHub veröffentlicht.

Das KI-Gedächtnis entwickelt sich weiter

Vor kurzem lenkte Anthropic den Fokus auf das "Context Engineering", um die begrenzte Aufmerksamkeit von KI-Modellen effizienter zu nutzen. Statt nur Prompts zu optimieren, wird dabei der gesamte Kontext-Zustand aktiv kuratiert, etwa durch kompakte Zusammenfassungen oder strukturierte Notizen außerhalb des eigentlichen Fensters, damit Agenten auch langfristig den Überblick behalten.

Passend dazu hat Deepseek ein neues OCR-System vorgestellt, das Textdokumente als hochkomprimierte Bilder verarbeitet. Dieser Ansatz spart massiv Rechenleistung und Token und könnte laut den Entwicklern auch als effizienter Langzeitspeicher für Chatbots dienen, indem ältere Konversationsteile einfach als kompakte Bilddateien abgelegt werden.

Forschende aus Shanghai haben außerdem die Vision eines "Semantic Operating System" als lebenslanges Gedächtnis für KI skizziert. Dieses System soll Kontext nicht nur speichern, sondern wie das menschliche Gehirn aktiv verwalten, Wissen anpassen und gezielt vergessen, um flüchtige Informationen in dauerhafte, strukturierte Erinnerungen umzuwandeln.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.