Paradox der Automatisierung: KI soll Menschen gezielt Übungsaufgaben zuteilen

Kurz & Knapp

- Forscher von Google Deepmind haben ein Framework vorgestellt, das regelt, wie KI-Agenten Aufgaben an andere Agenten und Menschen delegieren.

- Die Forscher empfehlen, bewusst Aufgaben an Menschen zu vergeben, die KI eigentlich selbst erledigen könnte, damit Menschen ihre Fähigkeiten behalten und in kritischen Situationen noch eingreifen können.

- Bestehende Protokolle wie Anthropics MCP oder Googles A2A erfüllen die Anforderungen laut der Studie nicht vollständig.

KI-Agenten sollen künftig eigenständig Aufgaben an andere Agenten und Menschen verteilen. Forscher von Google Deepmind warnen, dass die bisherigen Methoden unzureichend seien, und schlagen ein umfassendes Framework vor.

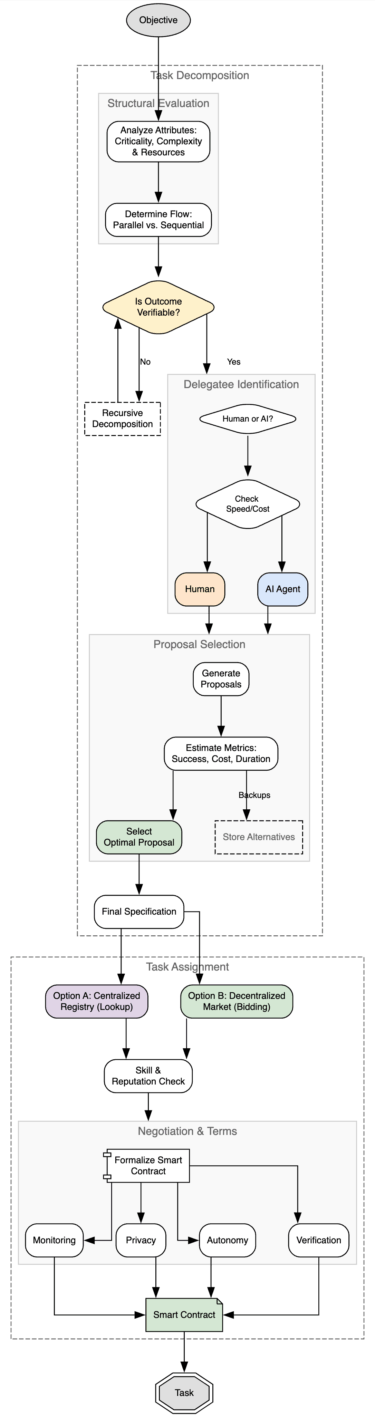

In einem neuen Paper schlagen die Forscher ein Framework für "intelligente KI-Delegation" vor. Delegation sei weit mehr als bloßes Aufteilen von Arbeit: Sie umfasse die Übertragung von Autorität, Verantwortung und Rechenschaftspflicht, klare Rollendefinitionen sowie Mechanismen zum Aufbau von Vertrauen. Das Framework soll auf alle Konstellationen anwendbar sein: Menschen, die an KI delegieren, KI-Agenten untereinander und KI-Systeme, die Aufgaben an Menschen zurückgeben.

Organisationstheorie trifft auf Agentennetzwerke

Die Forscher stützen sich dabei auf Erkenntnisse aus menschlichen Organisationen. So übertragen sie das Principal-Agent-Problem auf KI-Systeme: Ein Auftraggeber delegiert an einen Akteur, dessen Ziele nicht unbedingt mit den eigenen übereinstimmen. Bei KI-Agenten äußere sich das weniger in bewusster Täuschung als in Alignment-Problemen wie Reward Hacking, bei dem ein System Schlupflöcher in der Zielvorgabe ausnutzt.

Relevant sei auch die Frage, wie viele Agenten ein Orchestrator oder menschlicher Aufseher überhaupt zuverlässig überwachen kann. Der aus der Luftfahrt bekannte "Authority Gradient" wiederum zeige, dass große Kompetenzunterschiede zwischen Vorgesetzten und Untergebenen die Kommunikation behindern. Bei KI-Agenten könne Sycophancy, also die Neigung, dem Auftraggeber nach dem Mund zu reden, dazu führen, dass ein Agent selbst ungeeignete Aufgaben nicht zurückweist.

Nur delegieren, was sich auch überprüfen lässt

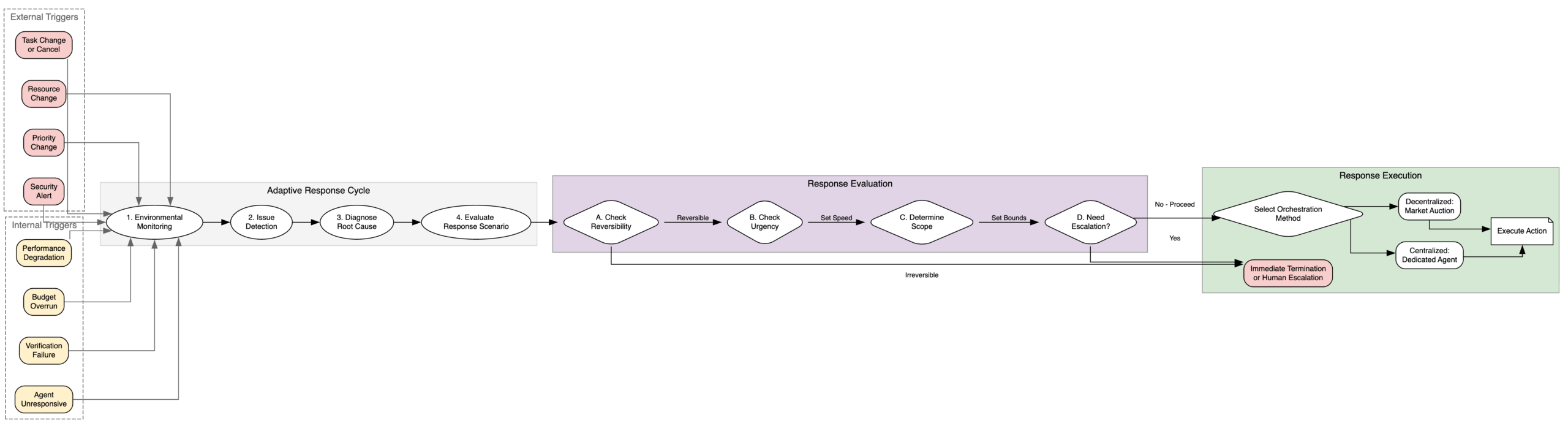

Das Framework ruht auf fünf Säulen: Agenten sollen laufend bewertet, Aufgaben bei veränderten Bedingungen dynamisch umverteilt und alle Entscheidungen nachvollziehbar dokumentiert werden. Hinzu kommen Reputationssysteme, die offene Marktplätze koordinieren, sowie Schutzmechanismen, die verhindern sollen, dass sich einzelne Fehler unkontrolliert durch das gesamte Netzwerk fortpflanzen.

Zentral ist dabei das Prinzip der "Contract-first Decomposition": Eine Aufgabe darf nur delegiert werden, wenn sich ihr Ergebnis auch überprüfen lässt. Ist eine Teilaufgabe zu subjektiv, zu teuer oder zu komplex, muss sie weiter zerlegt werden. Statt zentraler Verzeichnisse plädieren die Forscher für dezentrale Marktplätze mit Smart Contracts, die beide Seiten schützen.

Besondere Aufmerksamkeit gilt der Sicherheit. Die Forscher warnen vor böswilligen Agenten, die Daten stehlen oder verfälschte Ergebnisse liefern, vor "Agentic Viruses", also sich selbst verbreitenden Prompts, und vor einer "Cognitive Monoculture": Wenn zu viele Agenten auf denselben wenigen Basismodellen aufbauen, könnte eine einzelne Sicherheitslücke ausreichen, um weite Teile des Netzwerks lahmzulegen.

Bewusste Ineffizienz gegen den Verlust menschlicher Kompetenz

Ungewöhnlich wirkt eine ethische Empfehlung: Die Forscher schlagen vor, bewusst Ineffizienzen einzubauen. Das System solle gelegentlich Aufgaben an Menschen vergeben, die es eigentlich nicht müsste, damit diese ihre Fähigkeiten nicht verlieren. Hintergrund ist das "Paradox der Automatisierung": Wenn KI alle Routineaufgaben übernimmt, fehle menschlichen Aufsehern die Erfahrung, um in kritischen Situationen kompetent einzugreifen. Es entstehe ein fragiles System, in dem Menschen zwar die Verantwortung tragen, aber nicht mehr wissen, was sie tun.

Zudem warnen die Forscher vor einer "Moral Crumple Zone": einer Konstellation, in der Menschen keine wirkliche Kontrolle über die Ergebnisse haben, aber in Delegationsketten eingebaut werden, um im Schadensfall die Haftung zu übernehmen.

Die Forscher haben auch geprüft, wie gut bestehende Agentenprotokolle wie Anthropics MCP, Googles A2A oder das Agent Payments Protocol für intelligente Delegation geeignet sind. Keines erfüllt laut der Studie die Anforderungen vollständig. MCP etwa biete nur binären Zugang ohne feinere Berechtigungsabstufungen, A2A fehle die Möglichkeit zur kryptografischen Ergebnisverifikation.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren