Alibabas offene Qwen-3.5-Modellreihe liefert mehr Leistung bei weniger Rechenaufwand

Alibaba hat die neue Qwen-3.5-Modellreihe erweitert. Sie umfasst jetzt vier Modelle: Qwen3.5-Flash, Qwen3.5-35B-A3B, Qwen3.5-122B-A10B und Qwen3.5-27B. Laut Alibaba liefern die Modelle mehr Leistung bei weniger Rechenaufwand. Sie verarbeiten Text, Bilder und Video als Eingabe und geben Text aus. Zuerst wurde Mitte Februar Qwen3.5-397B-A17B vorgestellt.

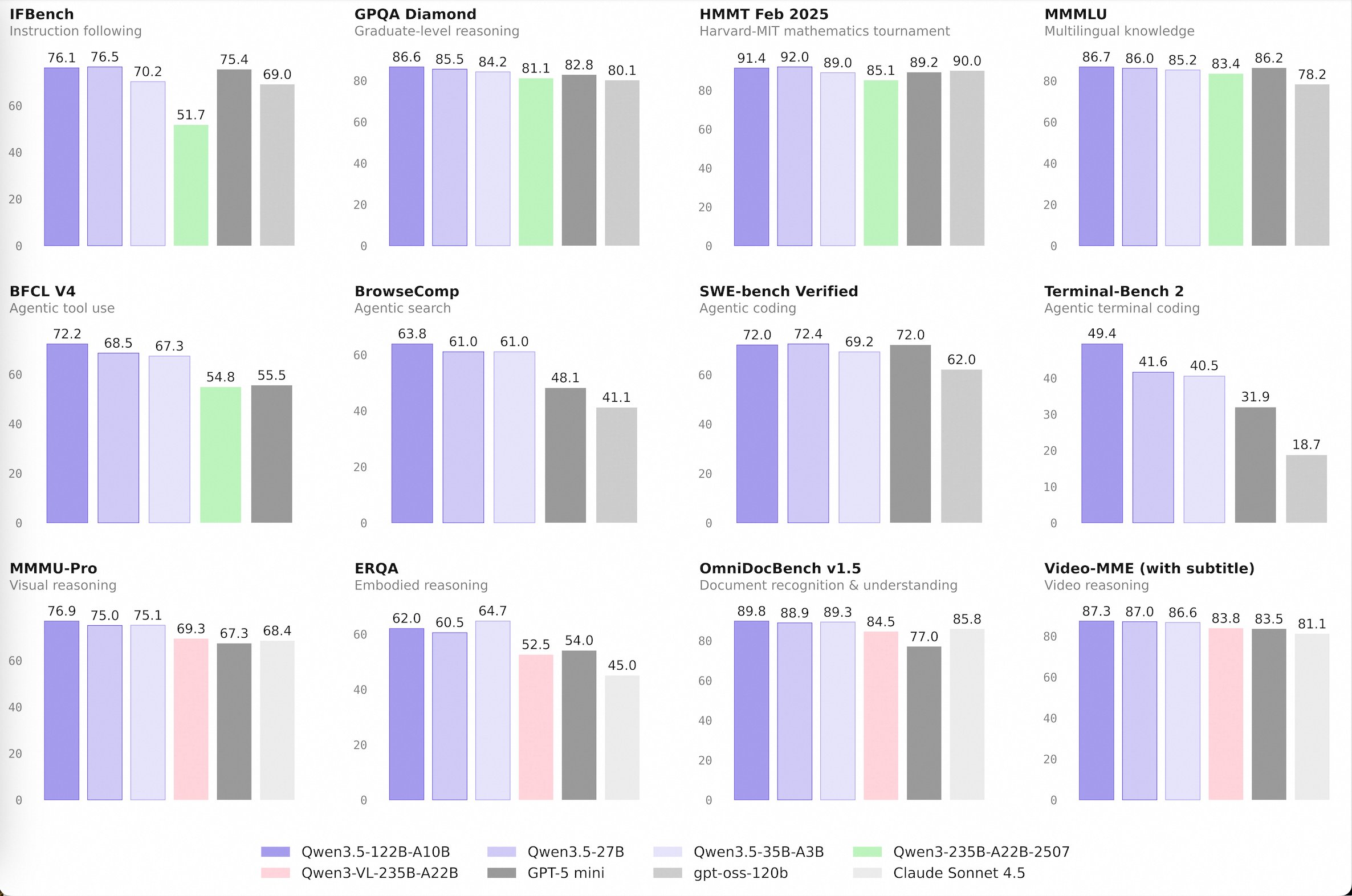

Das kleinere Modell Qwen3.5-35B-A3B übertrifft demnach das deutlich größere Vorgängermodell Qwen3-235B-A22B – ein Hinweis darauf, dass bessere Architektur, Datenqualität und Reinforcement Learning wichtiger sind als reine Modellgröße. Die größeren Varianten 122B und 27B sollen den Abstand zu Spitzenmodellen weiter verringern, besonders bei komplexen Agentenszenarien.

Alle Modelle sind auf Hugging Face, ModelScope und über Qwen Chat verfügbar. Sie stehen unter der Apache License 2.0, einer freizügigen Open-Source-Lizenz, die kommerzielle Nutzung, Veränderung und Weiterverbreitung erlaubt. Qwen3.5-Flash ist die gehostete Produktionsversion mit einer Kontextlänge von einer Million Token und eingebauten Tools. Der API-Preis liegt bei 0,10 Dollar pro Million Input-Token und 0,40 Dollar pro Million Output-Token.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren