KI-Fakes, gesperrte Satellitenbilder, gefälschte OSINT-Accounts: Der Iran-Krieg im Informationsnebel

Kurz & Knapp

- Die New York Times hat in den ersten zwei Wochen des US-Iran-Konflikts über 110 KI-generierte Fake-Bilder und -Videos identifiziert, die ein Millionenpublikum erreichten – die Mehrheit dient laut Analyseunternehmen Cyabra pro-iranischer Propaganda.

- Satellitenanbieter wie Planet Labs verlängerten die Bildverzögerung für die Region von vier Tagen auf zwei Wochen, was unabhängige Überprüfungen erschwert und KI-Fakes den Weg ebnet.

- Auch deutsche Medien wie Spiegel, Zeit und Süddeutsche Zeitung veröffentlichten KI-generierte Bilder, die über ein iranisches Agenturnetzwerk eingeschleust worden waren.

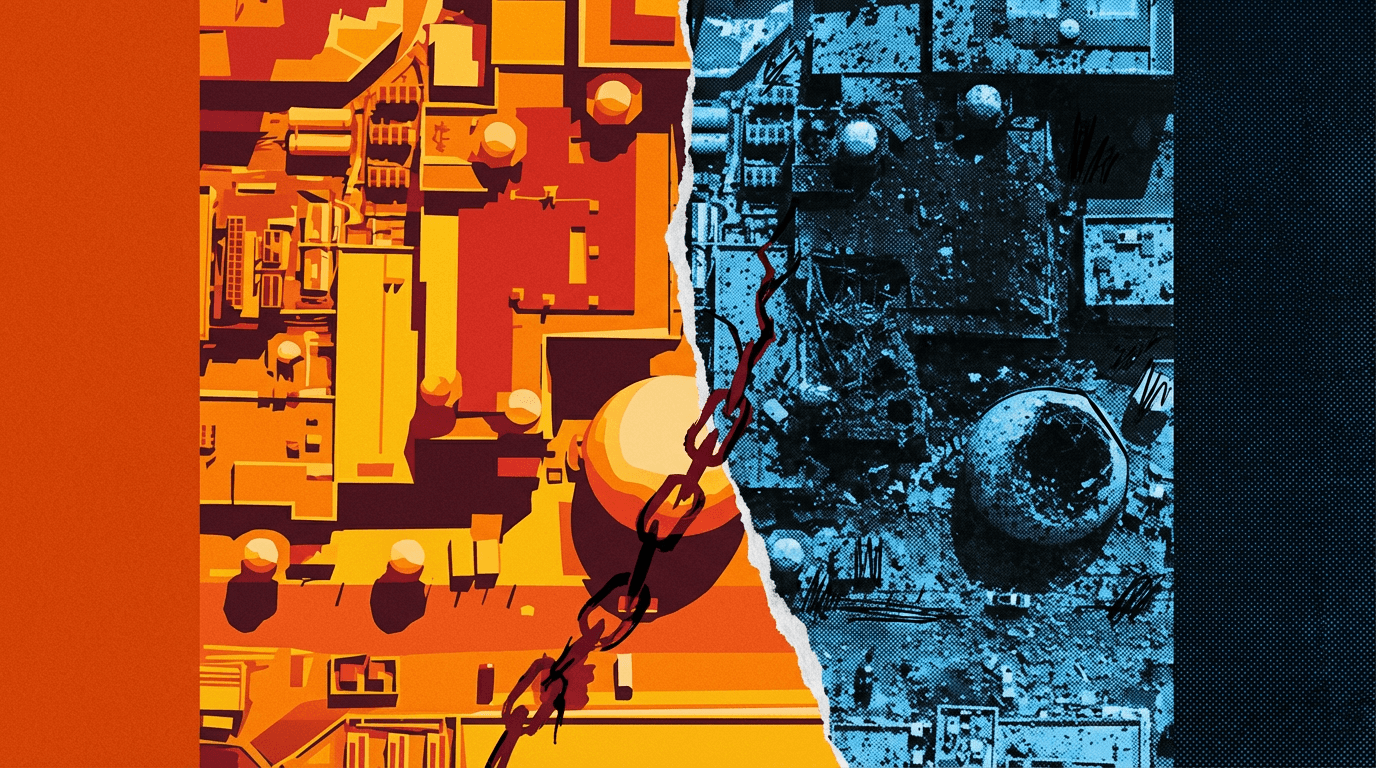

Über 110 KI-generierte Fake-Videos und -Bilder zum Krieg im Nahen Osten hat die New York Times in nur zwei Wochen identifiziert. Der Iran setzt die Fälschungen offenbar gezielt als Informationswaffe ein. Gleichzeitig wird es für unabhängige Beobachter immer schwerer, Fakten von Fiktion zu unterscheiden.

Eine Recherche der New York Times dokumentiert das Ausmaß KI-generierter Desinformation zum Krieg zwischen den USA, Israel und dem Iran: Über 110 einzigartige Fake-Bilder und -Videos wurden in den ersten zwei Wochen des Konflikts auf Plattformen wie X, TikTok und Facebook identifiziert. Zusammengenommen erreichten sie ein Millionenpublikum.

Die Fälschungen decken sämtliche Aspekte des Krieges ab: frei erfundene Explosionen in Tel Aviv, nie angegriffene Straßenzüge, protestierende Soldaten, die nicht existieren. Neue KI-Werkzeuge ermöglichen nahezu jedem, für wenig oder gar kein Geld täuschend echte Kriegssimulationen zu erstellen. Laut einer Studie des Analyseunternehmens Cyabra dient die Mehrheit der KI-Fakes pro-iranischer Propaganda. Ziel ist es laut Medienforscher Marc Owen Jones von der Northwestern University, die militärische Stärke des Iran zu übertreiben und den Eindruck zu erwecken, der Krieg sei für Amerikas Verbündete verheerender als in der Realität.

Ein besonders virales Fake-Video zeigte angeblich Raketeneinschläge auf die Skyline von Tel Aviv. Ein weiterer Fall betraf die USS Abraham Lincoln: Nachdem Irans Revolutionsgarden behaupteten, das Flugzeugträgerschiff angegriffen zu haben, überfluteten KI-generierte Bilder eines brennenden Schiffs die Netzwerke. Die USA erklärten, der Angriff sei erfolglos gewesen und das Schiff unbeschädigt. Während echte Kriegsaufnahmen oft aus der Distanz und bei Nacht entstehen, ähneln die KI-Fälschungen laut der Times eher Hollywood-Actionfilmen mit Pilzwolken und leuchtenden Hyperschallraketen.

Laut Reuters beschuldigte US-Präsident Trump den Iran, KI als "Desinformationswaffe" einzusetzen, und warf nebenher westlichen Medien ohne Belege eine "enge Koordination" mit Teheran vor. FCC-Chef Brendan Carr drohte sogar Sendern mit Lizenzentzug wegen ihrer Kriegsberichterstattung.

Die Desinformation erreicht auch direkt deutsche Redaktionen. Der Spiegel entfernte mehrere Bilder aus seiner Iran-Berichterstattung, die mit hoher Wahrscheinlichkeit KI-generiert waren. Die Fotos stammten von der Agentur SalamPix und gelangten über die französische Agentur Abaca Press in das Angebot deutscher Bildagenturen. Betroffen sind neben dem Spiegel auch Zeit, Süddeutsche Zeitung, WDR, Stern und weitere Medien. Ein iranischer Fotograf gab zu, ohne Kennzeichnung Bilder von einer Plattform der iranischen Revolutionsgarden eingespeist zu haben.

Wenn echte Aufnahmen verschwinden, füllen KI-Fakes das Vakuum

Erschwerend kommt hinzu, dass eine unabhängige Überprüfung zunehmend schwieriger wird. Sogenannte Open-Source-Intelligence (OSINT), also die systematische Auswertung frei zugänglicher Quellen wie Satellitenbilder durch Forscher und Journalisten, war im vergangenen Jahrzehnt zu einem zentralen Werkzeug geworden, um den Nebel des Krieges zu durchdringen. Doch genau dieses Werkzeug wird nun stumpf.

Laut AFP hat Planet Labs, Betreiber der weltweit größten Flotte von Erdbeobachtungssatelliten, die Verzögerung für hochauflösende Bilder der Region von vier Tagen auf zwei Wochen verlängert. Die Sperre umfasst den gesamten Iran, verbündete Militärbasen und die Golfstaaten. Auch der Branchenführer Vantor (ehemals Maxar) blockiert Aufnahmen von US- und alliierten Stützpunkten. Beide Unternehmen erklärten laut Washington Post, nicht auf Regierungsanweisung zu handeln.

Kritiker argumentieren, dass die Einschränkungen öffentliche Narrative über den Konflikt formen und die Transparenz über Angriffe auf US-Stützpunkte verringern könnten. Die Lücken in der Echtzeitüberwachung erleichtern es aber auch Desinformation und KI-generierten Inhalten, sich ungehindert zu verbreiten, da solche Satellitenaufnahmen häufig als Beweis für erfolgreiche Angriffe dienen. Die regimenahe Tehran Times veröffentlichte etwa ein angebliches Satellitenbild der Zerstörung eines US-Radars in Katar, das sich aber als per KI manipuliertes Google-Earth-Bild herausstellte.

OSINT-Analyst Tal Hagin bringt das Dilemma gegenüber AFP auf den Punkt: Im Nebel des Krieges sei es schwer, den Erfolg feindlicher Angriffe einzuschätzen. OSINT sei als Lösung entstanden, um mithilfe öffentlicher Satellitenbilder die Zensur in Ländern wie dem Iran zu umgehen. Doch genau dieses Vertrauen werde jetzt von Desinformationsakteuren missbraucht: In sozialen Medien tauchen gefälschte OSINT-Accounts auf, die KI-generierte Satellitenbilder als echte Aufklärung ausgeben und so die Arbeit seriöser Ermittler untergraben.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren