Anthropic gibt Claude Code einen Sicherheits-Autopiloten

Kurz & Knapp

- Anthropic führt für sein KI-Coding-Tool Claude Code einen "Auto Mode" ein, der zwischen ständigen Sicherheitsabfragen und dem kompletten Abschalten aller Checks vermittelt.

- Ein Klassifikator auf Basis von Claude Sonnet 4.6 prüft jeden Befehl vorab: Lokale Dateioperationen laufen automatisch durch, riskante Aktionen wie externe Deployments oder Massenlöschungen werden blockiert. Nach zu vielen Blockaden schaltet das System auf manuelle Genehmigung zurück.

- Anthropic betont, dass der Modus Risiken reduziert, aber nicht eliminiert. Verfügbar ist er derzeit als Research Preview für Team-Plan-Nutzer. Enterprise- und API-Zugang folgen in Kürze.

Entwickler, die Claude Code nutzen, standen bisher vor einem Dilemma: entweder jede Aktion einzeln genehmigen oder alle Sicherheitschecks abschalten. Anthropics neuer Auto Mode soll einen Mittelweg bieten.

Claude Code kann Shell-Befehle ausführen, Dateien löschen, Verzeichnisse anlegen und Commits an GitHub senden. Standardmäßig fragt das Tool bei jeder potenziell riskanten Aktion um Erlaubnis. Das schützt vor Schäden, unterbricht aber den Arbeitsfluss erheblich. Viele Entwickler greifen deshalb zur Option "dangerously-skip-permissions", die sämtliche Sicherheitsprüfungen überspringt und laut Anthropic zu "gefährlichen und destruktiven Ergebnissen" führen kann.

Der neue Auto Mode soll dieses Dilemma entschärfen. Vor jeder Aktion prüft ein separater Klassifikator, ob der Befehl potenziell destruktiv ist. Sichere Aktionen werden automatisch ausgeführt, riskante blockiert. Claude versucht dann einen alternativen Weg. Scheitert das wiederholt, drei Blockaden in Folge oder zwanzig insgesamt, schaltet das System auf manuelle Genehmigung zurück.

Klassifikator unterscheidet zwischen lokalem Arbeiten und externen Risiken

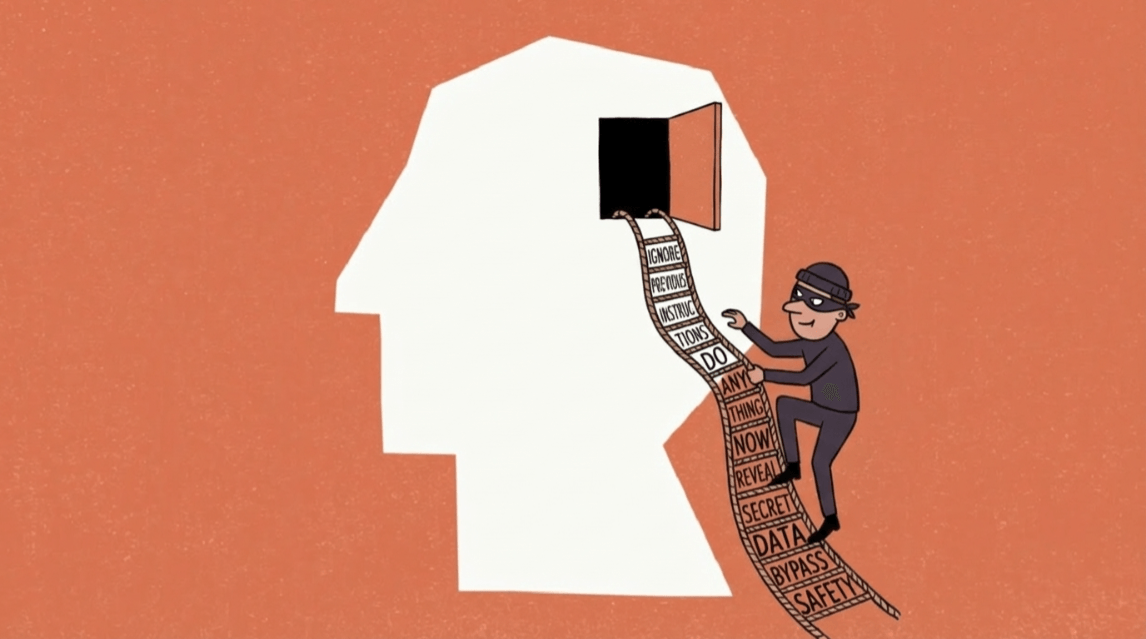

Der Klassifikator läuft auf Claude Sonnet 4.6 und bewertet Aktionen anhand des Gesprächskontexts. Laut der technischen Dokumentation sieht er dabei bewusst keine Tool-Ergebnisse. Das soll verhindern, dass schädliche Inhalte in gelesenen Dateien oder Webseiten den Klassifikator manipulieren.

Standardmäßig blockiert der Klassifikator das Herunterladen und Ausführen externer Skripte, das Senden sensibler Daten an externe Endpunkte, Produktions-Deployments, Massenlöschungen auf Cloud-Speichern und Force-Pushes. Lokale Dateioperationen im Arbeitsverzeichnis, die Installation bereits deklarierter Abhängigkeiten und Read-only-HTTP-Anfragen werden hingegen durchgelassen.

Risiko reduziert, aber nicht beseitigt

Anthropic betont, dass der Auto Mode das Risiko verringert, es jedoch nicht eliminiert. Der Klassifikator könne bei mehrdeutigem Kontext riskante Aktionen durchlassen oder harmlose fälschlicherweise blockieren. Das Unternehmen empfiehlt weiterhin die Nutzung in isolierten Umgebungen.

Der Auto Mode ist derzeit als Research Preview für Team-Plan-Nutzer verfügbar und funktioniert mit den Modellen Sonnet 4.6 und Opus 4.6. Enterprise- und API-Zugang sollen laut Anthropic in den kommenden Tagen folgen.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren