Deepmind: Transframer-KI träumt 30-Sekunden-Video aus einem Bild

Deepminds neue Video-KI Transframer kann eine ganze Reihe von Bild- und Videoaufgaben erledigen - und aus einem einzelnen Bild 30 Sekunden lange Videos träumen.

Generative KI-Systeme sind in den letzten Jahren aus den Forschungslaboren in die industrielle und private Anwendung gelangt, den Startschuss gab OpenAIs großes Sprachmodell GPT-3. Das Unternehmen zeigte dann im April das Bild-System DALL-E 2 und brachte so indirekt Alternativen wie Midjourney oder Stable Diffusion hervor.

Die Google-Schwester Deepmind zeigt nun mit Transframer ein KI-Modell, das einen Ausblick auf die nächste Generation generativer KI-Modelle bieten könnte.

Deepmind Transframer: Ein Modell mit vielen Aufgaben

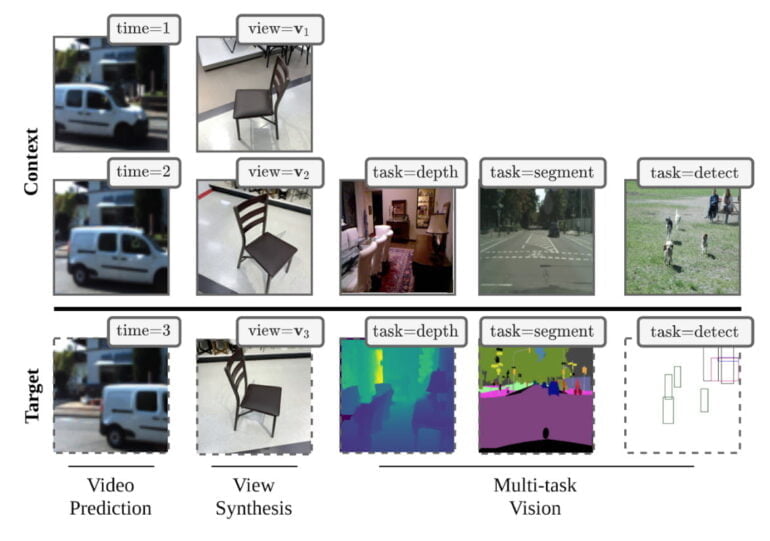

Deepminds Transframer ist ein Framework für visuelle Vorhersagen, das gleich acht Bildmodellierungs und -verarbeitungsaufgaben lösen kann, etwa Tiefenschätzung, Instanzsegmentierung, Objekterkennung oder Video-Vorhersagen.

Transframer greift dafür auf eine Reihe von Kontextbildern mit zugehörigen Annotationen wie Zeitmarken oder Kamerastandpunkte zurück und verarbeitet davon ausgehend die Abfrage für ein Bild.

Das Modell verarbeitet komprimierte Bilder mit einem U-Net, dessen Outputs an einen DCTransfromer-Decoder weitergegeben werden. Konkret werden die Bilder per DCT (Diskrete Kosinustransformation) komprimiert, DCT wird auch im Kompressionsverfahren JPEG verwendet. Der DCTransformer ist auf DCT-Tokens spezialisiert.

Transframer generiert neue Blickwinkel und ganze Videos

Neben klassischen Bild-Aufgaben wie der Tiefenschätzung und Objekterkennung beherrscht Transframer auch die Synthese neuer Blickwinkel auf ein Objekt und die Vorhersage von Videoverläufen.

In einem kurzen Tweet zeigt Deepmind etwa sechs 30-Sekunden-Videos, die Transframer aus einem einzigen Input-Bild erträumt hat. Trotz der niedrigen Auflösung lässt sich eine gewisse Konsistenz erkennen.

Transframer is a general-purpose generative framework that can handle many image and video tasks in a probabilistic setting. New work shows it excels in video prediction and view synthesis, and can generate 30s videos from a single image: https://t.co/wX3nrrYEEa 1/ pic.twitter.com/gQk6f9nZyg

— DeepMind (@DeepMind) August 15, 2022

Laut Deepmind zeigen die Ergebnisse, dass sich ein Framework wie Transframer für anspruchsvolle Bild- und Videomodellierungsaufgaben eigne. Transframer könne zudem als Multitasker Probleme der Bild- und Videoanalyse lösen, für die bisher spezialisierte Modelle eingesetzt werden, so die Forschenden.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.