Alle KI-News von der Apple Keynote (Spoiler: Es sind sehr wenige)

Welche Neuerungen Apple Intelligence in iOS 18 mit sich bringt, hatte Apple bereits zur WWDC verraten. Entsprechend ernüchternd war die mit Spannung erwartete iPhone-Keynote.

Apple hat auf seiner alljährlichen iPhone-Keynote parallel zur Vorstellung von iPhone 16 und Co. zwar nicht viele, aber immerhin ein paar Worte zu Künstlicher Intelligenz verloren. Die ersten KI-Fähigkeiten, die im Juni unter der Marke "Apple Intelligence" angekündigt wurden, sollen ab Oktober in iOS 18.1, iPadOS 18.1 und macOS Sequoia 15.1 landen. Zunächst ist der Funktionsumfang jedoch noch stark beschränkt, bevor in den kommenden Monaten weitere Features folgen.

Apple Intelligence ist in iOS 18, iPadOS 18 und macOS Sequoia integriert und nutzt die Leistung von Apple Silicon, um Sprache und Bilder zu verstehen und zu erstellen, appübergreifend zu agieren und aus dem persönlichen Kontext seiner Nutzer:innen zu schöpfen, um alltägliche Aufgaben zu vereinfachen und zu beschleunigen - unter Wahrung der Privatsphäre und Sicherheit seiner Nutzer:innen, verspricht Apple.

"Visual Intelligence" auf Knopfdruck

Ein markantes Beispiel einer Siri-Anfrage, die das iPhone in Zukunft mühelos erledigen soll: "Schicke Erika das Bild vom Barbecue letzten Donnerstag." Nicht nur versteht Apple Intelligence also den Bildinhalt, sondern verknüpft dies mit Informationen wie dem Aufnahmedatum und sendet die Dateien anschließend über eine App an einen Kontakt.

Viele der gezeigten Funktionen von Apple Intelligence waren bereits durch die Demo auf der WWDC bekannt. Neu ist die "Visual Intelligence", die im iPhone 16 Pro über die neue physische Kamerataste (Camera Control) aufgerufen wird. Damit können Nutzer:innen schnell Informationen über ihre Umgebung sammeln. Apple zeigt, wie sich Hunderassen identifizieren, Bewertungen und Öffnungszeiten für ein Restaurant abrufen oder von einem Flyer Termine zum Kalender hinzufügen lassen.

Video: Apple

Die Visual Intelligence dient auch als Zugang zu Drittanbieter-Tools. Zum Beispiel können Nutzer:innen (wie mit Google Lens) auf Google suchen, um herauszufinden, wo sie einen fotografierten Gegenstand kaufen können, oder ChatGPT direkt über die Kamera-Oberfläche nutzen. Apple betont, dass Nutzer:innen stets die Kontrolle darüber haben, wann Tools von Drittanbietern verwendet und welche Informationen weitergegeben werden.

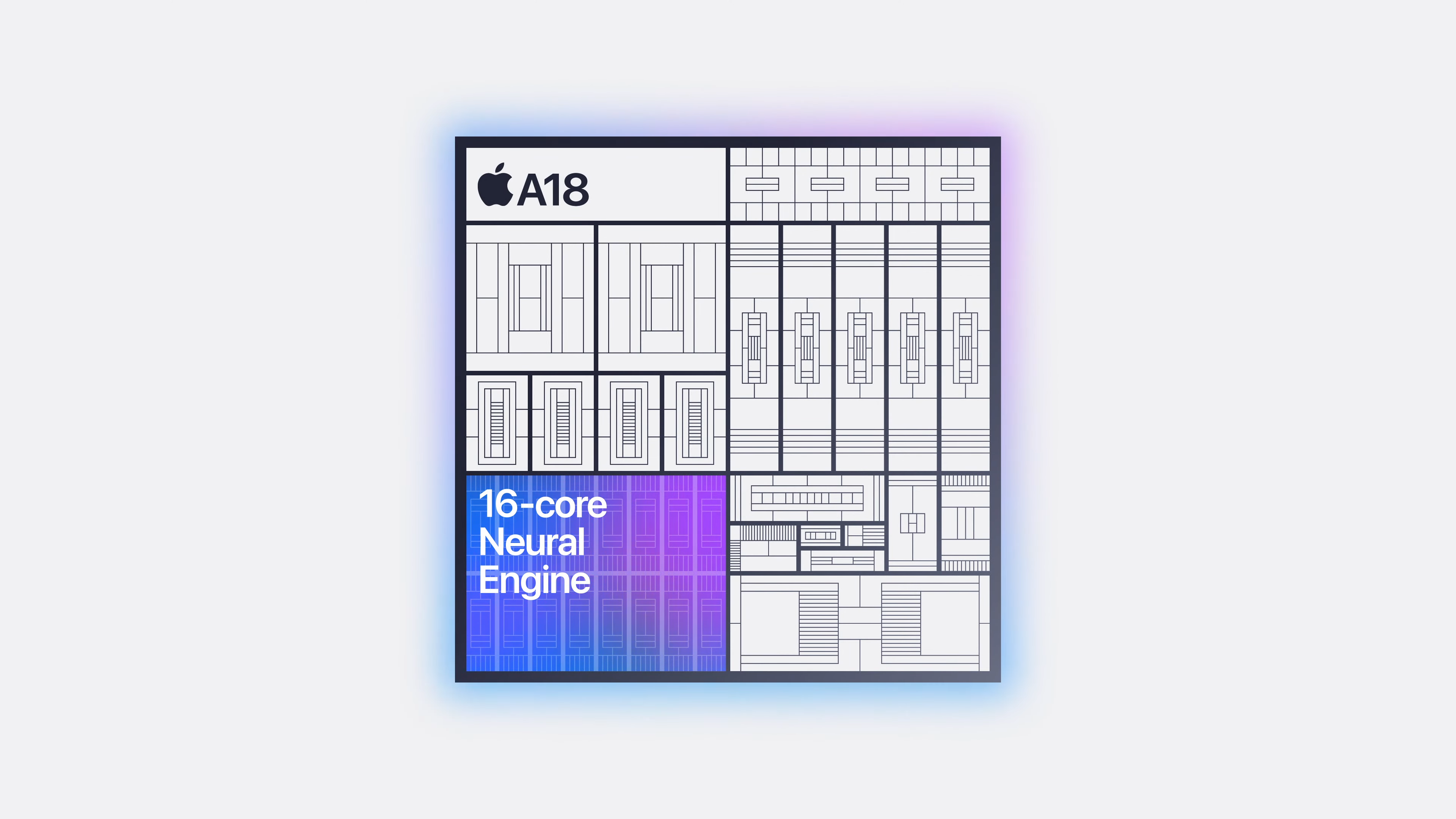

Die neu vorgestellte iPhone-16-Reihe, insbesondere das iPhone 16 Pro und das iPhone 16 Pro Max, ist für Apple Intelligence konzipiert. Diese Geräte verfügen über den im 3-Nanometer-Verfahren gefertigten A18-Pro-Chip, der gegenüber dem iPhone 15 Pro eine 15 Prozent schnellere KI-Verarbeitung ermöglicht.

Der Chip enthält auch einen dedizierten KI-Beschleuniger mit 16 Kernen, der die Leistung von Machine-Learning-Aufgaben verbessert. Der neue Chip soll bis zu doppelt so schnell sein wie das Vorgängermodell A16 und sich für den Betrieb "großer generativer KI-Modelle" eignen.

Ansonsten kaum Neues zu Apple Intelligence

Weitere gezeigte Funktionen beschränkten sich auf die Schreibwerkzeuge, die etwa aus Stichworten Fließtexte machen oder geschriebene Absätze formeller klingen lässt. Benachrichtigungen, beispielsweise von E-Mails, zeigen nicht mehr die ersten Wörter des Inhalts, sondern eine KI-generierte Zusammenfassung an.

Video: Apple

Die Fotos-App erhält bekanntermaßen ebenfalls ein KI-Upgrade: Nutzer:innen können nun Filme erstellen, indem sie eine Beschreibung eingeben, oder Fotos und Videoabschnitte durch natürliche Beschreibungen finden. Das neue Werkzeug "Aufräumen" entfernt ablenkende Objekte im Hintergrund eines Fotos, ohne das Motiv zu verändern.

Apple Intelligence wird als kostenloses Software-Update verfügbar sein, wobei das erste Set von Funktionen im nächsten Monat in US-Englisch für die meisten Regionen weltweit ausgerollt wird. Das Unternehmen plant, die KI-Fähigkeiten im Dezember um lokalisiertes Englisch in Australien, Kanada, Neuseeland, Südafrika und Großbritannien zu erweitern. Zusätzliche Sprachunterstützung für Chinesisch, Französisch, Japanisch und Spanisch soll im nächsten Jahr folgen.

Google hat einen Monat zuvor die neuste Generation seiner Pixel-Serie vorgestellt, die analog zu Apple Intelligence voll auf die Integration von Gemini setzt, um die Smartphone-Erfahrung um KI anzureichern.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.