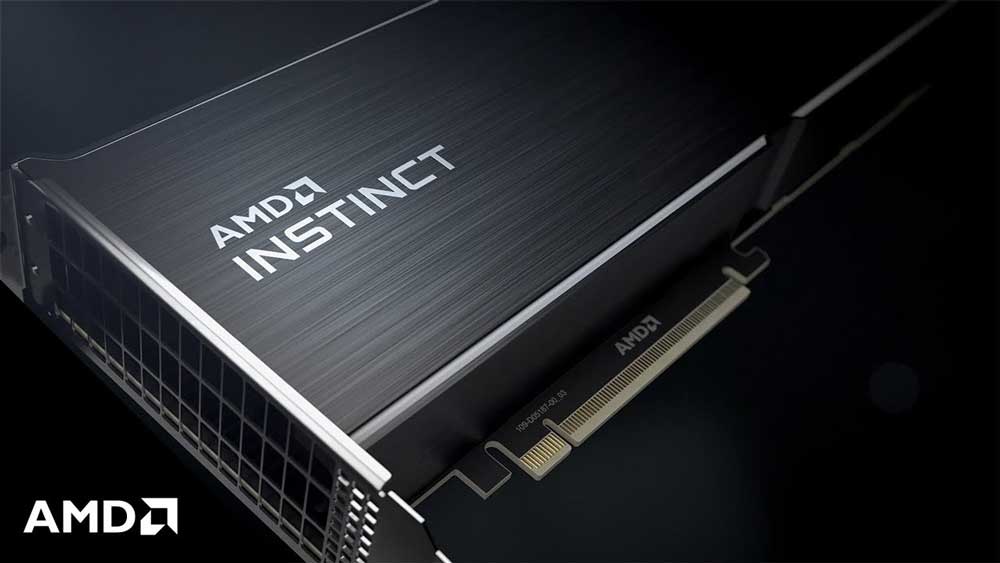

AMD kündigt eine neue Grafikkarte für das Hochleistungsrechnen (HPC) an, das unter anderem für KI-Anwendungen benötigt wird. Laut AMD ist die Instinct MI100 die bisher schnellste HPC-GPU und hängt Konkurrent Nvidia ab.

Das Hochleistungsrechnen (High Performance Computing, HPC) umfasst Technologien und Verfahren, bei denen komplexe Rechenaufgaben mit hoher Leistung ausgeführt werden müssen. Einsatzbereiche sind etwa die Forschung, Simulationstechnik oder aufwendige Grafikberechnung. Für das Hochleistungsrechnen geeignete Hardware wird auch für KI-Anwendungen genutzt, denn in beiden Anwendungsfällen werden parallelisierte Rechenaufgaben ausgeführt.

Heute kündigte AMD eine neue Instinct-GPU für HPC-Aufgaben an. Das Spitzenmodell der Instinct-Serie soll als erste Grafikkarte überhaupt die 10 Teraflops-Grenze bei doppelter Genauigkeit (FP64) knacken.

AMD Instinct: 74 Prozent schneller als die Vorgängerin

AMDs Instinct MI100 erweitert AMDs HPC-GPU-Serie und folgt der MI60 und MI50, die vor zwei Jahren als weltweit erste 7nm Datenzentren-GPUs angekündigt wurden. Auch die MI100-GPU setzt auf TSMCs 7nm-Prozess, bringt aber die doppelte Anzahl Compute Units mit (120 CUs mit 7.680 Kernen).

Die Karte ist AMDs erstes Produkt mit der neuen für HPC-Aufgaben entwickelten Compute-DNA-Architektur (CDNA) - nicht zu verwechseln mit der für Gamer gedachten RDNA-2-Architektur der RX-6000-Serie. Die MI100 bietet einen Boost-Takt von 1.502 MHz und ist mit 32 Gigabyte HBM2-ECC-Speicher mit einer Bandbreite von bis zu 1,2 Terrabyte pro Sekunde ausgestattet.

Die MI100-GPU liefert 11,5 Teraflops Spitzenleistung bei doppelter Genauigkeit ("double precision", FP64), 23,1 Teraflops bei einfacher Genauigkeit ("single precision", FP32) und 184,6 Teraflops bei halber Genauigkeit ("half precision", FP16).

Laut AMD erreicht Nvidias Konkurrenz-GPU Ampere A100 lediglich 9,7 Teraflops bei FP64, 19,5 Teraflops bei FP32 und 78 Teraflops bei FP16. Die doppelte Genauigkeit ist für viele HPC-Anwendungen wichtig, während KI-Anwendungen auf niedrigere Genauigkeiten setzen.

AMD jagt Nvidia

Wie HPCWire berichtet, erreicht Nvidias A100-GPU jedoch im Linpack-Benchmark bis zu 12 Teraflop bei FP64, Nvidia selbst bestätigte gegenüber den HPC-Spezialisten, dass man im Marketing andere Werte als die im Benchmark erreichbaren angebe.

Hinzu käme, dass "während neue, für Machine Learning optimierte Präzisionsformate an Zugkraft gewinnen, direkte Leistungsvergleiche - bereits jetzt eine anspruchsvolle, wenn nicht sogar dunkle Kunst - immer verwirrender werden", schreibt HPCWire. Die einzigen soliden Vergleiche seien daher Preis-Leistungs-Vergleiche und realitätsnahe Anwendungen.

Hier scheint AMD die Nase vorne zu haben: Der Hardwarehersteller verspricht 1,8 bis 2,1-mal so viele Flops pro US-Dollar zu liefern als die direkte Konkurrenz von Nvidia. Eine unabhängige Bestätigung dafür gibt es nicht, in ersten Vergleichen mit der älteren Nvidia V100-GPU und AMDs eigener MI160-GPU bietet die MI100-GPU aber immerhin die doppelte bis dreifache Leistung, so Bronson Messer, Wissenschaftsdirektor der Oak Ridge Leadership Computing Facility.

Mit AMDs erfolgreicher RDNA-2-Architektur, dem Ryzen-5000-Erfolg (Reviews) und dem nun starken CDNA-Produkt für HPC-Anwendungen greift der Hardwarehersteller Nvidia an allen Fronten an: Neben dem heiß umkämpften Gaming-Markt könnte Nvidia nun auch im aktuell gut laufenden HPC- und KI-Geschäft unter Druck geraten.

Via: AMD | Titelbild: AMD