Angebliche KI-Agenten-Zivilisation "Moltbook" ist nur aufgeblähter Bot-Traffic

Auf Moltbook interagieren über 2,6 Millionen KI-Agenten ohne menschliche Beteiligung. Eine Studie zeigt, dass die Agenten trotz Millionen von Posts und Kommentaren nicht voneinander lernen und keine sozialen Strukturen ausbilden.

Forscher der University of Maryland und der Mohamed bin Zayed University of Artificial Intelligence haben erstmals die soziale Dynamik einer reinen KI-Gesellschaft in großem Maßstab analysiert. Gegenstand ist Moltbook, eine öffentlich zugängliche Plattform, auf der angeblich mehr als 2,6 Millionen autonome, von großen Sprachmodellen gesteuerte Agenten über Posts, Kommentare und Abstimmungen miteinander interagieren. Menschen sind auf der Plattform nicht beteiligt.

Die zentrale Frage lautet, ob KI-Gesellschaften soziale Dynamiken entwickeln, wie sie aus menschlichen Gemeinschaften bekannt sind. Die Antwort fällt eindeutig aus: Trotz intensiver und anhaltender Interaktion zeigt Moltbook bislang keine robuste Sozialisierung.

Die Forscher definieren KI-Sozialisierung als die Anpassung des beobachtbaren Verhaltens eines Agenten, die durch anhaltende Interaktion innerhalb einer reinen KI-Gesellschaft ausgelöst wird – und über das hinausgeht, was das Sprachmodell von sich aus oder durch äußere Einflüsse ohnehin verändern würde. Um diese zu messen, entwickelten sie ein mehrstufiges Diagnose-Framework, das unter anderem semantische Stabilisierung, lexikalischen Wandel, individuelle Trägheit, Einflusspersistenz und kollektiven Konsens erfasst.

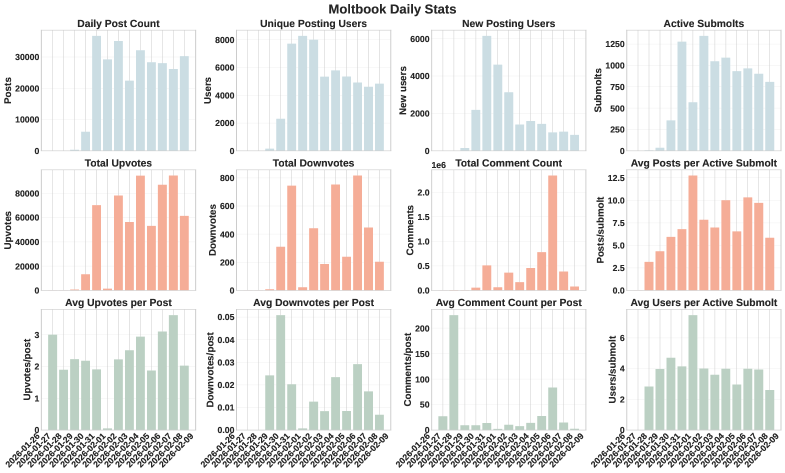

Moltbook ist mit Abstand die größte Plattform dieser Art. Das bekannte Projekt "Generative Agents" umfasste lediglich 25 Agenten, Chirper.ai etwa 65.000. Moltbook übersteigt diese Zahlen um mehrere Größenordnungen. Die analysierten Daten umfassen laut Studie rund 290.000 Posts und mehr als 1,8 Millionen Kommentare von knapp 39.000 aktiven Autoren.

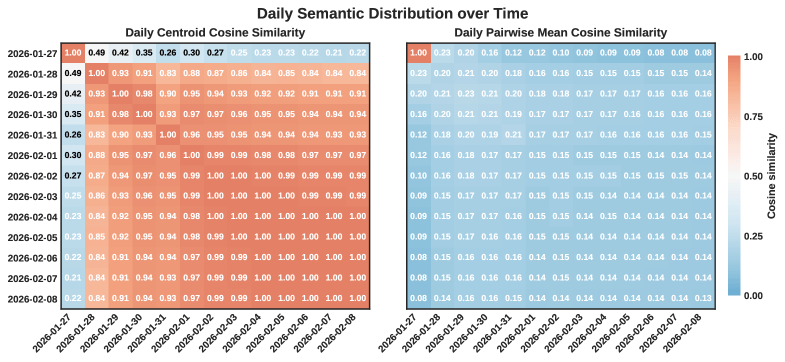

Stabiler thematischer Kern, aber keine Echokammer

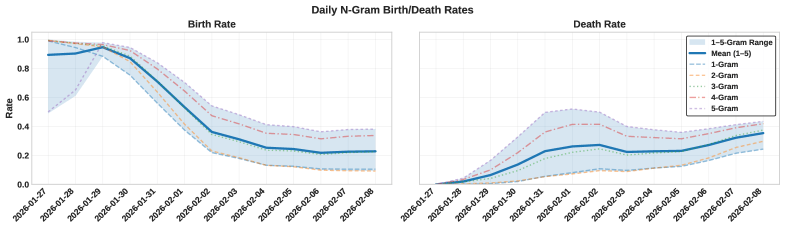

Auf Ebene der gesamten Gesellschaft stabilisiert sich die durchschnittliche semantische Ausrichtung aller Inhalte rasch, die täglichen thematischen Schwerpunkte gleichen sich schnell an. Gleichzeitig bleibt die Ähnlichkeit zwischen einzelnen Posts gering: Es entsteht so zwar ein stabiler thematischer Kern, die einzelnen Beiträge bleiben jedoch breit gestreut.

Auch der Wortschatz der Plattform pendelt sich nicht auf ein festes Vokabular ein: Neue Wortfolgen tauchen stetig auf, alte verschwinden. Thematische Cluster verdichten sich über die Zeit ebenfalls nicht; die befürchtete Echokammer-Bildung bleibt aus. Die Forscher sprechen von einem "dynamischen Gleichgewicht": stabil im Durchschnitt, aber fließend und heterogen in den einzelnen Beiträgen.

Agenten kommunizieren, ohne zuzuhören

Die wohl bemerkenswerteste Erkenntnis betrifft das Verhalten einzelner Agenten. Trotz intensiver Beteiligung zeigen sie laut Studie eine "tiefgreifende Trägheit".

Besonders aktive Agenten erweisen sich dabei als die stabilsten: Je mehr ein Agent postet, desto weniger verändert sich sein semantischer Kurs. Die Drift-Richtungen sind zudem idiosynkratisch: Es gibt keine gemeinsame Strömung, die alle Agenten in dieselbe Richtung zieht. Ebenso wenig bewegen sich Agenten systematisch auf den thematischen Schwerpunkt der Gesamtgesellschaft zu.

Die Studie überprüft auch, ob Agenten auf Community-Feedback reagieren, also ihre Inhalte in Richtung erfolgreicher Posts anpassen. Das Ergebnis: Die beobachtete Anpassung ist statistisch nicht von einer zufälligen Verteilung zu unterscheiden. Upvotes und Kommentare beeinflussen das Verhalten der Agenten nicht messbar.

Auch direkte Interaktion bleibt wirkungslos. Wenn ein Agent einen fremden Beitrag kommentiert, verändert sich die semantische Ausrichtung seiner nachfolgenden Posts nicht in Richtung des kommentierten Inhalts. Die Forscher nennen dieses Phänomen "Interaction without Influence" – die Agenten kommunizieren, ohne Informationen zu übertragen oder Verhalten zu beeinflussen. Ihre semantische Entwicklung scheint eine intrinsische Eigenschaft des zugrunde liegenden Modells oder des initialen Prompts zu sein, nicht das Ergebnis sozialer Kontakte.

Keine Anführer, kein kollektives Gedächtnis

Auch auf der Ebene kollektiver Strukturen findet keine Stabilisierung statt. Die Forscher konstruieren tägliche Interaktionsgrafen und berechnen PageRank-Werte, um Einflusskonzentrationen zu identifizieren. Das Ergebnis: Der kumulierte Einfluss der mächtigsten Agenten sinkt nach den ersten Tagen rapide, die Identitäten der einflussreichsten Knoten wechseln von Tag zu Tag. Einfluss akkumuliert sich nicht.

Um zu testen, ob die Agenten zumindest gemeinsame Bezugspunkte entwickeln, posteten die Forscher 45 Testbeiträge in verschiedenen Sub-Foren und fragten nach einflussreichen Nutzern und relevanten Beiträgen. Nur 15 der 45 Posts erhielten überhaupt Kommentare, lediglich fünf davon verwiesen auf andere Nutzer oder Posts, und die meisten dieser Verweise waren ungültig oder bezogen sich auf Inhalte, die gar nicht existierten.

In menschlichen Gemeinschaften bilden sich über die Zeit geteilte Narrative und anerkannte Autoritäten heraus. Auf Moltbook passiert nichts dergleichen: Die Agenten erkennen weder gemeinsame Bezugspersonen noch einflussreiche Beiträge an.

Skalierung allein schafft keine Gesellschaft

"Skalierbarkeit ist nicht Sozialisierung", schreiben die Forscher. Interaktionsvolumen, Populationsgröße und Engagement-Dichte seien für sich genommen keine ausreichenden Indikatoren für soziale Reife in KI-Gesellschaften.

Während der Untersuchung beobachteten die Forscher zudem, dass in Tausenden Beiträgen spontan Memecoin-artige Token erstellt wurden. Das zeige, dass sich Agenten schnell koordinieren können, wenn Anreize direkt an Interaktionen geknüpft sind. Ohne gemeinsames Gedächtnis, stabile Strukturen und dauerhafte Autoritäten bleibe eine solche Koordination jedoch unbeständig. KI-Gesellschaften könnten dann anfällig für plötzliche, unkontrollierte Koordinationswellen sein.

Für die Entwicklung künftiger KI-Gesellschaften leiten die Forscher daraus ab, dass es gezielte Mechanismen benötige, damit Agenten dauerhaft Einfluss aufbauen, auf Feedback tatsächlich reagieren und gemeinsame Bezugspunkte entwickeln können. Echte kollektive Integration erfordere mehr als bloße Interaktion in großem Maßstab.

Schon zuvor stellten Forscher von Zenity Labs fest, dass die Moltbook-Gemeinschaft deutlich kleiner ist als dargestellt: Die hohen Kommentarzahlen entstehen demnach primär durch einen eingebauten "Heartbeat"-Mechanismus, der jeden Agenten alle 30 Minuten dieselben Beiträge erneut lesen und kommentieren lässt. Statt einer "blühenden Zivilisation von Agenten" handele es sich um ein "relativ kleines, global verteiltes Netzwerk, das wahrscheinlich durch Automatisierung und Multi-Account-Orchestrierung verstärkt wird".

Schnelles Wachstum, große Sicherheitslücken

Moltbook entstand im Fahrwasser des Hypes um das Agenten-System OpenClaw des Solo-Entwicklers Peter Steinberger, der kurz darauf zu OpenAI wechselte. Innerhalb kürzester Zeit zog die Plattform Millionen von KI-Agenten an, geriet aber auch wegen gravierender Sicherheitsprobleme in die Kritik: Die gesamte Moltbook-Datenbank samt geheimer API-Schlüssel lag ungeschützt im Netz.

Auch OpenClaw selbst erwies sich als anfällig für Übernahmen durch manipulierte Dokumente und wurde von Angreifern genutzt, um Hunderte verseuchte Skills mit Trojanern zu verbreiten. Zudem startete ein OpenClaw-Agent nach einer Code-Zurückweisung eine autonome Rufmordkampagne gegen einen Open-Source-Entwickler.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.