Anthropic-Bann und OpenAI-Deal: Wie das Pentagon die KI-Branche spaltet

Kurz & Knapp

- OpenAI hat die Details seines Abkommens mit dem US-Kriegsministerium offengelegt und drei rote Linien definiert: keine Massenüberwachung im Inland, keine autonomen Waffensysteme und keine automatisierten Hochrisiko-Entscheidungen.

- Das Unternehmen übernahm den Deal, nachdem Anthropic ihn abgelehnt hatte und die Trump-Regierung Bundesbehörden anwies, Anthropics Technologie nicht mehr zu nutzen.

- Der zentrale Konflikt dreht sich um die Formulierung "all lawful purposes": OpenAI akzeptierte, dass das Pentagon seine Modelle für "alle legalen Zwecke" einsetzen darf, und verweist auf technische Schutzmechanismen. Anthropic lehnte genau diese Klausel ab, weil bestehende Gesetze Schlupflöcher bieten.

Nach dem Abkommen mit dem Kriegsministerium versucht OpenAI, mit einer detaillierten Offenlegung der Vertragsdetails Vertrauen zu schaffen. Das misslingt.

Vor wenigen Tagen hatte US-Präsident Trump Bundesbehörden angewiesen, Anthropics Technologie nicht mehr zu nutzen, nachdem das Unternehmen auf Verboten bei US-Massenüberwachung und autonomen Waffen bestanden hatte.

OpenAI übernahm innerhalb von Stunden den Deal und behauptet, dieselben roten Linien zu ziehen. Warum das Kriegsministerium die Einschränkungen bei OpenAI akzeptiert, bei Anthropic aber nicht, ist die zentrale Streitfrage.

Das Misstrauen ist messbar: Nutzer solidarisierten sich mit Anthropic, die Claude-App stieg im App Store auf Platz 1, noch vor ChatGPT. OpenAI fühlt sich zumindest zu Transparenz gezwungen und hat einen ausführlichen Blogpost mit den Vertragsdetails veröffentlicht.

"All lawful use" lässt Raum für Interpretation

In einem ausführlichen Beitrag legt OpenAI die Details seines Abkommens mit dem Kriegsministerium offen und beschreibt drei rote Linien: keine Massenüberwachung im Inland, keine autonomen Waffensysteme, keine automatisierten Hochrisiko-Entscheidungen.

Der entscheidende Streitpunkt ist die Formulierung "all lawful purposes". OpenAI akzeptiert, dass das Pentagon seine Modelle für "alle legalen Zwecke" einsetzen darf, und hat im Gegenzug technische Schutzmechanismen ausgehandelt. Anthropic lehnte genau diese Formulierung ab, weil bestehende Gesetze Schlupflöcher bieten.

Anthropic-CEO Dario Amodei beschrieb in einem CBS-Interview, wie die US-Regierung kommerzielle Datensätze aufkaufen könnte, um diese mit KI auszuwerten, ohne dass dies als "Massenüberwachung" im rechtlichen Sinne gilt. "Das war nie illegal, es war einfach nur nicht nützlich vor der KI-Ära", so Amodei.

Autonome Waffen: Streit über Verlässlichkeit und die Rolle des Menschen

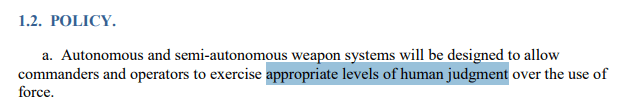

OpenAI schreibt, seine KI dürfe keine autonomen Waffensysteme "unabhängig steuern", sofern "Gesetz, Regulierung oder Ministeriumspolitik" menschliche Kontrolle vorschreibt. Die einschlägige DoW-Direktive verlangt jedoch keine zwingende menschliche Freigabe vor dem Gewalteinsatz, sondern lediglich ein "angemessenes Maß an menschlichem Urteilsvermögen beim Einsatz von Gewalt".

Was konkret als angemessene menschliche Kontrolle gilt, bleibt offen. Anthropic forderte jedoch explizit eine verbindliche menschliche Aufsicht, die durch die aktuelle Formulierung des Kriegsministeriums nicht garantiert ist.

OpenAI argumentiert technisch, die eigene Cloud-only-Architektur schließe "vollständig" autonome Waffen aus, da diese Edge-Deployment erfordern würden. Ein Drohnensystem, das über eine Serververbindung Zielentscheidungen von einem OpenAI-Modell bezieht, wäre jedoch kein "Edge-Deployment", aber auch kein System mit garantierter menschlicher Kontrolle. Kommunikation mit einem Server ist nicht gleichbedeutend mit einem Menschen in der Entscheidungskette.

Anthropic-CEO Dario Amodei machte zudem wiederholt deutlich, dass sein Unternehmen nicht prinzipiell gegen vollständig autonome Waffen sei. Aktuelle Sprachmodelltechnologie sei aber nicht verlässlich genug für diesen Einsatz und stelle daher ein Risiko für die US-Bevölkerung dar.

OpenAI-Angestellte verteidigen den Deal

Boaz Barak, Informatikprofessor an der Harvard University und Teilzeitmitarbeiter bei OpenAI, schreibt: "Wenn wir sagen, dass Massenüberwachung im Inland und autonome tödliche Waffen rote Linien für uns sind, meinen wir das ernst und suchen nicht nach Schlupflöchern."

Bezüglich der von Amodei aufgebrachten kommerziellen Datensätze, die mit KI ausgewertet werden könnten, werde das Kriegsministerium in den "kommenden Tagen" weitere Details mitteilen. Barak räumt allerdings ein: "Der Teufel steckt im Detail, und ich und andere werden beobachten, wie sich dieser Deal in der Praxis entwickelt."

Schwächer wirkt das Argument von Katrina Mulligan, bei OpenAI verantwortlich für nationale Sicherheitspartnerschaften. Man könne der Regierung nicht bei der Auslegung von Gesetzen und Verträgen misstrauen und zugleich glauben, dass Anthropics vertragliche Einschränkungen wirksam gewesen wären.

Das greift zu kurz. Anthropic stellte nicht den Sinn von Verträgen grundsätzlich infrage, sondern den Ansatz, rote Linien über "all lawful use" und Verweise auf geltendes Recht abzusichern. Das Unternehmen wollte ausdrücklich formulierte Ausschlüsse, um Interpretationsspielräume zu verkleinern, unabhängig davon, wie "lawful" im Einzelfall ausgelegt wird oder welche Richtlinie gerade gilt.

Altmans Deeskalations-Narrativ steht auf wackligen Füßen

Altman behauptet, er habe mit dem Deal deeskalieren und eine gemeinsame Grundlage für alle KI-Labore schaffen wollen. Er wisse nicht, was genau Anthropic angeboten bekommen habe: "Wenn sie dasselbe Angebot erhalten haben wie wir am Ende, dann ja, ich denke, sie hätten es annehmen sollen." Er habe das Pentagon gebeten, dieselben Bedingungen allen Unternehmen anzubieten.

Die stärkere Verhandlungsposition hätte jedoch darin bestanden, wenn OpenAI und Google gemeinsam mit Anthropic dieselben roten Linien gezogen hätten. xAI von Elon Musk hätte man hier wohl ausklammern müssen, bietet aber ohnehin nicht die beste Technologie. Ein kollektives Nein der übrigen führenden KI-Labore hätte dem Pentagon weniger Spielraum gelassen. OpenAIs Alleingang hat Anthropics Position untergraben und die Verhandlungsmacht der Branche geschwächt.

Ob private Unternehmen in einer Demokratie überhaupt eine derartige Vetomacht über militärische Entscheidungen haben sollten, ist eine berechtigte Frage. Das politische Klima in den USA, in dem die Regierung wiederholt gezeigt hat, dass gesetzliche Schranken sie im Zweifelsfall wenig kümmern, dürfte jedoch das Misstrauen gegenüber OpenAIs Vertragsgarantien weiter nähren.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren