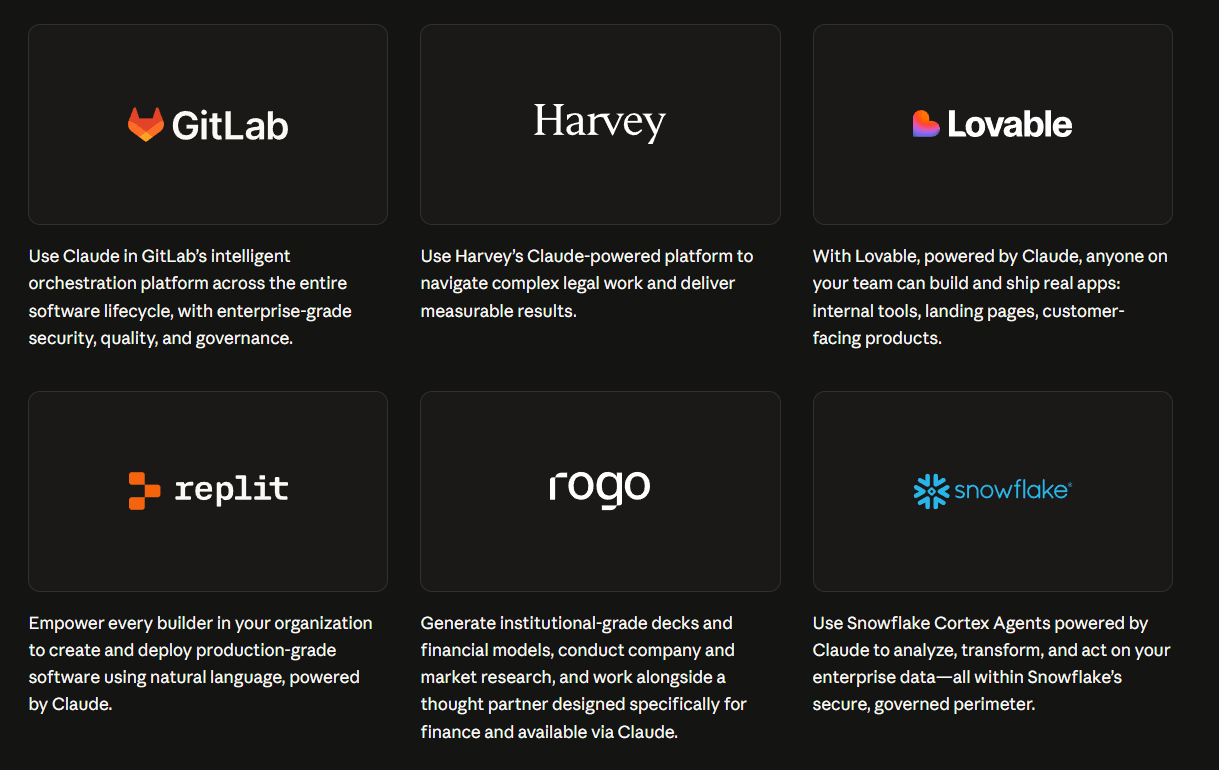

Anthropic startet einen neuen Marktplatz für Firmenkunden, über den sie Software von Drittanbietern kaufen können. Die Plattform namens Anthropic Marketplace bietet Anwendungen, die auf Anthropics KI-Modellen basieren, darunter Dienste von Snowflake, Harvey und Replit. Anthropic verzichtet auf eine Provision und erlaubt Kunden, einen Teil ihrer bestehenden Jahresausgaben für Anthropic-Dienste auch für Drittanbieter-Tools zu nutzen.

Strategisch ist das ein interessantes Manöver: Anthropic positioniert sich damit als Orchestrator eines wachsenden Software-Ökosystems, ähnlich wie Amazon mit dem AWS Marketplace oder Microsoft mit seinem Azure-Pendant.

Indem Anthropic auf Provisionen verzichtet und bestehende Budgets für Drittanbieter öffnet, senkt es die Hürde für Kunden, im eigenen Ökosystem zu bleiben. Der Verzicht auf Provisionen ist dabei weniger großzügig, als er klingt: Jede App im Marketplace basiert auf Anthropics Modellen, die Partner zahlen also ohnehin für die genutzten Modellkapazitäten. Anthropic verdient nicht am Marktplatz selbst, sondern an der steigenden Nachfrage nach seinen Modellen, die er erzeugt.

Kurz: Anthropic verfolgt eine klare Plattformstrategie. Interessierte Partner können sich hier auf eine Warteliste setzen.