Deutschland hat KI-Kummer, hier gibt's ein Trostpflaster

In sozialen und redaktionellen Medien kursiert derzeit die These, die Entwicklung der Künstlichen Intelligenz stagniere – ein vermeintliches Indiz: GPT-5 könne keine korrekte Deutschlandkarte zeichnen. Diese Einschätzung offenbart jedoch ein grundlegendes Missverständnis der Technologie.

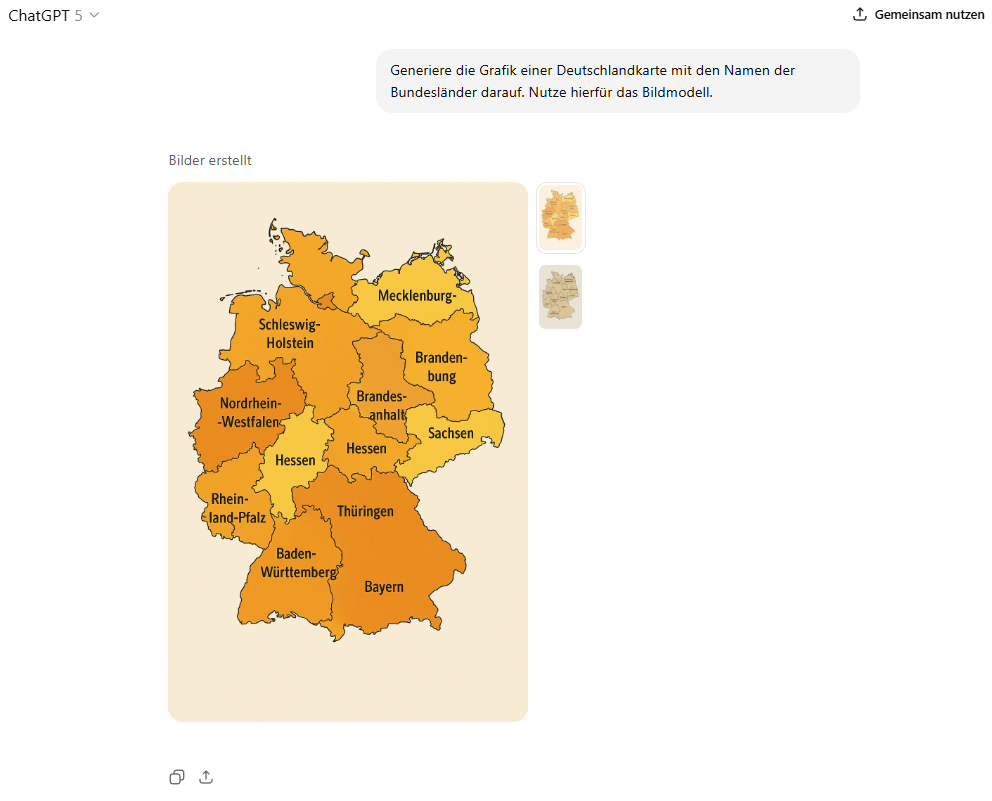

Als Beleg wird häufig eine Grafik herangezogen, die meist in ähnlicher Form gezeigt wird: eine Deutschlandkarte, deren Umrisse zwar einigermaßen korrekt sind, die jedoch zahlreiche Fehler bei der Beschriftung der Bundesländer aufweist.

Diese Kritik ergibt nur dann ansatzweise Sinn, wenn mit "ChatGPT-5" tatsächlich ausschließlich der sogenannte Router gemeint ist – also die Benutzeroberfläche, die Anfragen an verschiedene Modelle weiterleitet.

Im Fall der Deutschlandkarte wird die Anfrage nämlich nicht an GPT-5 selbst übergeben, sondern an das Bildmodell von ChatGPT, das vermutlich auf dem multimodalen GPT-4o basiert. GPT-5 – das eigentliche Sprachmodell – kann keine Bilder generieren.

Das ChatGPT-Bildmodell ist nicht darauf ausgelegt, geografisch exakte Karten zu zeichnen oder präzise Beschriftungen zu erstellen. Sein Ziel ist es, visuell ansprechende Bilder zu erzeugen. Eine fehlerfreie Deutschlandkarte davon zu erwarten, ist etwa so sinnvoll, wie Picasso zu bitten, eine maßstabsgetreue Zeichnung von Venedig aus dem Gedächtnis – und mit einem dicken Pinsel – anzufertigen.

Hinzu kommt: Die Bildgenerierungsfähigkeiten wurden mit GPT-5 nicht überarbeitet. Das "Problem", sofern man es überhaupt so nennen möchte, besteht also bereits seit der Einführung der Bildgenerierung in ChatGPT. Die Veröffentlichung von GPT-5 ist deshalb ein eher willkürlicher Anlass, das Thema aufzugreifen – oder es mangelt schlicht am technischen Verständnis.

GPT-5 kann Deutschland

Ein berechtigter Einwand wäre: Warum leitet "ChatGPT-5" (also der Router) die Anfrage überhaupt an das Bildmodell weiter, anstatt beispielsweise passenden Code für eine Karte zu generieren? In vielen grundlegenden Kritiken bleibt dieser zentrale Aspekt jedoch unerwähnt.

Stattdessen wird die fehlerhafte Deutschlandkarte gerne als Beweis dafür herangezogen, dass KI "immer noch dumm" sei – was auch immer das bedeuten mag – oder sie nicht mehr dazulerne. Zwar gibt es wissenschaftliche Hinweise darauf, dass das LLM-Paradigma an Grenzen stößt, ebenso aber auch weiterhin signifikante Gegenbeispiele und Fortschritte.

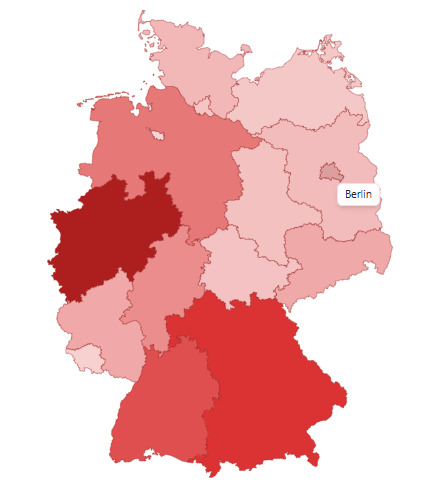

Die fehlerhafte Deutschlandkarte taugt jedoch weder als Argument für einen Stillstand der KI-Entwicklung noch als Fundamentalkritik an GPT-5, dem Modell. Denn fragt man GPT-5 – das Modell, nicht den Router – gezielt nach Code für eine Deutschlandkarte, liefert es korrekte und funktionale Ergebnisse – inklusive Interaktivität. GPT-5 kann also sehr wohl "Deutschland".

Wer sich fundiert zum Thema KI weiterbilden möchte, dem sei unser KI-Themendienst heise KI Pro empfohlen.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.