Falcon H1R 7B: Neues Reasoning-KI-Modell schlägt in Benchmarks größere Konkurrenz

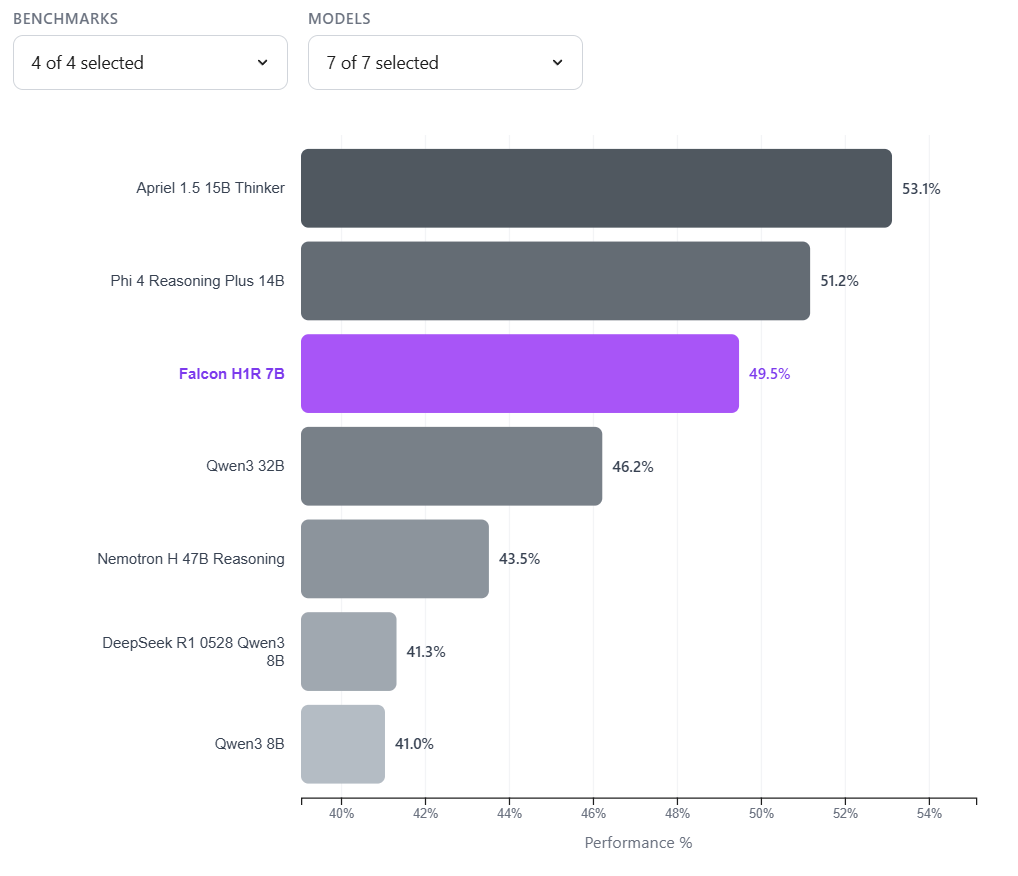

Das Technology Innovation Institute (TII) aus Abu Dhabi hat mit Falcon H1R 7B ein kleines Reasoning-Sprachmodell mit 7 Milliarden Parametern veröffentlicht. Es erreicht laut TII über verschiedene Benchmarks hinweg die Leistung von Modellen, die zwei- bis siebenmal größer sind. Das Modell nutzt eine hybride Transformer-Mamba-Architektur und erzielt dadurch höhere Verarbeitungsgeschwindigkeiten als vergleichbare Modelle. Wie immer gilt: Benchmarks korrelieren gerade bei kleinen KI-Modellen nur bedingt mit der realen Leistungsfähigkeit.

Das Modell steht als vollständiger Checkpoint und quantisierte Version auf Hugging Face zur Verfügung. Eine Demo ist ebenfalls verfügbar. Die Veröffentlichung erfolgt unter der Falcon-LLM-Lizenz, die kostenlose Nutzung, Vervielfältigung, Änderung und Verbreitung des Modells erlaubt. Die Nutzung muss allerdings der Acceptable Use Policy entsprechen, die jederzeit aktualisiert werden kann.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren