Pixel 6 (Pro): Googles große KI-Offensive - alle Funktionen

Googles Pixel 6 will den Smartphone-Markt mit den besten KI-Features erobern. Wie verbessert Künstliche Intelligenz das Pixel 6 und das Pixel 6 Pro?

Mit den Pixel 6 und Pixel 6 Pro Smartphones startet Google den nächsten Versuch, im eigenen Sofware-Ökosystem Android mit Hardware Fuß zu fassen. Nahezu neun von zehn Smartphones weltweit laufen mit Android, doch der Marktanteil von Googles Pixel-Geräten liegt unter einem Prozent.

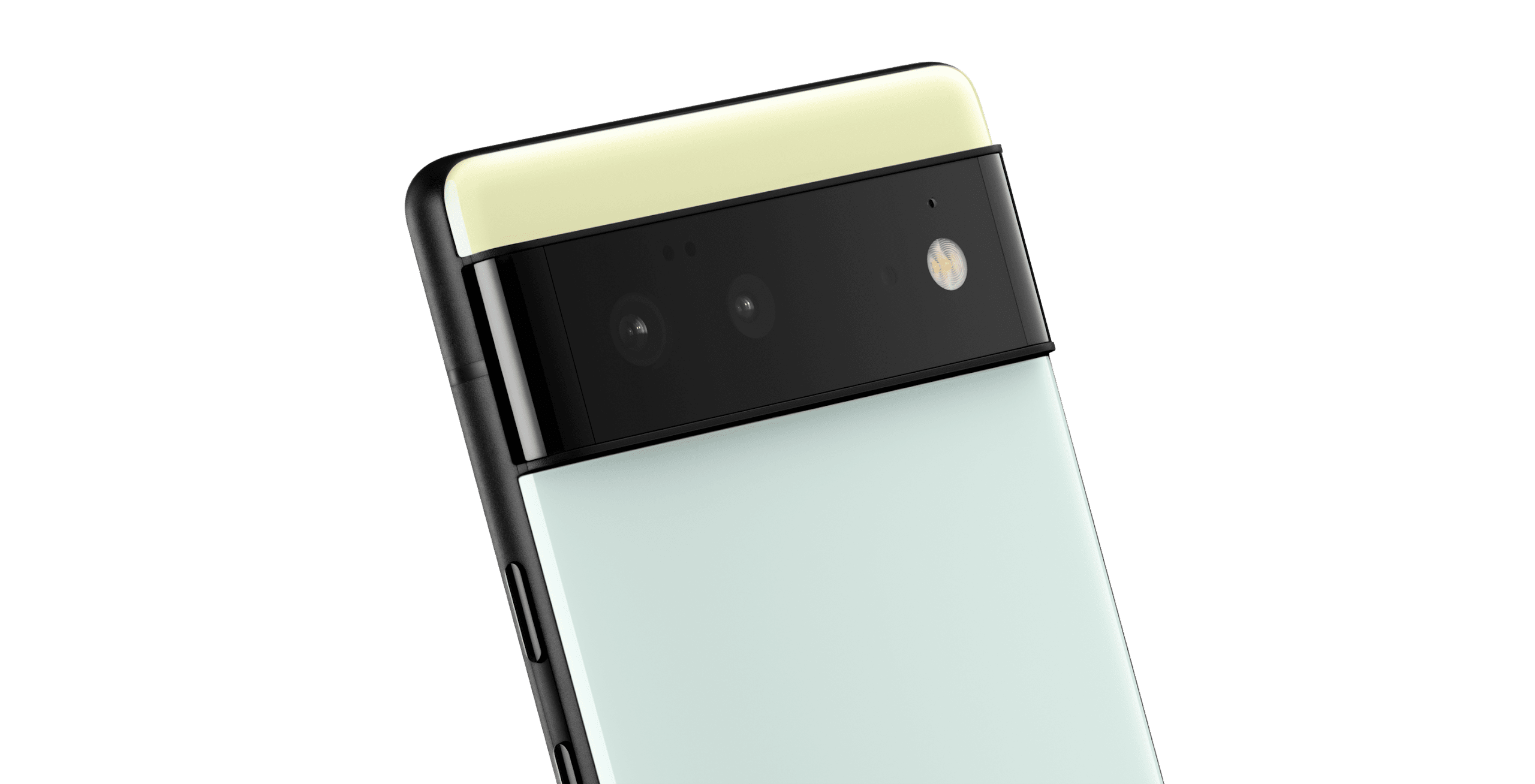

Die neue Pixel-Generation soll mit dem ersten eigenen Google-Chip, dem ersten Kamera-Upgrade seit dem Pixel 2 und vor allem zahlreichen KI-Features wieder Schwung in den Markt bringen.

Google Tensor: KI-Funktionen stechen im Smartphone-Allerlei hervor

Google arbeitete mehr als 15 Jahre mit Qualcomm zusammen. Schon im ersten Android-Smartphone HTC Dream respektive G1 steckte ein Qualcomm MSm7201A Arm11 Prozessor mit 528 MHz. Doch mit dem Pixel 6 wendet sich Google vom langjährigen Partner ab. Stattdessen verbaute Google den eigenen Chipsatz Google Tensor, der in Zusammenarbeit mit Samsung entstand. Der erste Ausflug in die Welt des SoC-Designs startete laut Google bereits vor vier Jahren.

Google Tensors CPU-Cluster setzt auf zwei Arm X1-Kerne mit 2,80 GHz, zwei Arm A76-Kerne mit 2,25 GHz und vier Arm A55-Kerne mit 1,80 GHz. Die auf dem Tensor-Chip verbaute Arm Mali-G78-GPU nutzt 20 Kerne. Außerdem sind ein neuer Tensor-Sicherheitskern und ein Titan-M2-Chip verbaut. Das soll das Pixel 6 zum bislang sichersten Google-Smartphone machen.

Neben den klassischen CPU- und GPU-Clustern verbaut Google auf dem Tensor zusätzlich KI-Hardware: eine Tensor Processing Unit für maschinelles Lernen, einen fortschrittlichen Bildsignalprozessor und ein "Context Hub" für Anwendungen mit niedrigem Stromverbrauch, etwa die Erkennung von laufender Musik in der Umgebung.

Laut Phil Carmack, Vizepräsident und Manager von Googles Chip-Business, ist Tensor so konzipiert, dass er schnell und energieeffizient Anwendungsfälle wie KI-gestützte Fotografie ausführen kann.

Google Pixel 6 (Pro) – KI-Features im Überblick

Viele der von Google gezeigten KI-Anwendungen sind bereits von älteren Pixel-Modellen bekannt, etwa automatische Übersetzung, Transkription oder KI-gestützte Fotografie. All diese Features sollen mit dem Pixel 6 lokal auf dem Smartphone laufen, bessere Ergebnisse liefern und den Akku weniger belasten. Google verspricht eine Laufzeit zwischen 24 und 48 Stunden für die neue Pixel-Generation.

Die folgenden Pixel-Funktionen setzen auf KI-Technik mit dem neuen Tensor-Chip.

Face Unblur

Mit Face Unblur will Google verschwommene Gesichter in Fotos beseitigen, etwa von Personen, die in Bewegung sind. Dafür erkennt das Pixel-Smartphone schon vor dem Foto, ob ein Gesicht im Bildausschnitt zu sehen und ob es unscharf ist. Google setzt dafür auf das Gesichtserkennungsmodell FaceSSD. Wird ein potenziell unscharfes Bild erkannt, aktiviert das Pixel 6 eine zweite Kamera.

https://youtu.be/6AUdTk84BtI

Dass Pixel 6 schießt dann direkt zwei Bilder – eines mit dem Hauptsensor und eines mit der Ultraweitkamera. Die Hauptkamera verwendet für ein rauscharmes Foto eine normale Belichtungszeit, die Ultraweitkamera hingegen setzt eine schnellere Belichtung ein für maximale Schärfe.

Ein weiteres KI-Modell vergleicht die Bilder, fügt sie zusammen und setzt das schärfere Gesicht in das Bild der Hauptkamera. Sind im zusammengefügten Bild noch Unschärfen vorhanden, entfernt das Pixel diese. Am gesamten Prozess sind laut Google insgesamt vier verschiedene KI-Modelle beteiligt, die auf Tensor laufen.

Magic Eraser

Mit Magic Eraser hat Google ein weiteres KI-Feature für die Smartphone-Fotografie in das Pixel integriert. Nutzer:innen können störende Objekte in Bildern durch einen Tipper markieren und entfernen. Das dann entstandene Loch im Bild füllt ein KI-Modell, das auf Basis des restlichen Bildes passende Pixel ergänzt.

Voici un avant/après de l'effaceur magique du nouveau #Pixel6 pic.twitter.com/cVBYdhN8QH

— Alain McKenna (@mcken) October 21, 2021

Magic Eraser ist vorwiegend dafür geeignet, kleine Objekte in Bildern zu entfernen, bei denen dennoch sichtbare Bildartefakte entstehen können. Ein ähnliches Feature stellte Samsung übrigens bereits vor knapp acht Monaten vor. Womöglich kann Google mit der internen KI-Expertise punkten und eine leistungsstärkere Variante liefern.

Motion Mode

Googles Motion Mode ist eine Art umgedrehtes Face Unblur: Statt einzelne Bereiche eines Bildes zu schärfen, fügt Motion Mode Unschärfe hinzu. Die KI-Technik soll Effekte erzeugen, die sonst nur mit Langzeitaufnahmen und Tripods möglich sind.

Video: Google

Die Pixel-6-Kamera nimmt dafür mehrere Fotos auf und kombiniert diese. Ein KI-Modell analysiert die Bilder und erkennt sich bewegende und ruhende Elemente. Über die sich bewegenden Elemente legt das Modell anschließend eine passende Unschärfe.

Wie gut das Modell mit unterschiedlichen Motiven funktioniert, wird der Alltag zeigen: Google demonstrierte bisher Beispiele einer U-Bahn, von Fahrrädern und von einem Wasserfall (siehe oben).

Video HDRnet

Bei Videoaufnahmen bringt der KI-Fokus des Pixel 6 die größten Fortschritte. Während Pixel und iPhone sich bei Fotos stets ein Kopf-an-Kopf-Rennen liefern, lag Google bei Videoaufnahmen stets hinter Apple.

Tensor und die neuen Kamera-Sensoren könnten das ändern: „Wir haben immer davon geträumt, dass Pixel-Videos der Qualität der Pixel-Fotos entsprechen – und Google Tensor hilft uns in beiden Bereichen“, schreibt Google.

Turn everyday moments into cinematic epics with #Pixel6.

The all-new camera and powerful processor make your videos accurate and sharp, with rich, vivid color – even in low light.

Take a look at HDRnet applied to 4K video at 60FPS ⬇️#Pixel6Launch pic.twitter.com/LFD9aDFFa5

— Made By Google (@madebygoogle) October 19, 2021

Mit dem Pixel 6 wendet Google das erste Mal KI-gestützte Bildbearbeitung auf Videos mit bis zu 4K-Auflösung und 60 Bildern pro Sekunde an. Dafür nutzt Google den erstmals 2018 gezeigten Bild-Algorithmus HDRnet, von dem einzelne Bestandteile direkt im Tensor-Bildsignalprozessor integriert sind.

Das soll die Verarbeitung der Bewegtbilder enorm beschleunigen und den Stromverbrauch drastisch reduzieren. Dank HDRnet soll das Pixel 6 in allen Formaten Videos in der Qualität von Standbildern aufnehmen können.

Dank Tensor läuft in Videos außerdem die bereits erwähnte Gesichtserkennung FaceSSD mit 30 Bildern pro Sekunde. Auf der Tonspur soll ein KI-Modell helfen, Sprache besser von Hintergrundgeräuschen zu trennen.

Transkription & Übersetzung

Neben Bild- und Videooptimierungen bietet das KI-Pixel 6 auch Verbesserungen für Spracherkennung, Transkription und Übersetzung. Die entsprechenden KI-Modelle laufen ebenfalls lokal auf dem Tensor-Chip und erlauben On-Device-Training mit eurer Stimme. Das soll die Spracherkennung noch besser machen.

Laut Google spart die lokale Ausführung 50 Prozent Energie und erlaubt daher das erste Mal, die qualitativ besten Spracherkennungsmodelle für lang laufende Anwendungen wie Rekorder oder Live Caption zu verwenden. Das Pixel 6 soll eure Stimme außerdem noch besser von Hintergrundgeräuschen filtern können.

Die Transkription kann Satzzeichen automatisch setzen und soll weniger Fehler machen. Die Echtzeit-Übersetzung läuft dank lokaler Ausführung deutlich schneller und soll auch direkt in Messengern wie WhatsApp funktionieren. Nutzer:innen müssen so nicht mehr Texte hin- und herkopieren.

https://youtu.be/8YiEmekf_34

Die oben beschriebenen Funktionen dürften erst der Anfang sein von Googles Smartphone-KI-Offensive mit dem Pixel 6. Weitere Features sind bereits angedacht: „Die enge Zusammenarbeit zwischen Forschung, Android-Plattform, Pixel und dem Silizium-Team schafft einen schönen Kreislauf“, so Carmack. „Wir haben einen Entwicklungsplan voller Produkte.“

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.