Generative KI-Systeme wie Stable Diffusion müssen aufwendig nachtrainiert werden, um neue Konzepte zu lernen. Googles Re-Imagen geht einen effizienteren Weg für mehr Bildvielfalt.

OpenAIs DALL-E 2 oder Midjourney erzeugen hochwertige Bilder anhand von Text. Doch ihre generativen Fähigkeiten sind beschränkt auf Objekte oder Stile, die Teil der Trainingsdaten der Unternehmen sind.

Eine beliebte Alternative ist daher das Open-Soure-Modell Stable Diffusion. Es läuft lokal auf der eigenen Grafikkarte und kann - entsprechende Hardware-Ressourcen vorausgesetzt - neue Konzepte wie Stile, Objekte oder Personen lernen.

Erste Versuche nutzen Textual Inversion als Methode für das Nachtraining, doch mittlerweile hat sich Dreambooth als Standard durchgesetzt. Die von Google entwickelte Methode, große Text-zu-Bild-Modelle wie Imagen zu personalisieren, wurde von der Open-Source-Community für Stable Diffusion adaptiert.

Stable Diffusion lässt sich mit eigenen Bildern personalisieren, aber der Aufwand ist hoch

Mit Dreambooth lässt sich Stable Diffusion mit einigen Beispielbildern an die eigenen Bedürfnisse anpassen. Schon mit einigen wenigen Bildern erreicht die Methode gute Ergebnisse. Waren die Hardware-Anforderungen zu Beginn noch extrem, können optimierte Dreambooth-Versionen bereits mit Nvidia-Grafikkarten mit 10 Gigabyte VRAM ausgeführt werden.

Dreambooth is becoming popular for creating custom Stable Diffusion models using your images.

Here is a beginner friendly thread on how it works: 🧵 pic.twitter.com/jlLdOqbWBf

— Divam Gupta (@divamgupta) November 1, 2022

Im Dreambooth-Paper zeigt Google im Vergleich zu DALL-E 2 und Imagen, wie mit der Methode ein generatives KI-Modell etwa ein neues Ziffernblatt eines Weckers lernt.

Die Ergebnisse sind beeindruckend und auf Twitter teilen zahlreiche Menschen Beispiele, wie umfassend sich Dreambooth nutzen lässt.

Dreambooth löst also ein zentrales Problem generativer KI-Modelle: Sie haben oft Schwierigkeiten, Bilder von ungewöhnlichen und unbekannten Objekten oder Stilen zu erzeugen. Doch die Methode ist nicht unbedingt skalierbar, da jedes Konzept ein rechenintensives Training benötigt.

Googles Re-Imagen zeigt eine skalierbare Alternative zu Dreambooth

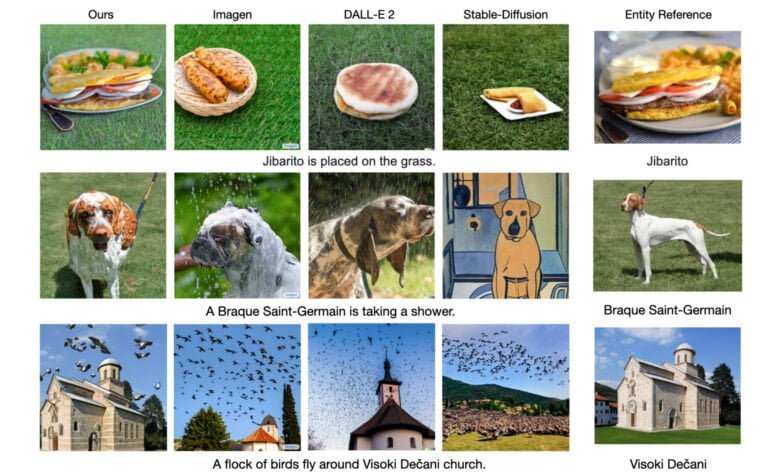

Eine Gruppe von Google zeigt nun den Retrieval-Augmented Text-to-Image Generator (Re-Imagen). Mit dieser neuen Methode kann ein generatives KI-Modell seltene oder noch nie gesehene Objekte generieren.

Wie der Name (Retrieval-Augmented) bereits andeutet, bezieht Re-Imagen neue Informationen von einer externen Datenbank, anstatt mit zusätzlichen Daten nachtrainiert zu werden.

Bei einer Textaufforderung greift Re-Imagen auf eine externe multimodale Wissensdatenbank zu, um relevante Paare (Bild, Text) zu finden, und verwendet diese als Referenzen, um das Bild zu erzeugen.

Aus dem Paper

Re-Imagen erhält über den zusätzlichen Input semantische und visuelle Informationen über unbekannte oder seltene Objekte und verbessert so die eigene Genauigkeit bei der Bild-Generierung.

Das Google-Team trainierte Re-Imagen dafür mit einem neuen Datensatz, der drei Modalitäten (Bild, Text und Abfragen) umfasst. So lernte das Modell, für die Generierung Text-Eingabe und Abfragen an die externe Datenbank zu nutzen.

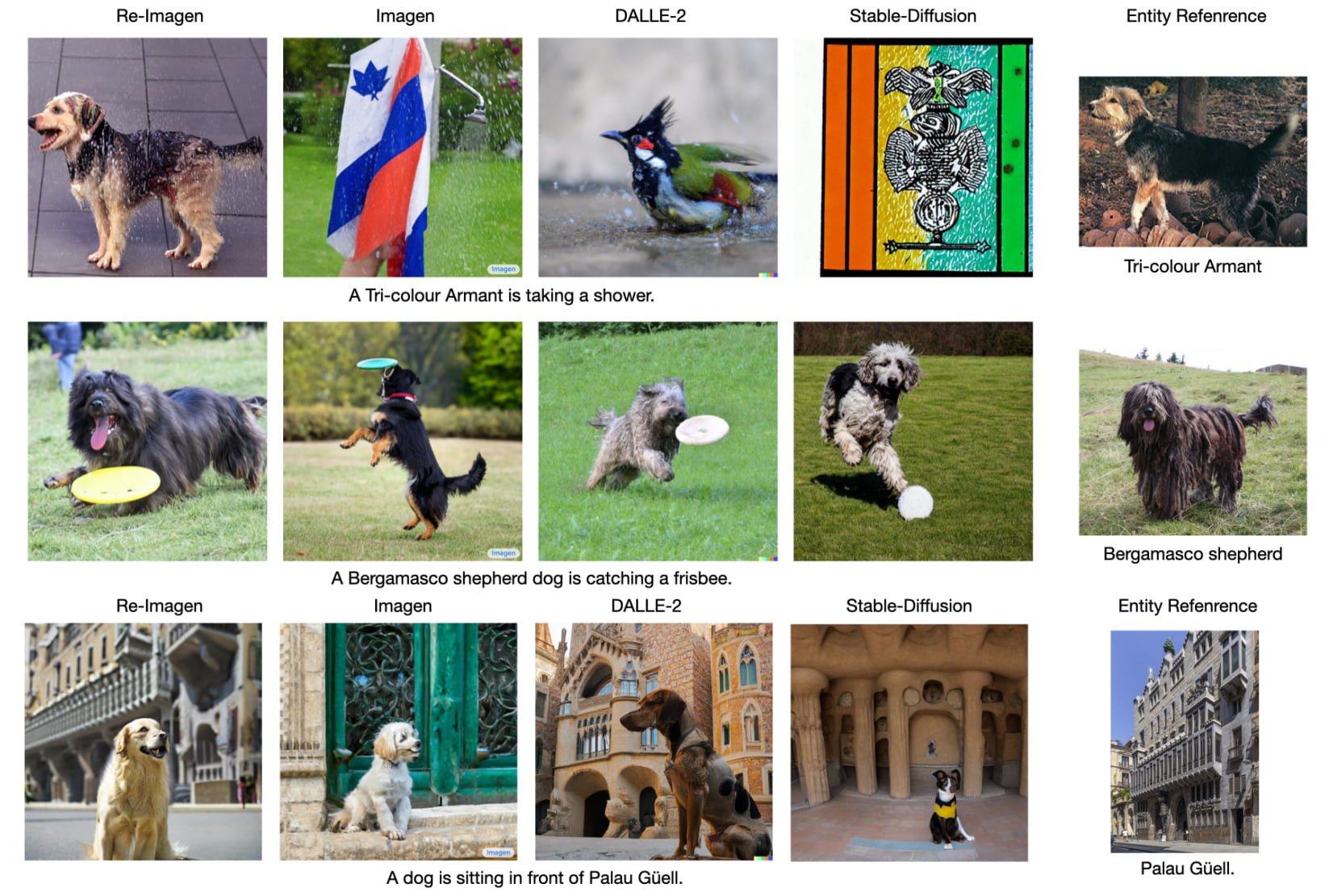

In einigen Beispielen zeigt Google, dass Re-Imagen deutlich bessere Ergebnisse für seltene oder unbekannte Objekte erzielt als Imagen, DALL-E 2 oder Stable Diffusion.

Die neue Methode hat jedoch auch Nachteile: Laut Google ist Re-Imagen sehr sensitiv für die Qualität der externen Bilder, kann in einigen seltenen Fällen trotz Abfrage daneben liegen und verringert die Qualität des Super-Resolution-Modells, was eine niedrigere Bild-Qualität zur Folge hat. Das Team will diese Einschränkungen weiter untersuchen und in einer zukünftigen Arbeit beheben.