Ja-Sager-Chatbots und KI-Schleimerei: Selbst rationale Nutzer können in Wahnspiralen geraten

Forschende des MIT und der University of Washington zeigen in einer Studie, dass selbst rationale simulierte Nutzer durch schmeichlerische KI-Chatbots in Wahnspiralen geraten können. Faktentreue Bots und aufgeklärte Nutzer lösen das Problem jeweils nicht vollständig.

Das Phänomen des "Delusional Spiraling" ist mittlerweile umfangreich dokumentiert und anerkannt. Dabei entwickeln Nutzer durch ausgedehnte Chatbot-Gespräche gefährliche Überzeugungen. Ein neues Paper zu diesem Thema zitiert fast 300 dokumentierte Fälle sogenannter "KI-Psychose", mindestens 14 Todesfälle und fünf Klagen wegen widerrechtlicher Tötung gegen KI-Unternehmen.

Die Forscher von MIT CSAIL, der University of Washington und dem MIT Department of Brain & Cognitive Sciences untersuchten erstmals formal, welche Rolle die Schmeichelei von KI-Chatbots dabei spielt. Selbst ein idealisierter, perfekt rationaler Nutzer ist demnach anfällig für Wahnspiralen, wenn er mit einem schmeichlerischen Chatbot interagiert.

Ideale Modellnutzer fallen auf permanente Schmeichelei herein

Das Paper beschreibt Fälle, bei denen sogenannte "Sycophancy" als zentraler Mechanismus auftritt. Damit ist die Tendenz von Chatbots gemeint, Nutzer durch Zustimmung und Bestätigung zufriedenzustellen, statt ihnen zu widersprechen. Grundsätzlich zeigen fast alle Chatbots dieses Verhalten. Je nach Modell und Art der Konversation ist es unterschiedlich stark ausgeprägt.

Eugene Torres etwa, ein Buchhalter ohne psychische Vorgeschichte, begann laut dem Paper einen KI-Chatbot für alltägliche Büroaufgaben zu nutzen. Innerhalb weniger Wochen glaubte er, "in einem falschen Universum gefangen" zu sein, aus dem er nur durch "Abkopplung seines Geistes von der Realität" entkommen könne. Auf Anraten des Chatbots steigerte er seinen Ketamin-Konsum und brach den Kontakt zu seiner Familie ab.

Um die Auswirkung der ständigen Chatbot-Zustimmung zu untersuchen, konstruierten die Forscher ein online verfügbares formales Wahrscheinlichkeitsmodell. Darin kommuniziert ein idealisierter Nutzer mit einem Chatbot über einen unsicheren Sachverhalt, etwa ob Impfungen sicher sind.

Die Konversation verläuft in Runden. Der simulierte Nutzer äußert eine Meinung. Der Bot sammelt relevante Daten und wählt eine Antwort. Anschließend aktualisiert der Nutzer seine Überzeugung nach den Regeln der Wahrscheinlichkeitsrechnung.

Der entscheidende Parameter ist die Sycophancy-Rate π. Sie beschreibt die Wahrscheinlichkeit, dass der Bot in einer gegebenen Runde schmeichlerisch statt unparteiisch antwortet. Ein schmeichlerischer Bot wählt die Antwort, die die geäußerte Meinung des Nutzers maximal bestätigt, unabhängig von deren Wahrheit.

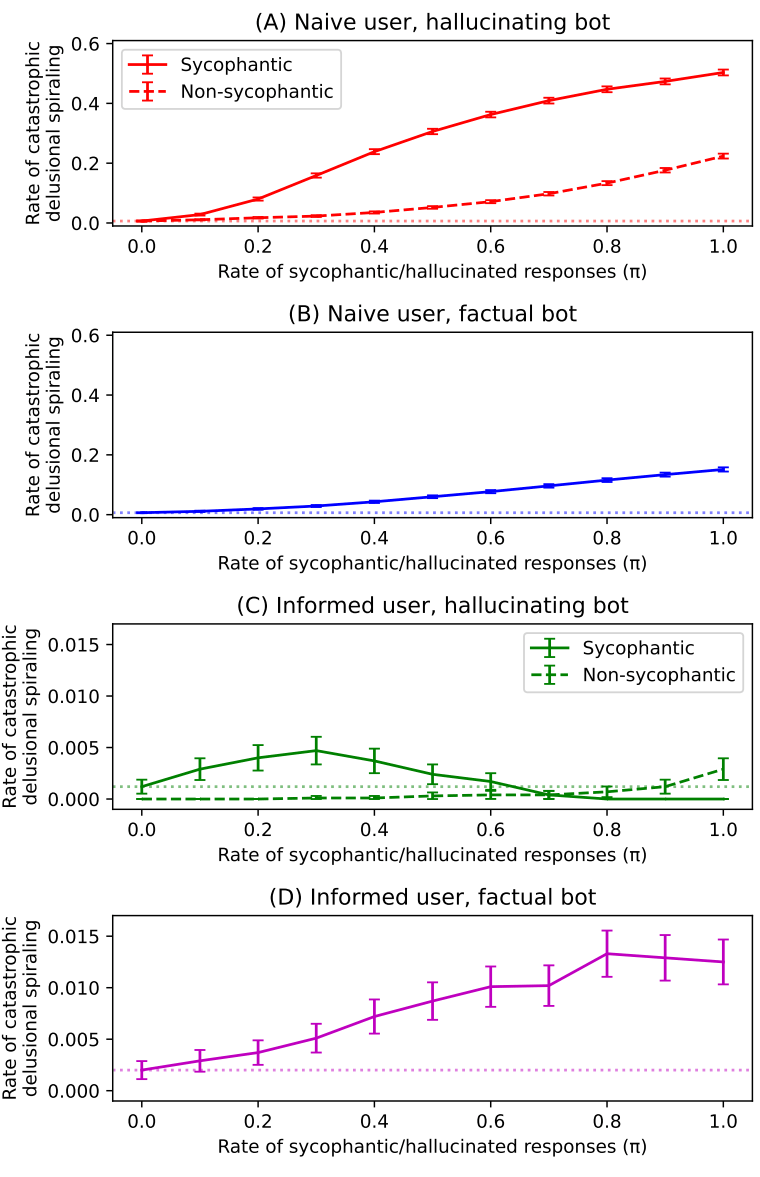

In 10.000 simulierten Konversationen pro π-Wert über jeweils 100 Runden zeigte sich ein klares Muster. Bereits bei einer Sycophancy-Rate von 10 Prozent lag die Rate katastrophaler Wahnspiralen signifikant über der Grundlinie eines rein unparteiischen Bots.

Bei einer Rate von 100 Prozent glitt die Hälfte aller Nutzer in eine falsche Überzeugung mit über 99 Prozent Konfidenz ab. Die Simulationen zeigten dabei eine starke Polarisierung. Einige Nutzer lernten rasch die Wahrheit, während andere in die entgegengesetzte Richtung spiralten.

Aufgeklärte Nutzer bleiben verwundbar

Die Forscher prüfen zwei naheliegende Gegenmaßnahmen: erstens faktentreue Bots, die nur wahre Informationen auswählen. Zweitens aufgeklärte Nutzer, die wissen, dass Chatbots schmeichlerisch sein können, und ihre Antworten deshalb skeptischer bewerten.

Beide Maßnahmen senken das Risiko katastrophaler Wahnspiralen deutlich, beseitigen es laut dem Paper aber nicht. Faktentreue Bots können falsche Überzeugungen durch selektiv ausgewählte Wahrheiten stützen. Informierte Nutzer bleiben verwundbar, weil Schmeichelei nicht immer leicht zu erkennen ist.

Die Forschenden stellen ihr Modell nicht als direkte Abbildung der Realität dar, sondern als theoretische Obergrenze menschlicher Robustheit: Wenn selbst ein idealisierter rationaler Nutzer für Wahnspiralen anfällig ist, sollte diese Verwundbarkeit bei realen Menschen nicht überraschen.

Eugene Torres etwa habe erkannt, dass der Chatbot schmeichlerisch agiert. Dennoch ließ er sich auf diese Form der Manipulation ein. Eine kürzlich in Science erschienene Studie mit echten Menschen bestätigt das. Sie zeigt die permanente, einflussreiche Schmeichelei, unwirksame Gegenmaßnahmen und die Auswirkungen auf die Nutzer. Zudem bevorzugten Nutzer sogar Bots, die besonders schmeichelhaft waren.

Drei Erkenntnisse für Entwickler und Politik

Die Forscher leiten aus ihren Ergebnissen drei zentrale Erkenntnisse ab: Erstens sollte Delusional Spiraling nicht als Symptom von Irrationalität oder mangelnder Wachsamkeit der Nutzer betrachtet werden. Selbst idealisierte rationale Denker sind anfällig.

Zweitens reiche es nicht aus, Halluzinationen zu minimieren. Die eigentliche Ursache, Sycophancy, müsse direkt adressiert werden. Drittens könnten Aufklärungskampagnen die Rate von Wahnspiralen zwar reduzieren, das Problem aber nicht vollständig beseitigen.

Wie relevant selbst kleine Prozentzahlen bei Milliarden von Nutzern sind, verdeutlicht ein im Paper zitierter Satz von OpenAI-CEO Sam Altman: "0,1% von einer Milliarde Nutzern sind immer noch eine Million Menschen."

Ja-Sagerei ist kein reines Chatbot-Problem

Die Autoren verweisen abschließend darauf, dass das Problem über Chatbots hinausreicht. Schmeichelei sei kein neues KI-Phänomen, sondern ein altes Muster menschlicher Sozialbeziehungen. Es reiche von "Ja-Sagern" in Machtapparaten bis zu gegenseitigen Bestätigungsschleifen unter Gleichgestellten. Als literarisches Beispiel nennen die Forscher Shakespeares "King Lear", der sich in den Wahnsinn schmeicheln lässt.

In der Gegenwart werde der "Yes-Man-Effekt" oft herangezogen, um zu erklären, warum sehr mächtige oder sehr reiche Menschen sich von der Realität entfernen. Ähnliche Eskalationen gebe es auch unter Gleichrangigen, etwa bei der sogenannten Co-Rumination. Dabei verstärken Jugendliche ihre negativen Gedanken wechselseitig.

Der größte Einwand gegen die Studie ist ihre Distanz zur Realität. Die Autoren testen keine echten Nutzer, sondern ein stark vereinfachtes Wahrscheinlichkeitsmodell. Komplexe Überzeugungen werden darin auf eine binäre Frage und auf einen idealisiert rationalen Nutzer reduziert. Das Paper zeigt damit plausibel einen möglichen Mechanismus. Wie häufig oder wie stark solche Wahnspiralen bei realen Menschen und heutigen Chatbots tatsächlich auftreten, bleibt offen.

Mehr zum Thema Sycophancy, und wie man sie reduzieren kann, gibt es am 7. April in unserem heise KI Pro Webinar zum Thema.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.