Einige Nachrichtenunternehmen nutzen bereits KI, um jede Woche Tausende Artikel zu schreiben. Was bedeutet das für die Zukunft von Journalist:innen und Verbraucher:innen?

Unternehmen setzen zunehmend künstliche Intelligenz (KI) ein, um Medieninhalte, einschließlich Nachrichten, zu erstellen und ihre Kund:innen anzusprechen. Inzwischen wird KI sogar zur "Gamification" von Nachrichten eingesetzt, um Nachrichteninhalte interaktiver zu gestalten. KI verändert das Wesen der Nachrichtenmedien - im Guten wie im Schlechten. Und wir müssen uns dessen bewusst sein, wenn wir die Integrität dieser Institution schützen wollen.

Wie ist sie gestorben?

Stellen Sie sich vor, Sie lesen einen tragischen Artikel über den Tod eines jungen Sporttrainers an einer renommierten Schule in Sydney.

In einem Kasten auf der rechten Seite finden Sie eine Umfrage, in der Sie gebeten werden, über die Todesursache zu spekulieren. Die Umfrage ist KI-generiert. Sie soll Sie dazu bringen, sich weiter mit dem Artikel zu beschäftigen, da Sie dann eher auf die Werbung des Umfragebetreibers reagieren.

Dieses Szenario ist nicht hypothetisch. Es wurde in der jüngsten Berichterstattung von The Guardian über den Tod von Lilie James durchgespielt.

Im Rahmen einer Lizenzvereinbarung hat Microsoft die Geschichte des Guardian auf seiner Nachrichten-App und der Website Microsoft Start veröffentlicht. Die Umfrage basierte auf dem Inhalt des Artikels und wurde neben diesem angezeigt, aber The Guardian hatte weder Einfluss noch Kontrolle über sie.

Hätte der Artikel über ein bevorstehendes Sportereignis berichtet, wäre eine Umfrage über den wahrscheinlichen Ausgang harmlos gewesen. Dieses Beispiel zeigt jedoch, wie problematisch es werden kann, wenn KI beginnt, sich mit Nachrichtenseiten zu vermischen, einem Produkt, das traditionell von Expert:innen kuratiert wird.

Der Vorfall löste entsprechende Irritationen aus. In einem Brief an Microsoft-Chef Brad Smith bezeichnete Anna Bateson, Geschäftsführerin der Guardian Media Group, den Vorfall als "unangemessenen Einsatz von Gen AI [Generativer KI]", der dem Guardian und dem Journalisten, der die Geschichte geschrieben hatte, "erheblichen Imageschaden" zugefügt habe.

Natürlich wurde der Artikel entfernt. Aber es stellt sich die Frage: Warum hat Microsoft das überhaupt zugelassen?

Die Folgen des Verzichts auf den gesunden Menschenverstand

Der erste Teil der Antwort ist, dass ergänzende Nachrichtenprodukte wie Umfragen und Quizze die Leser:innen tatsächlich ansprechen, wie Untersuchungen des Center for Media Engagement an der University of Texas ergeben haben.

Da der Einsatz von KI zu diesem Zweck kostengünstig ist, ist es wahrscheinlich, dass Nachrichtenunternehmen (und Unternehmen, die Nachrichten anderer anzeigen) dies auch weiterhin machen werden.

Der zweite Teil der Antwort ist, dass bei dem Microsoft-Vorfall keine oder nur eine begrenzte menschliche Beteiligung vorlag.

Die wichtigsten Anbieter großer Sprachmodelle - den Modellen, die den verschiedenen KI-Programmen zugrunde liegen - haben ein finanzielles und Reputationsinteresse daran, dass ihre Programme keinen Schaden anrichten. OpenAI mit seinen GPT-Modellen und DALL-E, Google mit PaLM 2 (verwendet in Bard) und Meta mit seinem Open-Source-Modell Llama 2 haben alle erhebliche Anstrengungen unternommen, um sicherzustellen, dass ihre Modelle keine schädlichen Inhalte erzeugen.

Sie tun dies oft durch einen Prozess, der als "Verstärkungslernen" bezeichnet wird, bei dem Menschen Antworten auf Fragen kuratieren, die zu Schaden führen könnten. Dies verhindert jedoch nicht immer, dass die Modelle unangemessene Inhalte produzieren.

Es ist wahrscheinlich, dass sich Microsoft auf die schadensmindernden Aspekte seiner KI verlassen hat, anstatt darüber nachzudenken, wie der Schaden, der durch den tatsächlichen Einsatz des Modells entstehen könnte, minimiert werden könnte. Letzteres erfordert gesunden Menschenverstand - eine Eigenschaft, die sich nicht in große Sprachmodelle einprogrammieren lässt.

Tausende von KI-generierten Artikeln pro Woche

Generative KI wird immer zugänglicher und erschwinglicher. Das macht sie für kommerzielle Nachrichtenunternehmen attraktiv, die mit Umsatzeinbußen zu kämpfen haben. Die KI "schreibt" jetzt Nachrichten und erspart den Unternehmen, Journalistengehälter zu zahlen.

Im Juni gab der Vorstandsvorsitzende von News Corp, Michael Miller, bekannt, dass das Unternehmen über ein kleines Team verfügt, das mithilfe von KI etwa 3.000 Artikel pro Woche produziert.

Im Wesentlichen sorgt das vierköpfige Team dafür, dass die Inhalte Sinn ergeben und keine "Halluzinationen" enthalten: falsche Informationen, die ein Modell erfindet, wenn es keine passende Antwort auf eine Eingabe vorhersagen kann.

Während diese Nachrichten wahrscheinlich wahr sind, können die gleichen Werkzeuge verwendet werden, um potenziell irreführende Inhalte zu generieren, die sich als Nachrichten ausgeben und kaum von Artikeln professioneller Journalist:innen zu unterscheiden sind.

Seit April hat eine Untersuchung von NewsGuard Hunderte von Websites in mehreren Sprachen gefunden, die größtenteils oder vollständig von KI generiert wurden, um echte Nachrichtenseiten zu imitieren. Einige davon enthielten schädliche Fehlinformationen, wie die Behauptung, US-Präsident Joe Biden sei gestorben.

Es liegt nahe, dass Websites, die mit Werbung überflutet sind, wahrscheinlich erstellt wurden, um Werbeeinnahmen zu erzielen.

Mit dem technologischen Fortschritt steigt auch das Risiko

Generell sind viele große Sprachmodelle durch die ihnen zugrunde liegenden Trainingsdaten begrenzt. Modelle, die mit Daten bis 2021 trainiert wurden, werden etwa keine genauen "Nachrichten" über das Weltgeschehen im Jahr 2022 liefern.

Dies ändert sich jedoch, da die Modelle jetzt feinjustiert werden können, um auf bestimmte Quellen zu reagieren. In den vergangenen Monaten wurde ein KI-Framework namens "Retrieval Augmented Generation" entwickelt, das es den Modellen ermöglicht, sehr aktuelle Daten zu verwenden.

Mit dieser Methode wäre es sicherlich möglich, lizenzierte Inhalte von einer kleinen Anzahl von Medien zu verwenden, um eine Nachrichtenwebsite zu erstellen.

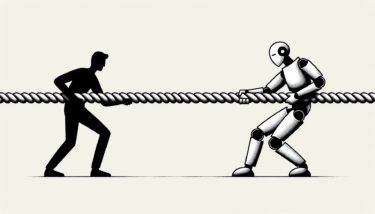

Dies mag aus kommerzieller Sicht praktisch sein, ist aber nur eine weitere Möglichkeit, wie KI den Menschen aus dem Prozess der Nachrichtenerstellung und -verbreitung verdrängen könnte.

Eine redaktionell bearbeitete Nachrichtenseite ist ein wertvolles und durchdachtes Produkt. Wird diese Arbeit der KI überlassen, könnten wir (vor allem ohne menschliche Kontrolle) allen Arten von Fehlinformationen und Voreingenommenheit ausgesetzt sein, oder es könnte zu einem Mangel an wichtiger lokaler Berichterstattung kommen.

Wenn wir an der falschen Stelle sparen, verlieren alle

Der australische "News Media Bargaining Code" wurde entwickelt, um die Wettbewerbsbedingungen zwischen großen Technologie- und Medienunternehmen anzugleichen. Seit Inkrafttreten des Kodex hat sich durch den Einsatz von generativer KI eine zweite Veränderung ergeben.

Abgesehen von der Klickwürdigkeit gibt es derzeit keinen Vergleich zwischen der Qualität der Nachrichten, die Journalist:innen produzieren können, und dem, was KI produzieren kann.

Während generative KI die Arbeit von Journalist:innen unterstützen kann, indem sie ihnen beispielsweise hilft, große Mengen an Inhalten zu sortieren, haben wir viel zu verlieren, wenn wir sie als Ersatz betrachten.