KI-Modell Flux 2 klein bringt Bildgenerierung und -bearbeitung auf heimische Grafikkarten

Kurz & Knapp

- Das Freiburger KI-Startup Black Forest Labs stellt Flux 2 klein vor, eine Modellfamilie, die Text-zu-Bild-Generierung, Bildbearbeitung und Multi-Reference-Generierung in einem kompakten Modell vereint und auf Consumer-Grafikkarten wie der RTX 3090 läuft.

- Die Familie besteht aus einem 9-Milliarden- und einem 4-Milliarden-Parameter-Modell. Das kleinere Modell benötigt nur 13 Gigabyte VRAM, quantisierte Versionen sollen bis zu 2,7-fache Geschwindigkeit bei deutlich geringerem Speicherbedarf erreichen.

- Das 4B-Modell ist unter Apache-2.0-Lizenz für kommerzielle Nutzung freigegeben, während das 9B-Modell einer Non-Commercial-Lizenz unterliegt.

Black Forest Labs bringt Flux 2 klein heraus: Das deutsche KI-Startup vereint Bildgenerierung und -bearbeitung in einem kompakten Modell, das auf Consumer-Grafikkarten wie der RTX 3090 läuft.

Die neuen Modelle erweitern die im November vorgestellte Flux-2-Familie um zwei Hauptvarianten: ein 9-Milliarden-Parameter-Modell als Flaggschiff und eine schlankere Version mit 4 Milliarden Parametern für den breiteren Einsatz. Beide gibt es zusätzlich als undestillierte Base-Varianten, gedacht für Forschung und Fine-Tuning.

Generierung und Editing lokal auf Consumer-GPUs

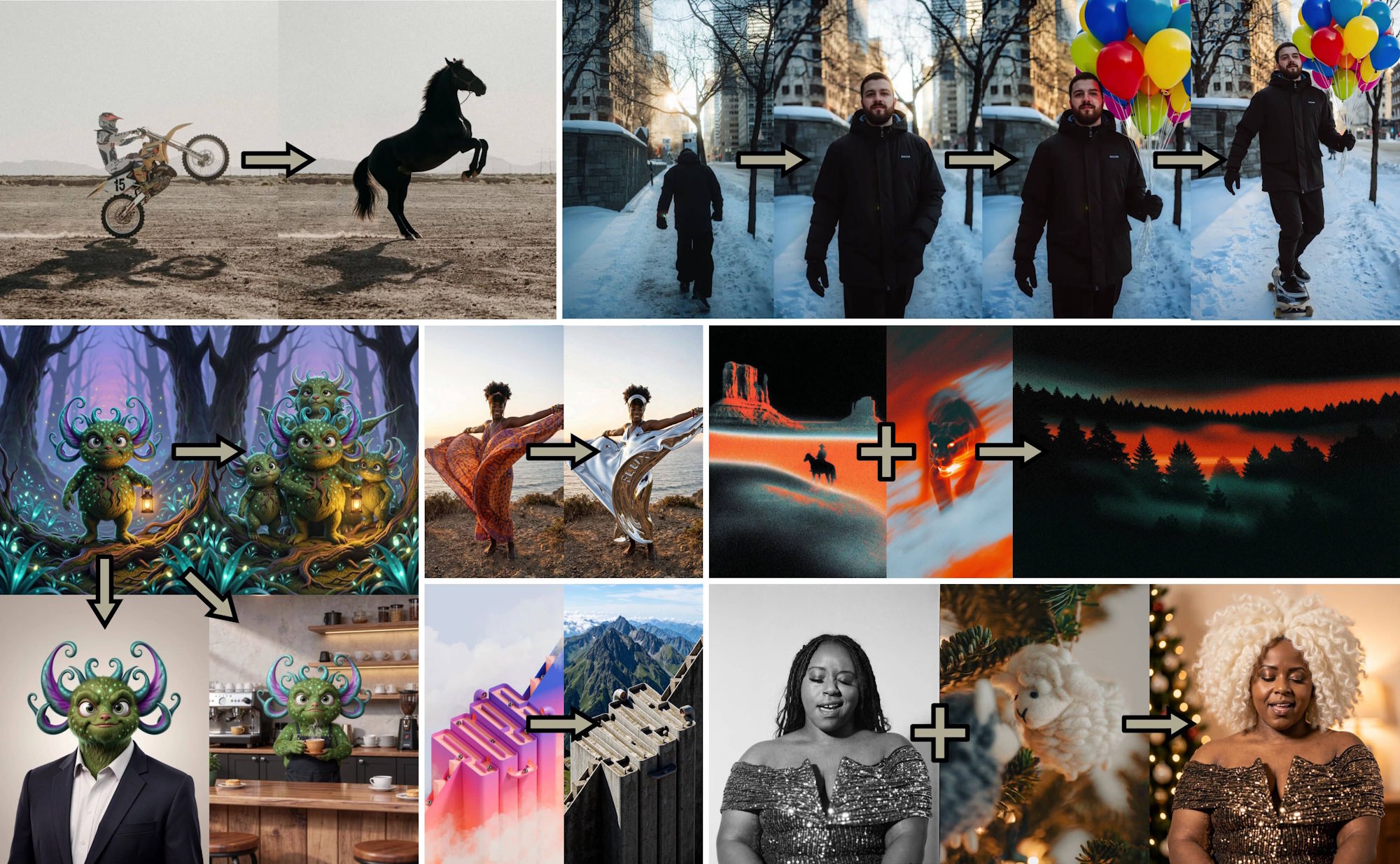

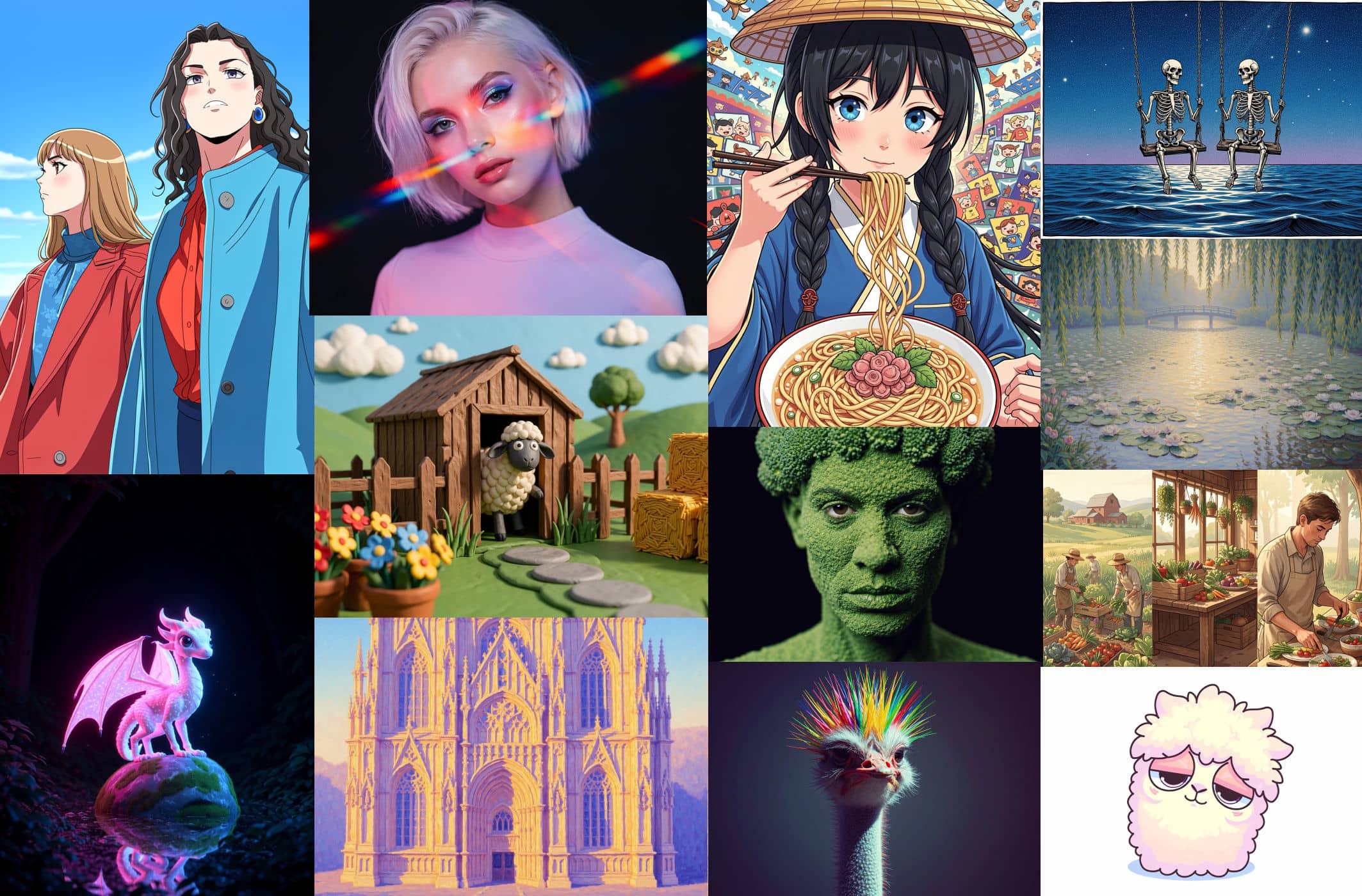

Flux 2 klein vereint laut Black Forest Labs drei Fähigkeiten in einem einzigen Modell: Text-zu-Bild-Generierung, Bildbearbeitung und sogenannte Multi-Reference-Generierung, bei der mehrere Eingabebilder zu neuen Kompositionen kombiniert werden können.

Die Kombination dieser Fähigkeiten ist nicht neu, den Grundstein legte Black Forest mit dem Modell Flux 1 Kontext vor weniger als einem Jahr. Das Besondere an Flux 2 klein ist vielmehr, dass diese vereinheitlichte Architektur nun erstmals in einem so kompakten Modell verfügbar wird, das auf Consumer-Hardware läuft. Black Forest Labs gibt an, dass das 4B-Modell mit 13 Gigabyte VRAM auskomme und auf Grafikkarten wie der Nvidia RTX 3090 oder RTX 4070 laufe.

Geschwindigkeitsversprechen mit Einschränkungen

Das 9B-Modell nutzt eine sogenannte Flow-Architektur und wurde so optimiert, dass es Bilder in nur vier Rechenschritten erzeugt. Black Forest Labs verspricht eine Generierungszeit von unter 0,5 Sekunden, allerdings gemessen auf Nvidias GB200, einem professionellen Server-Chip, nicht auf handelsüblichen Grafikkarten.

Zusätzlich zu den Standardmodellen hat Black Forest Labs in Zusammenarbeit mit Nvidia quantisierte Versionen entwickelt. Bei der Quantisierung werden die Gewichte eines Modells mit geringerer Präzision gespeichert, was sowohl den Speicherbedarf als auch die Rechenzeit reduziert.

Die FP8-Variante (8-Bit-Gleitkommaformat) soll laut Black Forest Labs bis zu 1,6-mal schneller sein bei bis zu 40 Prozent weniger VRAM-Verbrauch. Die NVFP4-Variante verwendet ein proprietäres 4-Bit-Gleitkommaformat von Nvidia, was bis zu 2,7-fache Geschwindigkeit bei bis zu 55 Prozent weniger Speicherbedarf ermöglichen soll. Diese Benchmarks wurden auf den aktuellen RTX-5080- und RTX-5090-Grafikkarten gemessen.

In eigenen Elo-Vergleichen positioniert Black Forest Labs das 9B-Modell als Pareto-optimal für das Verhältnis von Qualität zu Latenz. Das Modell erreiche oder übertreffe die Qualität von Qwen bei einem Bruchteil der Latenz und des VRAM-Verbrauchs und überbiete Z-Image. Das Unternehmen behauptet zudem, das 9B-Modell übertreffe Modelle, die fünfmal größer seien. Unabhängige Bestätigungen dieser Aussagen liegen nicht vor.

Umfangreiche Sicherheitsvorkehrungen dokumentiert

Black Forest Labs legt in der Hugging-Face-Dokumentation detailliert dar, welche Sicherheitsmaßnahmen implementiert wurden. Bereits vor dem Training seien die Daten auf NSFW-Inhalte und bekanntes Material sexuellen Kindesmissbrauchs gefiltert worden. Das Unternehmen gibt an, dabei mit der britischen Internet Watch Foundation zusammenzuarbeiten.

Nach dem Training folgten laut Black Forest Labs mehrere Runden gezieltes Fine-Tuning gegen potenzielle Missbrauchsszenarien. Das Repository enthält Filter für NSFW-Inhalte in Ein- und Ausgaben sowie Unterstützung für Pixel-Layer-Watermarking und den C2PA-Standard für Herkunftsnachweise.

Zu den Einschränkungen des Modells zählt das Unternehmen, dass es nicht für faktische Informationen geeignet sei, Textausgaben ungenau sein können und das Prompt-Following stark vom Prompting-Stil abhänge.

Unicorn-Status nach Serie-B-Runde

Die Veröffentlichung von Flux 2 klein fällt in eine Phase rasanten Wachstums für das Freiburger Unternehmen. Im Dezember 2025 schloss Black Forest Labs eine 300-Millionen-Dollar-Serie-B-Runde ab, die das Startup auf eine Bewertung von 3,25 Milliarden US-Dollar katapultierte. Insgesamt hat das erst 2024 gegründete Unternehmen damit 450 Millionen Dollar eingesammelt. Die Flux-Modelle waren auch über xAIs Chatbot Grok verfügbar, mittlerweile hat Elon Musks KI-Firma jedoch auch ihr eigenes, fotorealistisches Bildmodell entwickelt.

Black Forest Labs positioniert sich bewusst als Infrastrukturanbieter für andere Unternehmen statt als Anbieter von Endnutzer-Apps. Zuvor hatte das Unternehmen angekündigt, auch an einem konkurrenzfähigen Videogenerator zu arbeiten.

Bei den Lizenzen unterscheidet Black Forest Labs zwischen den Modellgrößen: Das kleinere 4B-Modell steht unter der offenen Apache-2.0-Lizenz und darf ohne Einschränkungen kommerziell genutzt werden. Das leistungsfähigere 9B-Modell hingegen ist nur für nicht-kommerzielle Zwecke freigegeben. Wer es geschäftlich einsetzen will, muss eine separate Lizenz erwerben.

Eine Referenz-Implementierung stellt Black Forest Labs auf GitHub bereit. Das Modell ist zudem in die beliebte Workflow-Software ComfyUI und die Python-Bibliothek Diffusers integriert.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren