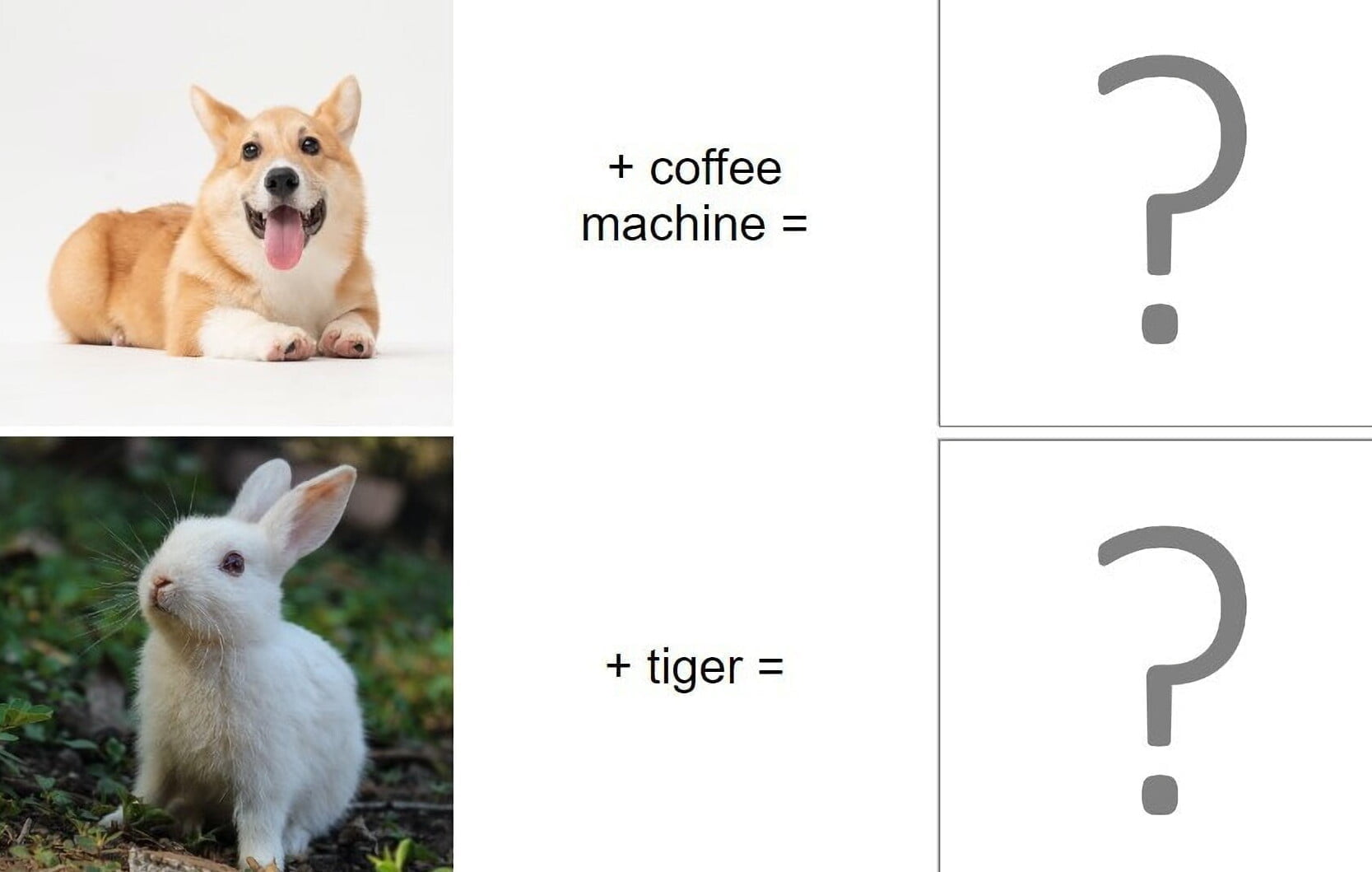

Die TikTok-Firma Bytedance zeigt eine neue Bildgenerierungsmethode, die zwei inhaltliche Konzepte zu einem neuen vermischen kann.

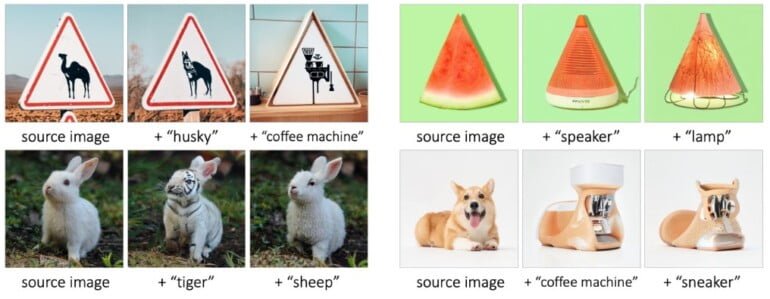

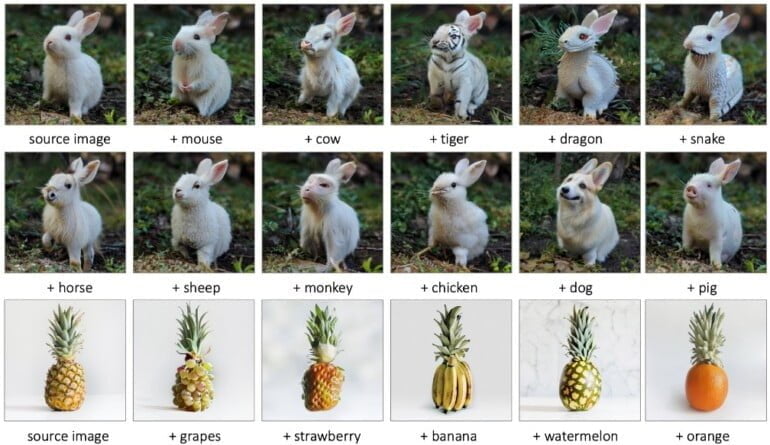

"Semantic Mixing" nennt das Bytedance-Forschungsteam den Prozess, bei dem ein Diffusion-Modell angewiesen wird, zwei semantische Konzepte zu einem neuen zu vermischen: Aus einer Wassermelone und einer Lampe wird so etwa eine Lampe in Form einer Wassermelone. Aus Tiger und Kaninchen wird ein getigertes Kaninchen.

Das semantische Mischen bezeichnen die Forschenden als schwieriges Problem, da selbst Menschen nicht immer genau sagen könnten, wie ein Ergebnis solch einer Mischung aussehen könnte.

Melonenlampen und Tigerkaninchen

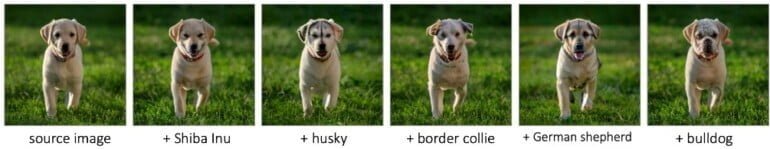

Anders als beim Style-Transfer, bei dem der Bildinhalt unverändert bleibt und nur der Stil angepasst wird (aus einer Rendergrafik wird etwa eine gezeichnete Grafik), entstehen beim Semantic Mixing neue Motive. Layout und Geometrie des Ursprungsbildes bleiben dabei erhalten, was zu einer höheren Präzision und Stabilität bei der Bildgenerierung beiträgt.

Das Bytedance-Team verwendet für die Entwicklung der MagicMix-Methode Stable Diffusion 1.4 als Bild-KI. Das Diffusionsmodell, das aus Rauschen Bilder herausarbeitet, generiert zunächst Layout und Form eines Bildes. Erst im späteren Verlauf des Entrauschungsprozesses folgt das semantische Konzept.

Diese Zweistufigkeit macht sich MagicMix zunutze: Bytedance Methode erhält ebenfalls zunächst das grobe Layout anhand eines Bildes oder eines Textes. Dann stellt es im Generierungsprozess den Prompt auf das zweite semantische Konzept um. Eine räumliche Maske oder ein erneutes Training sind nicht notwendig.

KI-Bildbearbeitung wird noch flexibler

Der Prozess funktioniert sogar umgekehrt: MagicMix kann semantische Konzepte aus Bildern entfernen. Die Ergebnisse sind im Vergleich zur Konzeptmischung aber eher skurril. So wird aus einem Katzenbild ohne Katzen-Konzept ein seltsames Chamäleon. Ein Hundebild ohne Hund wird zu einer Sphinx-artigen Katze.

Interessant ist die Mischung von Tierrassen. Das zuvor genannte Tigerkaninchen ist ein ausgefallenes Beispiel, aber es geht auch realitätsnäher, etwa bei der Kreuzung von Hunderassen. Hier zeigt sich, dass die vermischten Konzepte ein Abbild der Realität darstellen können.

Ebenso sind fiktive Motive möglich, die etwa Kreative als Inspiration für ihre Arbeit verwenden könnten.

Eine Stärke von MagicMix, die Beibehaltung des Layouts, ist zugleich eine Schwäche: Die Methode versagt, wenn sie inhaltliche Konzepte ohne Formähnlichkeit vermischen soll. Mischt man einen Lieferwagen mit einer Katze, entsteht statt einer Katze mit Reifen oder eines Lieferwagens mit Schnurrbarthaaren eine Katze auf einem Lieferwagen (oder ... nun ja).

Trotz dieser Einschränkung geht das Bytedance-Team davon aus, dass MagicMix weitere Möglichkeiten und Freiheiten beim Einsatz von Bild-KI-Systemen schafft.

Dank der starken Fähigkeit, neue Konzepte zu generieren, unterstützt unser MagicMix eine große Vielfalt von kreative Anwendungen, einschließlich semantischer Stilübertragung (z. B. Generierung eines neuen Zeichens anhand eines Zeichenlayout und einem bestimmten gewünschten Inhalt), neuartige Objektsynthese (z. B. Erzeugung einer Lampe, die wie eine Wassermelonenscheibe aussieht), Rassenmischung (z. B. Erzeugung einer neuen Spezies durch Mischung von "Kaninchen" und "Tiger") und Konzeptentfernung (z. B. Synthese eines nicht-orangenen Objekts, das wie eine Orange aussieht). Obwohl die Lösung einfach ist, ebnet sie eine neue Richtung im Bereich der Computergrafik und bietet neue Möglichkeiten für KI-gestützte Entwürfe für Künstler in einem weiten Bereich, wie z. B. Unterhaltung, Kinematographie, und CG-Effekte.

Auszug aus dem Paper

Da MagicMix auf Stable Diffusion basiert, was wiederum unter anderem mit einem LAION-Datensatz trainiert ist, weist das Bytedance-Team auf "soziale und kulturelle Verzerrungen" bei der Bildgenerierung hin.