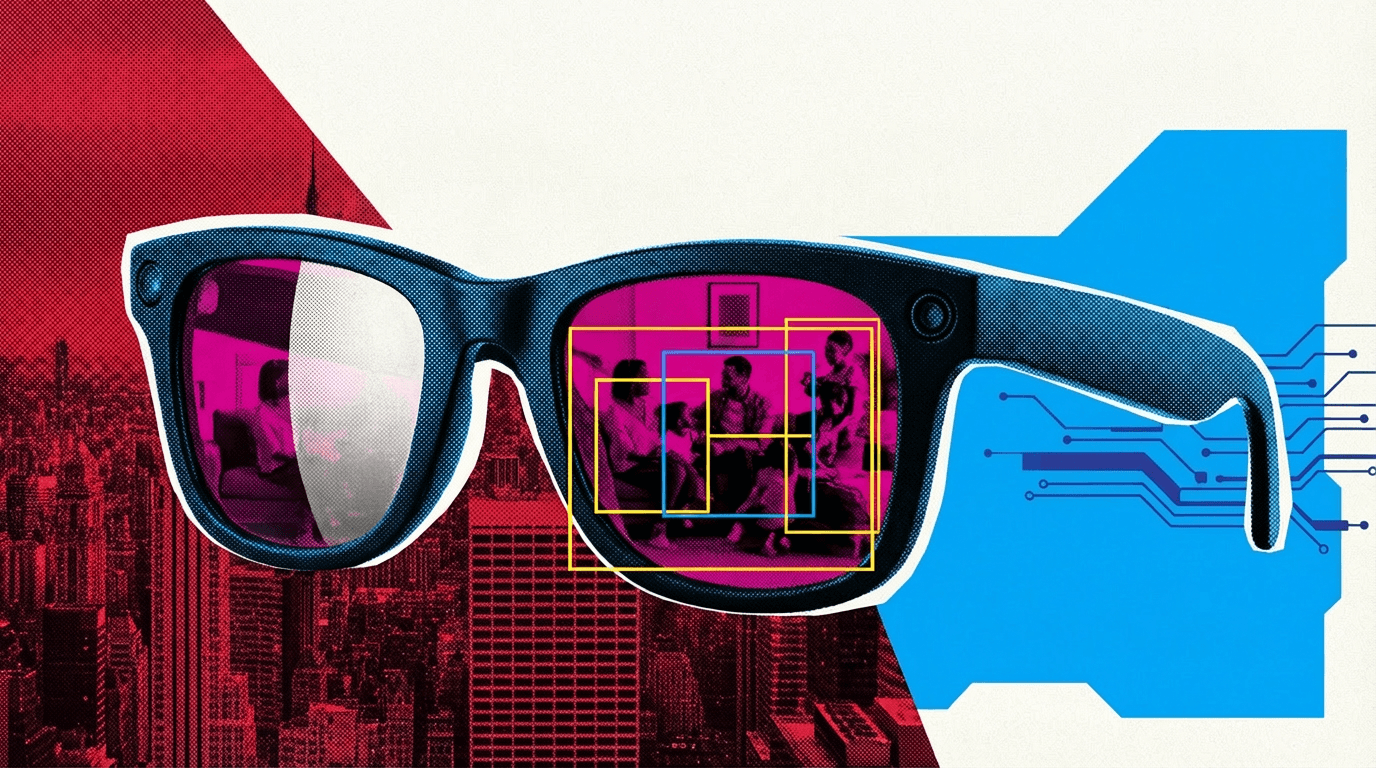

Meta lässt Subunternehmer in Kenia intime Nutzervideos aus KI-Brillen sichten

Kurz & Knapp

- Meta lässt Videodaten seiner Ray-Ban-KI-Brille von Datenarbeitern in Nairobi annotieren. Diese sehen dabei laut einer schwedischen Recherche Nacktszenen, Sexvideos und Bankdaten.

- Die automatische Anonymisierung von Gesichtern funktioniert laut den Arbeitern nicht zuverlässig. Die Datenschutzorganisation NOYB kritisiert zudem, dass Nutzer oft nicht wüssten, dass die Kamera beim Ansprechen des KI-Assistenten aufnimmt.

- Der beauftragte Dienstleister Sama fiel bereits bei früheren Aufträgen für OpenAI und Meta auf, bei denen kenianische Arbeiter für rund 2 Dollar pro Stunde verstörende Inhalte labeln mussten.

Damit die KI in Metas smarter Brille besser wird, sichten Datenarbeiter in Nairobi private Aufnahmen. Darunter Nacktszenen, Sexvideos und Bankdaten.

Meta bewirbt seine Ray-Ban-Brille auf der eigenen Website als ein Produkt, das "with your privacy in mind" entwickelt wurde und dem Träger Kontrolle darüber gebe, was und wann geteilt wird.

Die Nutzungsbedingungen für die KI-Dienste der Brille räumen dem Unternehmen allerdings weitreichende Rechte ein. Zwar werden Sprachaufnahmen laut Datenschutzrichtlinie nur mit aktiver Zustimmung für Produktverbesserungen gespeichert. Doch damit der KI-Assistent funktioniert, werden Sprache, Text, Bild und teilweise Video automatisch verarbeitet und können weitergegeben werden. Diese Verarbeitung lässt sich nicht abschalten.

Laut einer Recherche von Svenska Dagbladet und Göteborgs-Posten landen die Videodaten der KI-Brille bei Datenannotatoren des von Meta beauftragten Daten-Dienstleisters Sama in Nairobi, Kenia. Die Beschäftigten dort trainieren Metas KI-Systeme, indem sie Objekte in Bildern und Videos markieren, beschriften und kategorisieren.

Nackte Körper, Bankkarten, Sexszenen

Was auf ihren Bildschirmen erscheint, geht weit über Instagram-Reels und Familien-Videos hinaus: Laut der Recherche berichten mehrere Beschäftigte von Videoclips, in denen Menschen nackt aus Badezimmern kommen, sich umziehen oder Sex haben, während die Brille läuft. "Wir sehen alles, von Wohnzimmern bis zu nackten Körpern. Meta hat diese Art von Inhalten in seinen Datenbanken", sagt ein Mitarbeiter gegenüber den schwedischen Medien.

Andere Aufnahmen zeigen versehentlich gefilmte Bankkarten oder Personen, die mit der Brille Pornografie konsumieren. Auch Transkriptionen gehören zur Arbeit: Die Annotatoren prüfen, ob der KI-Assistent korrekt geantwortet hat. Dabei stoßen sie laut eigener Aussage auf Chats über Verbrechen, Proteste und sexuelle Inhalte. "Es sind nicht nur Begrüßungen, es können sehr dunkle Dinge sein", zitiert die Recherche einen Beschäftigten.

Die Arbeiter haben umfangreiche Geheimhaltungsvereinbarungen unterschrieben. In den Büros hängen überall Kameras, eigene Mobiltelefone oder Aufnahmegeräte sind verboten. Wer Fragen stellt, so die Beschäftigten, riskiert seinen Job und damit oft den Rückfall in die Armut.

KI-Training braucht menschliche Augen und das wird zum Problem

Damit Metas Brille Gegenstände erkennt, Sprache versteht und Szenen interpretiert, müssen Menschen die Rohdaten aufbereiten.

Ehemalige Meta-Mitarbeiter in den USA bestätigten gegenüber den schwedischen Journalisten, dass sensible Daten eigentlich nicht für das KI-Training verwendet werden sollen. Gesichter in Annotationsdaten würden automatisch unkenntlich gemacht.

Doch die Datenannotatoren in Kenia berichten, dass die Anonymisierung nicht immer funktioniert. Gesichter, die verdeckt sein sollten, seien manchmal sichtbar. "Die Algorithmen versagen manchmal. Besonders bei schwierigen Lichtverhältnissen werden bestimmte Gesichter und Körper sichtbar", sagte ein ehemaliger Meta-Mitarbeiter.

Kleanthi Sardeli, Datenschutzjuristin bei der Wiener Organisation None Of Your Business (NOYB), die bereits mehrere Klagen gegen Meta geführt hat, sieht ein klares Transparenzproblem. Nutzer wüssten möglicherweise nicht, dass die Kamera aufnimmt, wenn sie den KI-Assistenten ansprechen. Die Art der von Sama verarbeiteten Videos ist ein deutliches Indiz dafür.

"Wenn das in Europa passiert, fehlt sowohl Transparenz als auch eine Rechtsgrundlage für die Verarbeitung", sagte sie gegenüber den schwedischen Medien. Für KI-Training sollte eine ausdrückliche Einwilligung erforderlich sein. "Sobald das Material in die Modelle eingespeist wurde, verliert der Nutzer praktisch die Kontrolle darüber, wie es verwendet wird."

Für Kenia existiert bisher kein Angemessenheitsbeschluss der EU. Ein Dialog zwischen der EU und Kenia wurde erst im Mai 2024 aufgenommen. Meta schreibt in seiner Datenschutzrichtlinie, dass Nutzerdaten global übertragen, gespeichert und verarbeitet werden, da Meta "ein global operierendes Unternehmen" sei. Petra Wierup, Juristin bei der schwedischen Datenschutzbehörde IMY, stellte klar: Wenn Meta Verantwortlicher im Sinne der DSGVO ist, muss der Schutz auch bei Subunternehmern in Drittländern gewährleistet sein und darf nicht schwächer werden.

Sama: Bekannter Name mit belasteter Vorgeschichte

Die Firma Sama ist kein unbeschriebenes Blatt. Bereits 2021 labelte Sama im Auftrag von OpenAI Zehntausende Textpassagen mit Darstellungen von sexuellem Missbrauch, Gewalt und Hassrede. Laut einer TIME-Recherche lag der Stundenlohn der kenianischen Arbeiter damals bei etwa 1,32 bis 2 Dollar. Ein Arbeiter beschrieb die Erfahrung als "Folter". Das Unternehmen half auch Daten für autonome Fahrzeuge zu labeln und war zudem in der Content-Moderation auf Facebook involviert.

Nachdem weitere Berichte Traumatisierung und mutmaßliches Union-Busting in Samas Büro in Nairobi aufdeckten, beendete das Unternehmen 2023 diese Content-Moderation für Meta und konzentrierte sich fortan auf Computer-Vision-Datenannotation, also genau jene Tätigkeit, die nun für die KI-Brille relevant ist.

Die Arbeit der Datenannotatoren wird dabei zunehmend selbst von KI unterstützt, Meta entwickelte für das Training seines Computer-Vision-Modells SAM 3 eine "Data Engine", bei der KI‑Modelle zunächst Segmentierungsvorschläge erzeugen, die anschließend von menschlichen und KI‑Annotatoren überprüft und korrigiert werden. Dieser Prozess soll die Annotation deutlich beschleunigen.

Auch chinesische KI-Unternehmen setzen auf externe Datenarbeiter in Kenia.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren