MiniMax M2.7: Chinesisches KI-Modell soll sich teilweise selbst weiterentwickelt haben

Das chinesische KI-Unternehmen MiniMax hat mit M2.7 ein Modell veröffentlicht, das aktiv an seiner eigenen Entwicklung beteiligt gewesen sein soll. In autonomen Optimierungsschleifen verbesserte es seinen eigenen Trainingsprozess und erzielte dabei teils konkurrenzfähige Benchmark-Ergebnisse.

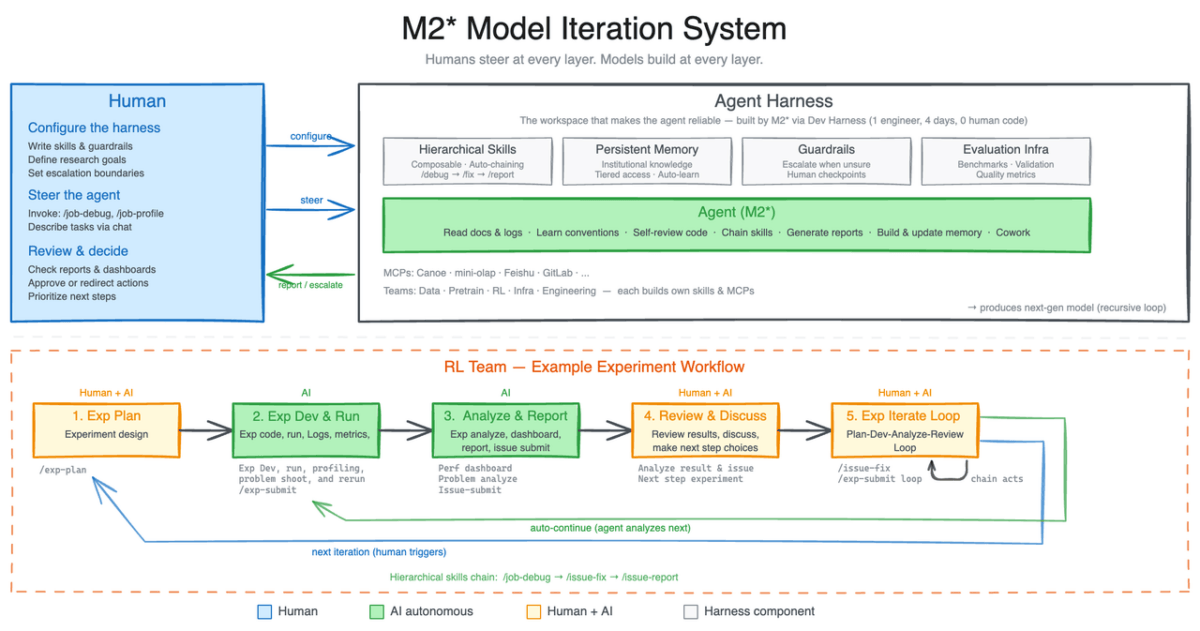

Während der Entwicklung von M2.7 soll das Modell eigenständig seine Wissensspeicher aktualisiert, Dutzende komplexe Fähigkeiten in seiner Agent-Infrastruktur aufgebaut und das belohnungsbasierte Training verbessert haben. Aus den Ergebnissen leitete es wiederum Verbesserungen für seinen eigenen Lernprozess ab. MiniMax bezeichnet M2.7 deshalb als "erstes Modell, das tief an seiner eigenen Evolution beteiligt war" und formuliert die Vision, dass künftige KI-Selbstevolution "schrittweise in Richtung vollständiger Autonomie übergehen" werde.

MiniMax ist nicht das einzige Unternehmen, das diesen Ansatz verfolgt. OpenAI hat kürzlich sein Coding-Modell GPT-5.3 Codex mit ähnlichen Aussagen zur KI-gestützten Entwicklung vorgestellt. Laut OpenAI nutzte das Codex-Team frühe Versionen des Modells, um Fehler im Training zu finden, das Deployment zu steuern und Testergebnisse auszuwerten. Das Team sei überrascht gewesen, wie sehr Codex seinen eigenen Entwicklungsprozess beschleunigt habe, so OpenAI.

Über 100 autonome Optimierungsrunden

Um die Grenzen dieser Selbstoptimierung auszuloten, ließ MiniMax eine interne Version von M2.7 ein Forschungs-Agent-System aufbauen, das mit verschiedenen Projektgruppen im Unternehmen zusammenarbeitet. Im Alltag des hauseigenen RL-Teams übernimmt der Agent laut MiniMax Aufgaben wie Literaturrecherche, Experiment-Tracking, Debugging, Metrikanalyse und Code-Korrekturen. Menschliche Forscher greifen demnach nur noch bei kritischen Entscheidungen ein. Das Modell bewältige 30 bis 50 Prozent des gesamten Workflows.

In einem Experiment optimierte M2.7 vollständig autonom über mehr als 100 Runden die Programmierleistung eines Modells in einer internen Entwicklungsumgebung. In jeder Runde analysierte es Fehlverläufe, plante Änderungen, passte den Code an, testete die Ergebnisse und entschied anschließend, ob die Änderungen beibehalten oder verworfen werden. Laut MiniMax führte das zu einer Leistungsverbesserung von 30 Prozent auf internen Evaluationssätzen.

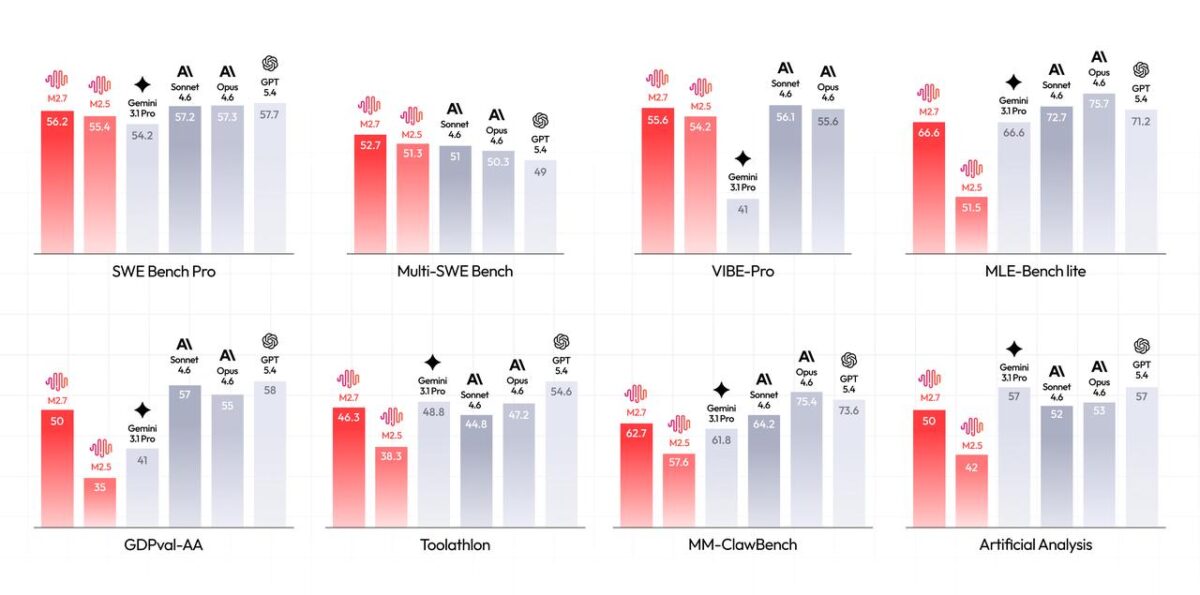

Bei 22 Machine-Learning-Wettbewerben des von OpenAI veröffentlichten MLE Bench Lite erreichte M2.7 über drei Durchläufe mit je 24 Stunden eine durchschnittliche Medaillenrate von 66,6 Prozent. Damit liegt das Modell nach Unternehmensangaben hinter Opus 4.6 (75,7 Prozent) und GPT-5.4 (71,2 Prozent), aber gleichauf mit Gemini 3.1.

Konkurrenzfähig bei Software Engineering und Büroarbeit

In Software-Engineering-Benchmarks zeigt M2.7 laut MiniMax Ergebnisse auf dem Niveau westlicher Spitzenmodelle. Auf SWE-Pro erreichte es 56,22 Prozent, vergleichbar mit GPT-5.3-Codex. Auf VIBE-Pro, einem Benchmark für vollständige Projektlieferung, erzielte es 55,6 Prozent. In Praxisszenarien soll M2.7 die Wiederherstellungszeit bei Produktionssystem-Ausfällen mehrfach auf unter drei Minuten reduziert haben.

Für professionelle Büroarbeit erreichte M2.7 im GDPval-AA-Benchmark einen ELO-Score von 1495, laut MiniMax der höchste Wert unter Open-Weight-Modellen. Das Modell soll mehrstufige Bearbeitungen in Word, Excel und PowerPoint mit hoher Wiedergabetreue bewältigen und bei über 40 komplexen Anweisungssets eine Regeltreue von 97 Prozent einhalten.

Als Praxisbeispiel beschreibt MiniMax eine Finanzanalyse für TSMC, bei der M2.7 eigenständig Geschäftsberichte las, ein Umsatzprognosemodell baute und daraus eine Präsentation und einen Research-Bericht erstellte. Das Ergebnis könne laut Finanzpraktikern bereits als erster Entwurf dienen.

Open-Source-Demo für interaktive KI-Erlebnisse

Neben Produktivitätsszenarien hat MiniMax auch die Charakter-Konsistenz und emotionale Intelligenz des Modells verbessert. Als Demonstration veröffentlichte das Unternehmen OpenRoom, ein Open-Source-Projekt, das KI-Interaktion in eine grafische Web-Umgebung verlagert, in der Charaktere proaktiv mit ihrer Umgebung interagieren. M2.7 ist über MiniMax Agent und die API-Plattform verfügbar, Gewichte sind im Gegensatz zu vorherigen Modellversionen bislang nicht verfügbar.

Das theoretische Fundament für sich selbst verbessernde KI legte Jürgen Schmidhuber bereits 2003 mit dem Konzept der "Gödel Machine", die Änderungen an ihrem eigenen Code nur bei formal bewiesenem Nutzen übernimmt. Projekte wie Sakana AIs "Darwin-Gödel-Maschine" und die aus Schmidhubers KAUST-Umfeld stammende "Huxley-Gödel Machine" nähern sich diesem Ideal pragmatisch an, indem KI-Agenten ihren eigenen Code iterativ verändern und erfolgreiche Varianten evolutionär selektieren.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.