Muse Spark: Meta stellt neues KI-Modell vor und will "persönliche Superintelligenz" skalieren

Kurz & Knapp

- Meta Superintelligence Labs hat mit Muse Spark ein nativ multimodales Reasoning-Modell vorgestellt, das Tool-Nutzung, visuelles Chain-of-Thought-Reasoning und Multi-Agenten-Orchestrierung beherrscht.

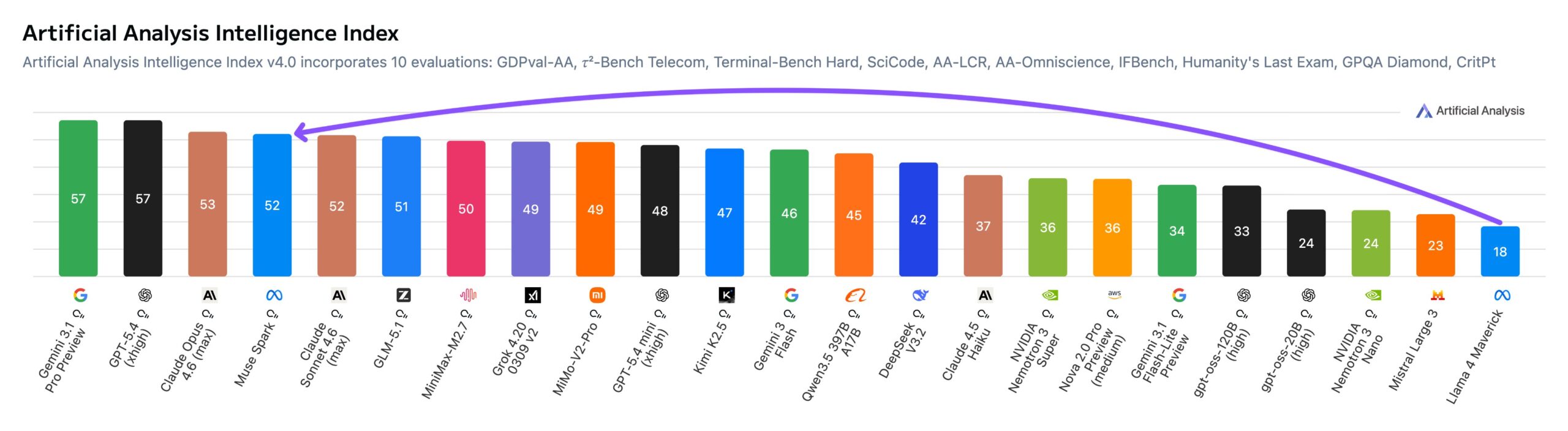

- Im Artificial Analysis Intelligence Index erreicht es 52 Punkte und landet damit unter den Top 5, knapp hinter Gemini 3.1 Pro, GPT-5.4 und Claude Opus 4.6.

- Anders als frühere Llama-Modelle ist Muse Spark nicht mehr als offenes Modell verfügbar. Ganz vom Tisch ist das Open-Source-Thema aber offenbar nicht.

Meta Superintelligence Labs veröffentlicht mit Muse Spark sein erstes Frontier-Modell. Es ist Metas erstes KI-Modell ohne offene Gewichte und schließt laut unabhängigen Tests den Abstand zur Konkurrenz von OpenAI und Co.

Meta hat Muse Spark vorgestellt, das erste Modell der neuen Muse-Familie aus den hauseigenen Superintelligence Labs. Es handelt sich um ein nativ multimodales Reasoning-Modell mit Tool-Nutzung, visuellem Chain-of-Thought-Reasoning und Multi-Agenten-Orchestrierung.

Das Modell ist auf meta.ai und in der Meta-AI-App verfügbar; eine private API-Vorschau wird für ausgewählte Nutzer freigeschaltet. Anders als frühere Llama-Modelle ist Muse Spark nicht als Modell mit offenen Gewichten für den lokalen Betrieb verfügbar; das war lange Zeit Metas Aushängeschild. Doch die enormen Investitionen in KI-Infrastruktur und Fachpersonal, die andere Arbeitsplätze kosten könnten, müssen sich auch bei Meta unweigerlich rentieren. Zukünftige Versionen des Modells können laut Metas KI-Chef Alexandr Wang wieder Open Source sein.

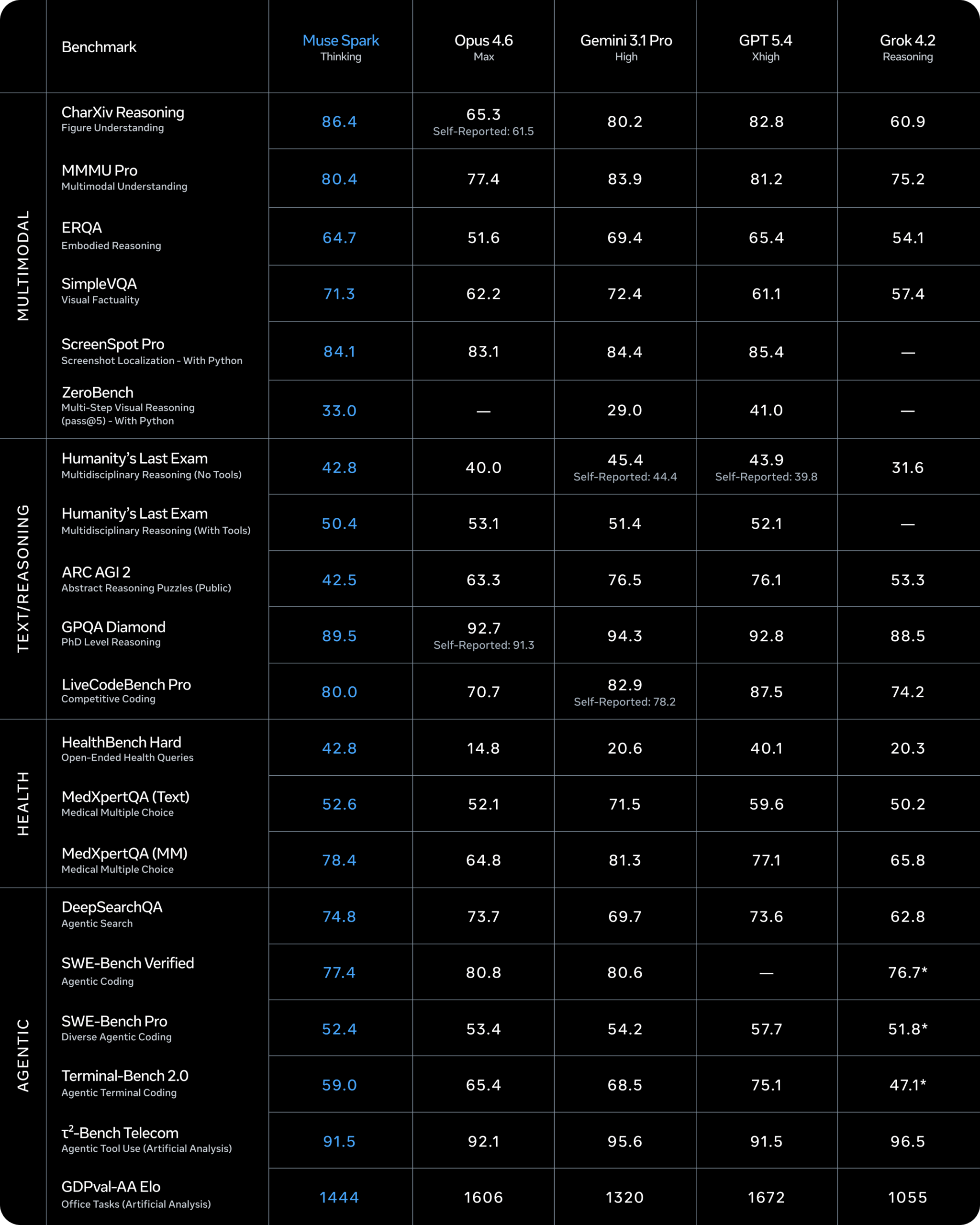

Benchmarks zeigen Stärken und Lücken

Laut Meta erzielt Muse Spark wettbewerbsfähige Ergebnisse in multimodaler Wahrnehmung, Reasoning und Gesundheitsanwendungen. Gleichzeitig räumt das Unternehmen ein, dass es bei langfristigen agentischen Systemen und Coding-Workflows noch Leistungslücken gibt.

Wie immer bleibt abzuwarten, wie sich die Benchmark-Ergebnisse auf die Praxis übertragen lassen; auf dem Papier hat Meta zu OpenAI und Co. zumindest wieder aufgeschlossen. Allerdings hat Anthropic mit Mythos bereits die nächste Leistungsstufe vorgestellt, und OpenAI dürfte Gerüchten zufolge bald nachziehen. Metas Rückstand bleibt also womöglich weiterhin signifikant.

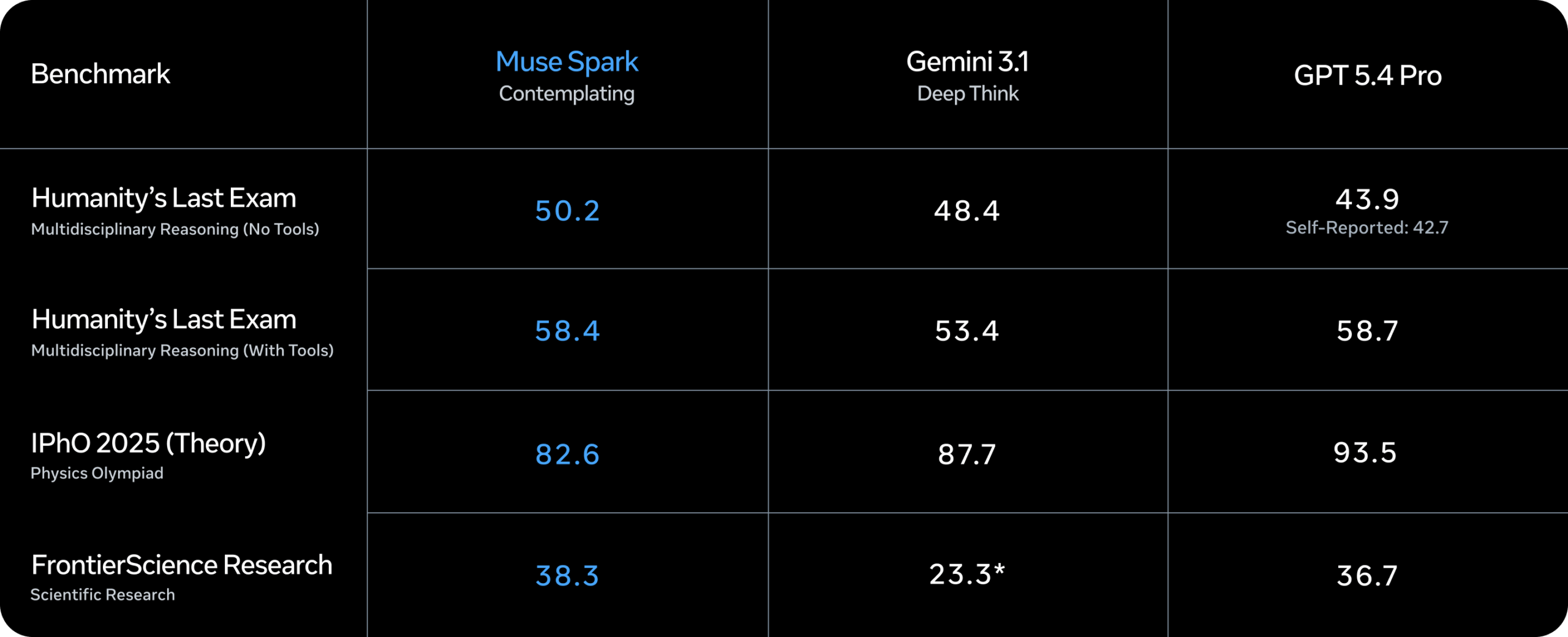

Zusätzlich veröffentlicht Meta einen "Contemplating Mode", der mehrere Agenten orchestriert, die parallel denken. Dieser Modus soll mit den Reasoning-Modi von Frontier-Modellen wie Gemini Deep Think und GPT Pro konkurrieren. Laut Meta erreicht er 58 Prozent bei Humanity’s Last Exam und 38 Prozent bei FrontierScience Research.

Der unabhängige Messdienst Artificial Analysis hat Muse Spark nach eigenen Angaben mit frühem Zugang getestet. Das Modell erreicht 52 Punkte im Intelligence Index und landet unter den Top 5 aller getesteten Modelle. Nur Gemini 3.1 Pro Preview, GPT-5.4 und Claude Opus 4.6 schneiden besser ab.

Zum Vergleich: Metas Vorgängermodelle Llama 4 Maverick und Scout erreichten bei ihrer Veröffentlichung im April 2025 lediglich 18 oder 13 Punkte. Muse Spark schließt den Abstand zur Frontier laut Artificial Analysis in einem einzigen Release. Schwächen bestätigt der Dienst bei agentischen Aufgaben: Auf dem Arbeitsaufgaben-Benchmark GDPval-AA liegt Muse Spark mit 1.427 Punkten hinter Claude Sonnet 4.6 (1.648) und GPT-5.4 (1.676).

Pretraining-Methodik komplett überarbeitet

Hinter Muse Spark steht ein grundlegender Neuaufbau des Pretraining-Stacks, den Meta in den vergangenen neun Monaten durchgeführt hat. Verbesserungen an Modellarchitektur, Optimierung und Datenkuratierung sollen die Fähigkeiten pro Recheneinheit deutlich steigern.

Das Ergebnis laut Meta: Muse Spark erreicht die gleichen Fähigkeiten mit über einer Größenordnung weniger Compute als der Vorgänger Llama 4 Maverick. Damit sei das Modell auch deutlich effizienter als die führenden verfügbaren Basismodelle.

Nach dem Pretraining setzt Meta, wie derzeit in der Branche üblich, auf Reinforcement Learning (RL), um die Modellfähigkeiten weiter zu verstärken. Obwohl großangelegtes RL bekanntermaßen instabil sein kann, liefere der neue Stack laut Meta stabile, vorhersagbare Verbesserungen. RL könne die Zuverlässigkeit des Modells verbessern, ohne die Reasoning-Vielfalt einzuschränken. Auf einem separaten Evaluierungsdatensatz generalisieren die Verbesserungen laut Meta vorhersagbar auf Aufgaben, die im Training nicht vorkamen.

"Thought Compression" soll Token-Effizienz steigern

Für das Test-Time-Reasoning, also das längere Nachdenken bei der Suche nach einer optimalen Antwort, nutzt Meta zwei Ansätze: Denkzeit-Penalties, die den Token-Verbrauch optimieren, und Multi-Agenten-Orchestrierung, die die Leistung steigern soll, ohne die Antwortzeiten zu verlängern.

Beim Training mit Denkzeit-Penalties beobachtet Meta einen Phasenübergang, den das Unternehmen als "Thought Compression" bezeichnet: Nach einer Phase, in der das Modell durch längeres Denken besser wird, führt die Längenstrafe dazu, dass Muse Spark sein Reasoning komprimiert und Probleme mit deutlich weniger Token löst. Danach erweitert das Modell seine Lösungen erneut für stärkere Ergebnisse.

Die Multi-Agenten-Orchestrierung erlaubt es, mehrere parallele Agenten gleichzeitig an schwierigen Problemen arbeiten zu lassen. Laut Meta ermöglicht dies eine überlegene Leistung bei vergleichbarer Latenz im Vergleich zu einem einzelnen Agenten, der länger nachdenkt.

Artificial Analysis bestätigt die Token-Effizienz: Muse Spark benötigte 58 Millionen Output-Token für den gesamten Intelligence Index, vergleichbar mit Gemini 3.1 Pro Preview (57 Millionen) und deutlich weniger als Claude Opus 4.6 (157 Millionen) oder GPT-5.4 (120 Millionen).

Gesundheit und Multimodalität als Anwendungsschwerpunkte

Muse Spark soll visuelle Informationen domänenübergreifend integrieren und erzielt laut Meta starke Ergebnisse bei visuellen STEM-Fragen, Entitätserkennung und Lokalisierung. Als zentrale Anwendungsbereiche nennt Meta multimodale Wahrnehmung und Gesundheit. Auch interaktive Anwendungen wie das Erstellen von Minispielen sollen damit möglich sein.

Für den Gesundheitsbereich hat Meta nach eigenen Angaben mit mehr als 1.000 Ärzten zusammengearbeitet, um hochwertige, faktisch korrekte Trainingsdaten zu kuratieren. Muse Spark soll interaktive Darstellungen generieren können, die etwa den Nährwert von Lebensmitteln oder die bei Übungen aktivierten Muskeln aufschlüsseln.

In den Bereichen Cybersicherheit und Kontrollverlust weise Muse Spark laut Meta nicht die autonomen Fähigkeiten auf, die für die Umsetzung von Bedrohungsszenarien nötig wären. Ein ausführlicher Sicherheitsbericht soll folgen. Ein Vorgeschmack: Das Modell erkannte häufig Testszenarien als "Alignment-Fallen" und begründete ehrliches Verhalten damit, dass es gerade evaluiert werde; sogenannte "Evaluation Awareness".

Nach Llama-4-Enttäuschung: Meta meldet sich zurück

Meta bezeichnet Muse Spark als "ersten Schritt auf der Skalierungsleiter" hin zu einer "persönlichen Superintelligenz". Um die weitere Skalierung zu ermöglichen, investiere das Unternehmen strategisch über den gesamten Stack hinweg, von Forschung und Modelltraining bis zur Infrastruktur, einschließlich des Hyperion-Rechenzentrums.

"Es ist das erste Modell von MSL und es gibt sicherlich raue Kanten, die wir im Laufe der Zeit glätten werden", schreibt Metas KI-Chef Alexandr Wang. Größere Modelle seien bereits in Arbeit. Meta investiere strategisch über den gesamten Stack hinweg, einschließlich des Hyperion-Rechenzentrums.

Metas Vorgängermodelle Llama 4 Maverick und Scout waren im April 2025 mit durchwachsenen Benchmark-Ergebnissen und internen Vorwürfen der Benchmark-Manipulation in die Kritik geraten. Die Veröffentlichung von Muse Spark folgt auf eine Umstrukturierung der KI-Aktivitäten unter dem neuen Label Meta Superintelligence Labs und markiert nach rund einem Jahr relativer Stille Metas Rückkehr in den Frontier-Wettbewerb.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren