Neue Studie zeigt Akzeptanz von KI in den Nachrichten - aber mit Grenzen

Eine neue Studie zeigt, dass Nachrichtenkonsumenten dem Einsatz künstlicher Intelligenz im Journalismus zunehmend aufgeschlossen gegenüberstehen - allerdings mit klaren Grenzen und unter bestimmten Bedingungen.

Laut einer aktuellen Studie des Marktforschungsinstituts CRAFT in Kooperation mit dem Reuters Institute for the Study of Journalism haben Nachrichtenkonsumenten ein zunehmend differenziertes Bild vom Einsatz künstlicher Intelligenz (KI) im Journalismus.

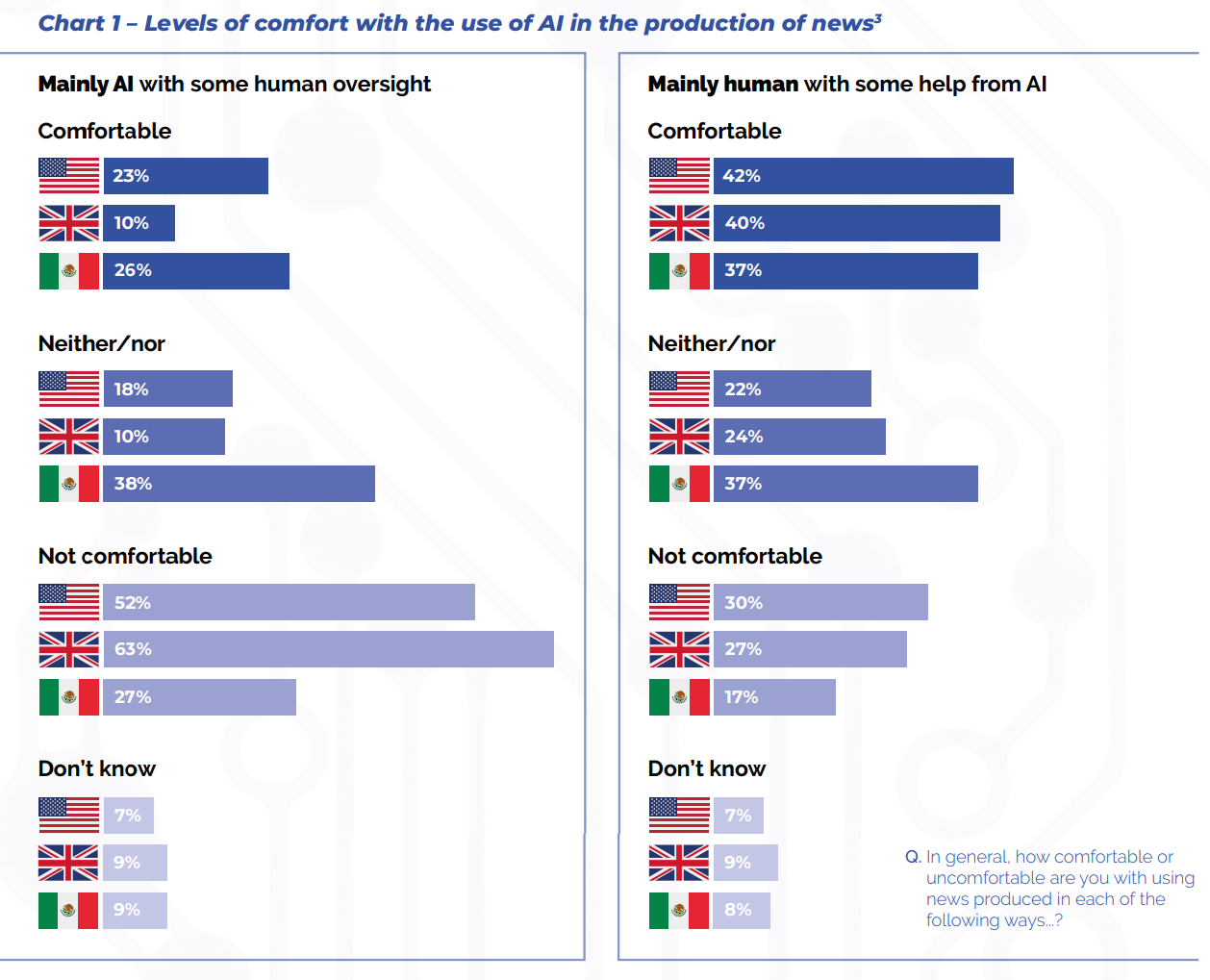

Die Untersuchung, durchgeführt in Mexiko, Großbritannien und den USA, zeigt, dass die Akzeptanz je nach Anwendungsbereich stark variiert.

"Das Publikum ist am ehesten damit einverstanden, dass generative KI hinter den Kulissen eingesetzt wird, um journalistische Praktiken zu unterstützen, die für das Publikum nicht sichtbar sind, aber die Nachrichtenproduktion fördern", sagt Studienleiter Konrad Collao.

Auch bei der Aufbereitung von Nachrichten in neuen Formaten, zum Beispiel durch Zusammenfassungen oder Personalisierung, sehen viele Vorteile.

Ohne Emotion kein guter Journalismus

Deutlich kritischer wird der Einsatz von KI bei der vollautomatischen Erstellung von Inhalten gesehen: "Nachrichtenkonsumenten fühlen sich am wenigsten wohl, wenn KI zur Erzeugung synthetischer Inhalte eingesetzt wird", so Collao.

Hier befürchten die Teilnehmer der Umfrage einen Verlust journalistischer Qualität, menschlicher Perspektiven und Emotion. Eine Ausnahme bilden reine Sachinformationen wie Sportergebnisse oder Börsenkurse.

Einig sind sich die Befragten darin, dass der Einsatz von KI transparent gemacht werden sollte - allerdings nicht in jedem Fall. Bei Hintergrundaufgaben halten viele eine Offenlegung für unnötig, bei der Inhaltsproduktion hingegen für unerlässlich.

Eine Abwägung zwischen verschiedenen Themenbereichen in Bezug auf den Einsatz von KI wird abgelehnt: "Obwohl einige Themen als mehr oder weniger wichtig angesehen werden, akzeptieren die Nachrichtenkonsumenten nicht, dass Nachrichten über verschiedene Themen mehr oder weniger wahrheitsgetreu oder genau sein sollten. Die gleichen guten journalistischen Prinzipien sollten für alle Themen gelten", sagt Collao.

"Prüfen, prüfen und nochmals prüfen"

Für Nachrichtenorganisationen ergeben sich aus der Studie klare Handlungsempfehlungen: Sie sollten KI primär im Hintergrund und für neue Darstellungsformen nutzen, bei der Erstellung von Inhalten aber vorsichtig sein. Außerdem sollten sie transparent über ihren KI-Einsatz informieren, ohne ihn zu übertreiben.

Auf der Grundlage der Ergebnisse empfiehlt die Studie fünf Grundsätze für den Einsatz von KI in der Nachrichtenproduktion:

- Menschliche Überprüfung: Alle Inhalte sollten unabhängig vom KI-Einsatz von einem Menschen überprüft werden. Dies wird als grundlegende gute Arbeitspraxis angesehen.

- Akzeptable KI-Nutzung: KI wird am ehesten für die Unterstützung von Journalisten bei einfachen Aufgaben und bei der Neuformulierung von Inhalten akzeptiert. Am wenigsten akzeptabel ist KI für die synthetische Erstellung von Inhalten.

- Ausnahme für objektive Fakten: KI-Einsatz ist akzeptabel zur Generierung von Inhalten mit objektiv überprüfbaren Fakten, wenn dies offengelegt wird. Ein Beispiel ist die automatisierte Berichterstattung der BBC über Wahlergebnisse.

- Akzeptanz bei illustrativen Bildern: KI ist akzeptabel, um unterstützende, stilisierte Bilder zu erzeugen, aber nicht für realistische Darstellungen, insbesondere wenn es um wichtige Themen wie Krieg oder Politik geht.

- Ausnahmen bei weniger wichtigen Themen: Bei weniger folgenreichen Themen, wo kein Realismus erforderlich ist und keine Menschen dargestellt werden, gelten die Regeln für realistische Darstellungen weniger streng.

Collao rät Nachrichtenorganisationen: "Prüfen, prüfen und nochmals prüfen - ein Grundprinzip guter Arbeit und journalistischer Praxis, das durch das Aufkommen der generativen KI in ein schärferes Licht gerückt wird. Am Ende ist das Publikum der Meinung, dass fast alles, was veröffentlicht wird, von einem Menschen überprüft werden sollte."

Die Autoren der Studie beschreiben einen kritischen Wendepunkt, der eng mit KI verbunden ist. In einem Szenario könnten die Menschen das Vertrauen in alle Informationen verlieren, in einem anderen könnte das Vertrauen in Nachrichtenmarken steigen oder erhalten bleiben, wenn ihr Status als verantwortliche Akteure gestärkt werde.

Dieses Vertrauen müsse "verdient, zurückgewonnen und aufrechterhalten werden" - und der eigene Umgang mit generativer KI habe einen starken Einfluss darauf.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.