Neues Omnimodell: OpenAI-Mitarbeiter deuten auf nächste KI-Generation hin

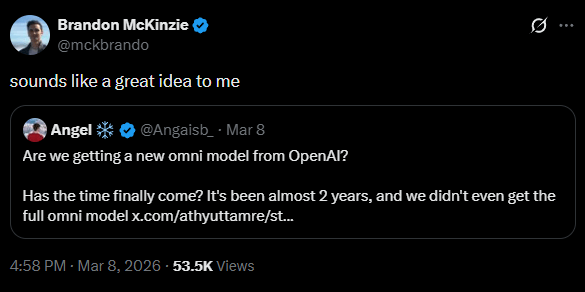

OpenAI scheint an einem neuen multimodalen Modell zu arbeiten, potenziell ein Nachfolger von GPT-4o. Darauf weisen Posts von OpenAI-Mitarbeitern hin. Atty Eleti aus dem Voice-Team schrieb, er sei "gespannt auf das, was als Nächstes kommt" und fragte Nutzer, was sie sich von einem neuen Omnimodell wünschen. Brandon McKinzie, Forscher bei OpenAI mit Multimodal-Hintergrund bei Apple, kommentierte ein potenzielles Omni-Model mit "klingt nach einer großartigen Idee".

Multimodal bedeutet, dass ein Modell verschiedene Formate wie Text, Bild, Audio und Video in einem einzigen Modell verarbeitet, statt für jede Aufgabe ein eigenes zu benötigen. GPT-4o ("omni") kombinierte zum ersten Mal Text-, Bild- und Audioverarbeitung bei OpenAI. Das letzte Modell von OpenAI, GPT-5.4, integrierte bereits "Computer Use" nativ, also die Fähigkeit, für Menschen gemachte Computer-Interfaces zu bedienen.

Parallel arbeitet OpenAI laut The Information an einem neuen Audio-Modell namens "BiDi" (bidirektional), das Gespräche natürlicher machen soll. Heutige Sprachmodelle arbeiten rundenbasiert: Die KI wartet, bis der Nutzer fertig gesprochen hat. BiDi soll Unterbrechungen in Echtzeit verarbeiten. Ein Prototyp existiert, neigt aber nach wenigen Minuten zu Fehlern. Der Start könnte sich auf das zweite Quartal oder später verschieben.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren