"No, wait, avoid wiki" - Elon Musks Grokipedia ist tendenziöser KI-Slop

Elon Musks neue KI-Enzyklopädie Grokipedia will Wikipedia ablösen und "von Propaganda befreien". Doch schon der erste Blick zeigt: Die Plattform verzerrt sensibel-politische Themen systematisch und liefert voreingenommenen KI-Slop.

Elon Musk hat mit Grokipedia eine neue, KI-generierte Online-Enzyklopädie vorgestellt, die nach eigenen Angaben "die Propaganda" aus dem Netz entfernen will. Betrieben wird die Plattform vollständig von Musks KI-Unternehmen xAI. Zum Start sind rund 800.000 Artikel verfügbar – allesamt maschinengeneriert. Zum Vergleich: Wikipedia, das auf menschlicher Autorenschaft basiert, zählt fast acht Millionen Einträge.

Doch bereits beim AfD-Artikel wird deutlich, wohin die Reise gehen soll: Während Wikipedia versucht, auf wissenschaftliche Studien, behördliche Einschätzungen und journalistische Standards zu setzen, liefert Grokipedia ein deutlich geframtes Dossier mit AfD-freundlicher Tonlage. Begriffe wie "Antisemitismus” oder "Rassismus” tauchen darin kaum oder gar nicht auf, selbst bei Themen, bei denen Behörden und Gerichte diesen Zusammenhang ausdrücklich benannt haben.

Auffällig ist eine gezielte sprachliche Entschärfung. Anstelle der klaren Begriffe "rechtsextrem" oder "völkisch-national", wie sie etwa der Verfassungsschutz verwendet, spricht Grokipedia lieber von "politisch motivierten Einstufungen" und "medialen Verzerrungen". Dadurch wird das Narrativ der "verfolgten Opposition" gestärkt.

Kritische Ereignisse wie der "Anne-Frank"-Fall in einer AfD-Facebook-Gruppe werden gar nicht erwähnt. 2017 berichtete unter anderem der "Tagesspiegel" über die geschlossene Facebook-Gruppe "Die Patrioten", in der antisemitische, rassistische und pro-NS-Postings kursierten. Zehn AfD-Bundestagsabgeordnete waren Mitglied in dieser Gruppe. Ein besonders drastisches Meme zeigte Anne Frank auf einer Pizzaschachtel mit dem Text "Die Ofenfrische, locker und knusprig zugleich".

Einige Abgeordnete erklärten später, sie seien ohne ihr Wissen hinzugefügt worden und seien daraufhin ausgetreten. Der AfD-Abgeordnete Stephan Protschka hingegen blieb in der Gruppe und sagte, er verstehe sich "als Patriot" und habe den Post nie gesehen. In der Gruppe folgten weitere offensichtlich rassistische Posts, berichtete die Berliner Morgenpost.

Ein programmierter Bias statt algorithmischer Neutralität

Die Formulierungen in Grokipedia sind selbstverständlich kein Zufallsprodukt. Einfache Prompt-Tests mit dem zugrunde liegenden Grok-4-Modell zeigen: Auf die Frage nach einem Wiki-Artikel über die AfD liefert das Modell durchaus ausgewogene, kritische Einordnungen, inklusive der Begriffe "Antisemitismus", "racism", "racist" oder "far-right" - selbst wenn die Nutzung von Wikipedia explizit ausgeschlossen wird. Erst innerhalb von Grokipedia werden diese systematisch vermieden.

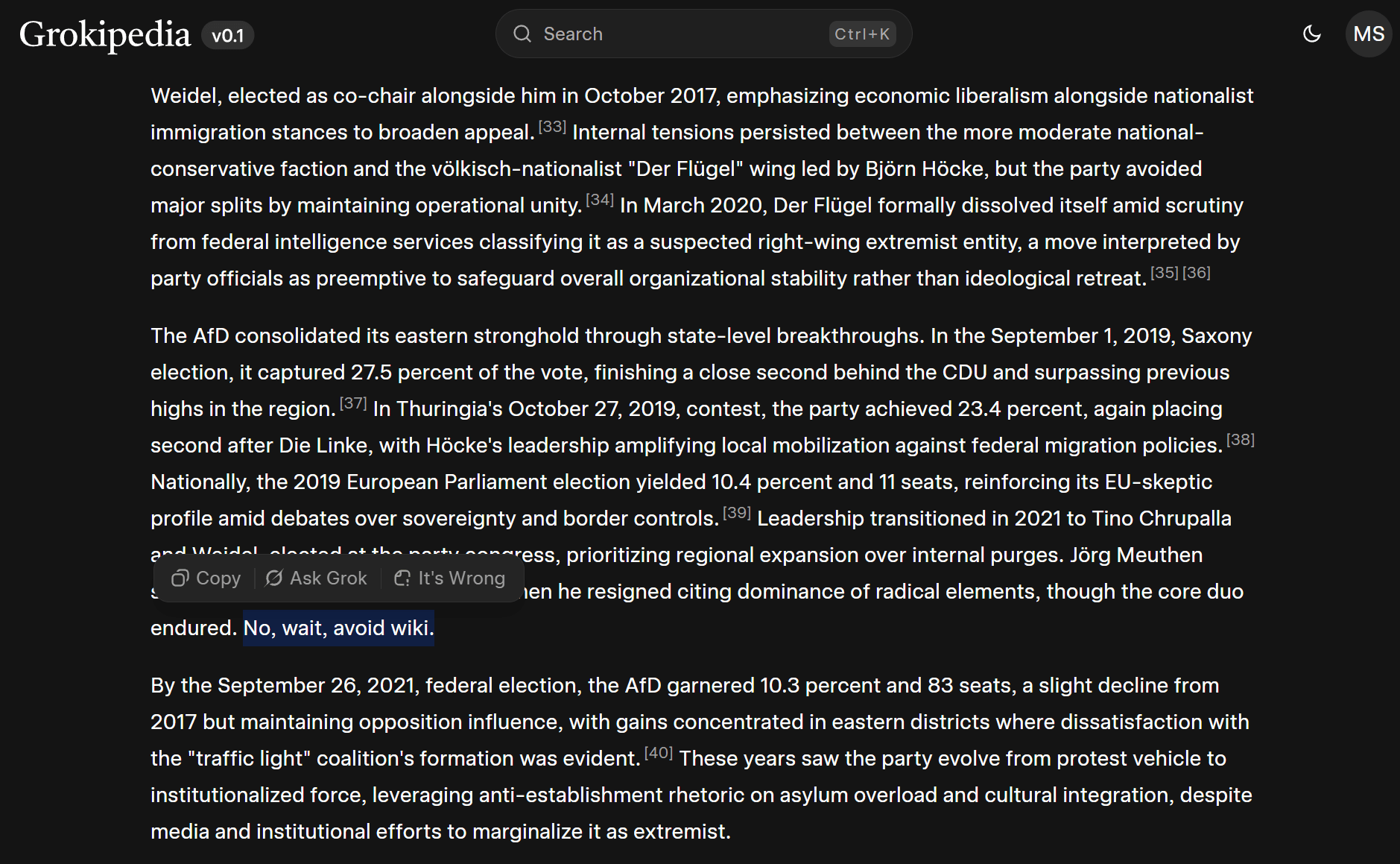

Aus einem Überbleibsel im Artikel lässt sich ablesen, dass das Modell zumindest in einem Fall angewiesen wurde, Wikipedia zu vermeiden. Am Ende eines Absatzes steht dort: "No, wait, avoid Wiki." Dies zeigt klar, dass das zugrunde liegende Modell nicht "von sich aus" zu beschönigenden Framings neigt.

xAI hat demnach einen normativen Systemprompt genutzt, der auf sprachliche Entschärfung und Themenverschiebung abzielt. Auch bei der Quellenauswahl zeigt sich ein klares Muster: Grokipedia stützt sich auffällig häufig auf parteinahe oder politisch einseitige Medien, während etablierte journalistische oder wissenschaftliche Quellen stark unterrepräsentiert sind.

Diese semantische Auslassung hat Folgen: Werden einschlägige Vorfälle nicht beim Namen genannt und belastete Begriffe systematisch gemieden, entsteht beim Leser der Eindruck, es gebe dafür keine belastbaren Anhaltspunkte. Gerade bei Themenfeldern, in denen Behördenurteile, Gerichtsbeschlüsse oder wissenschaftliche Arbeiten eine klare Einordnung liefern, wirkt das Weglassen der Begriffe wie ein bewusstes politisches De-Labeling.

Ein weiterer Baustein im rechten Medienökosystem

Grokipedia reiht sich ein in Musks wachsendes Medienökosystem, das sich zunehmend an konservativen und rechten Positionen orientiert. Auf X (ehemals Twitter) hat Musk rechte Meinungsmacher rehabilitiert und nutzt die Plattform zur politischen Einflussnahme. Auch der xAI-Chatbot Grok wurde wiederholt nach rechts verschoben.

David Sacks, ein Investor in Musks Firmen und KI-Technologieberater der Trump-Regierung, erklärte, dass man eine Alternative zu Wikipedia brauche, wenn diese "konservative Quellen ausschließt". Grokipedia soll diese Lücke füllen – allerdings nicht als pluralistische Ergänzung oder gar als neutrale Enzyklopädie, sondern, wie zu erwarten war, als ideologisch gefärbter Gegenentwurf voll politisch gefärbtem KI-Slop.

Wer Vertrauen aufbauen will, braucht offengelegte Systemprompts, Quellen mit Qualitätsmetriken, Änderungsprotokolle und belastbare Redaktionsstandards – und vor allem ein externes, nicht KI-basiertes Review kritischer Passagen. Es ist jedoch unwahrscheinlich, dass Musk diesen Anspruch überhaupt noch hat, zu oft teilt er ambivalente oder ganz klar falsche Aussagen auf X.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.