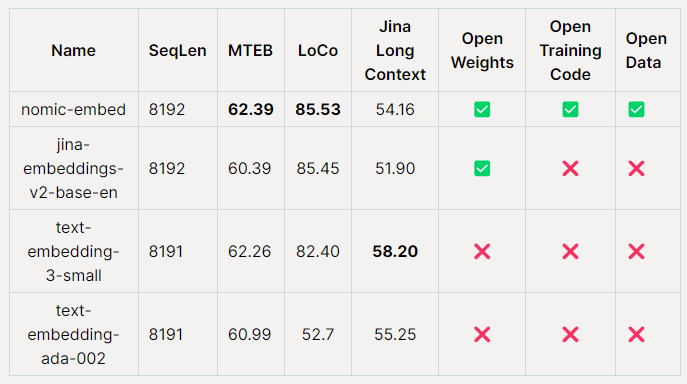

Nomic AI hat ein Open-Source-Embedding-Modell namens Nomic Embed veröffentlicht, das die OpenAI-Modelle Ada-002 und text-embedding-3-small sowohl bei kurzen als auch bei langen Kontextaufgaben übertrifft. Das Modell ist vollständig reproduzierbar, auditierbar und unterstützt eine Kontextlänge von 8192. Nomic Embed übertraf seine Konkurrenten im Massive Text Embedding Benchmark (MTEB) und im LoCo Benchmark, blieb aber im Jina Long Context Benchmark zurück. Die Gewichte des Modells und die vollständigen Trainingsdaten werden veröffentlicht, um eine vollständige Überprüfbarkeit zu gewährleisten. Nomic Embed ist über die Nomic Atlas Embedding API mit einer Million kostenlosen Token für Produktions-Workloads und über das Nomic Atlas Enterprise Angebot für Unternehmen verfügbar.