OpenAI erklärt die Bildregeln des neuen GPT-4o in ChatGPT

Mit der Bildgenerierung von GPT-4o in ChatGPT öffnet OpenAI neue kreative Spielräume – und stellt zugleich neue Regeln auf. Die Entscheidungskriterien dahinter erklärt eine interne Führungskraft nun öffentlich.

Die neue Policy spiegelt einen Paradigmenwechsel wider: Statt sich als Schiedsrichter über erlaubte und verbotene Kreativität zu positionieren, möchte OpenAI den Nutzern mehr Freiheiten einräumen. In einem Beitrag auf Substack beschreibt Joanne Jang, zuständig für das Modellverhalten bei OpenAI, die Überlegungen hinter den Richtlinien zum Start des neuen Features.

Weniger Verbote, mehr Verantwortung

Die Perspektive innerhalb des Unternehmens habe sich gewandelt, so Jang. Nutzerinnen und Nutzer sollen mehr Vertrauen erhalten, anstatt dass Entwickler über erlaubte Inhalte entscheiden. Frühere Erfahrungen hätten gezeigt, dass viele kreative Anwendungen erst nach dem Launch sichtbar werden. Überdies betont Jang den Wert alltäglicher, scheinbar banaler Nutzung – etwa zur Unterhaltung – und warnt davor, diese gegen hypothetische Negativszenarien aufzuwiegen.

Bei öffentlichen Personen setzt OpenAI auf Selbstbestimmung: Jeder, der vom Modell dargestellt werden kann, erhält die Möglichkeit zum Opt-out. Bei potenziell "anstößigen" Inhalten unterscheidet das Unternehmen zwischen persönlichen Vorlieben und echtem Schadenspotenzial.

In der Vergangenheit habe das Modell Anfragen wie „Mach die Person schwerer“ oder „asiatischer aussehend“ abgelehnt – mit der unbeabsichtigten Botschaft, dass solche Merkmale anstößig seien. Solchen impliziten Werturteilen soll nun entgegengewirkt werden.

Hassymbole wie Hakenkreuze werden nicht pauschal verboten, da sie in bildungsbezogenen oder kulturellen Kontexten legitim sein können. Stattdessen arbeitet OpenAI an technischen Methoden zur Erkennung missbräuchlicher Verwendung.

Kinder und Jugendliche unter 18 Jahren sollen durch besonders strenge Schutzmaßnahmen abgesichert werden. Dies gelte sowohl in Forschungskontexten als auch bei der Produktnutzung. OpenAI möchte seine Richtlinien auf Basis von Nutzungserfahrungen weiterentwickeln. Feedback sei ausdrücklich erwünscht.

Wandel im Wettbewerb und politisches Klima

Jang betont, dass die neuen Richtlinien nicht als Absenkung der Sicherheitsstandards missverstanden werden sollten. Vielmehr sei es ein Versuch, Nutzerfreiheit verantwortungsvoll zu erweitern – auf Basis interner Diskussionen und umfangreicher Forschung.

Zur Wahrheit gehört aber auch, dass die Entscheidung für lockerere Richtlinien in eine Phase fällt, in der sich die Branche sichtbar in Richtung permissiverer Modelle bewegt. Der Konkurrent xAI etwa setzt bei der Bildgenerierung in Grok 3 mit dem Aurora-Modell auf fast keine Einschränkungen. Dort gibt es bislang auch keine öffentlich dokumentierten Schutzmechanismen gegen Missbrauch oder problematische Inhalte.

OpenAI befand sich in der Vergangenheit eher auf der vorsichtigen Seite und blockierte viele Inhalte pauschal – auch auf die Gefahr hin, nützliche oder harmlose Anwendungen zu verhindern. Die nun eingeschlagene Richtung könnte auch als Reaktion auf diesen wachsenden Konkurrenzdruck gewertet werden.

Hinzu kommt ein verändertes politisches Klima, insbesondere in den USA. Unter dem Deckmantel der Meinungsfreiheit werden dort zunehmend problematische Inhalte wie Hate Speech, Desinformation und extremistische Symbole toleriert. Unternehmen sehen sich daher in einem Spannungsfeld zwischen ethischer Verantwortung und wirtschaftlichem sowie politischem Handlungsdruck.

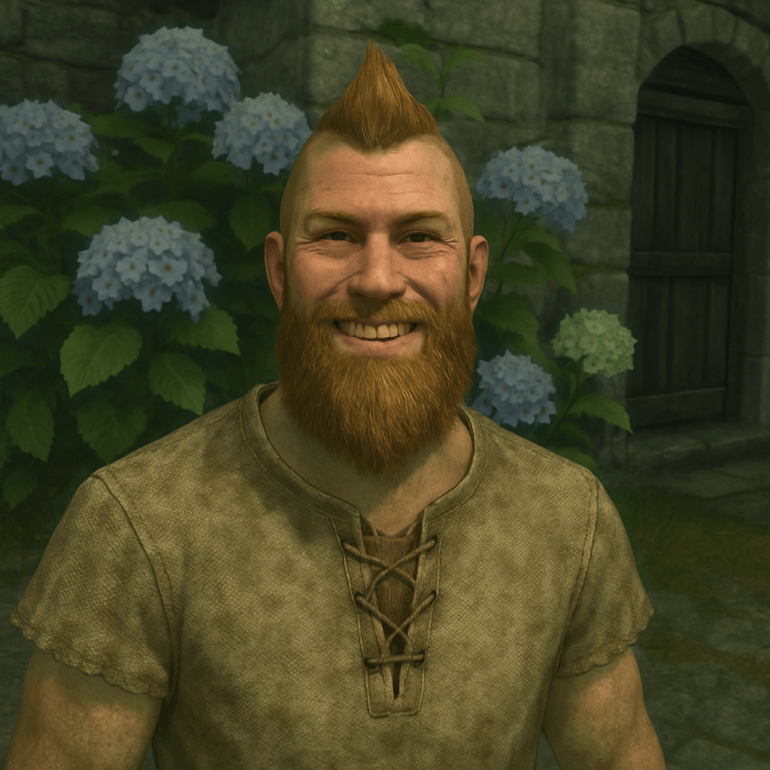

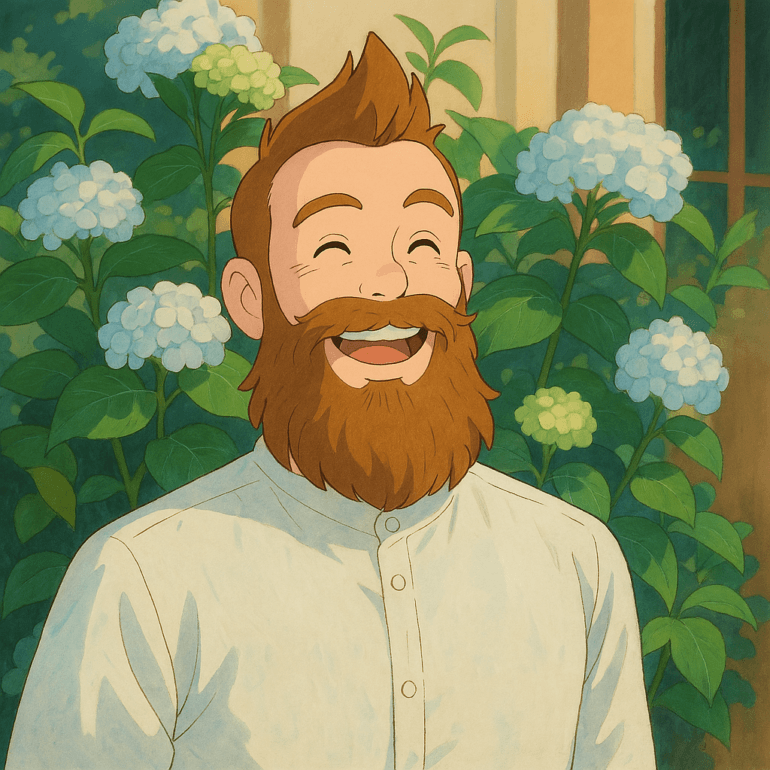

OpenAI steht derzeit in der Kritik, da die neue Bildgenerierung in ChatGPT existierende Stile hervorragend adaptieren kann. Seit dem Launch generierten ChatGPT-Nutzer zahlreiche Bilder im Stil des bekannten Animationsstudios Studio Ghibli – darunter ein viraler Herr-der-Ringe-Trailer. Jang äußert sich in ihrem Beitrag nicht zu urheberrechtlichen Aspekten. OpenAI erklärt, dass Künstlernamen weiterhin in Prompts gesperrt seien, Studio-Stile hingegen erlaubt blieben, um kreative Fan-Arbeiten zu ermöglichen.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.