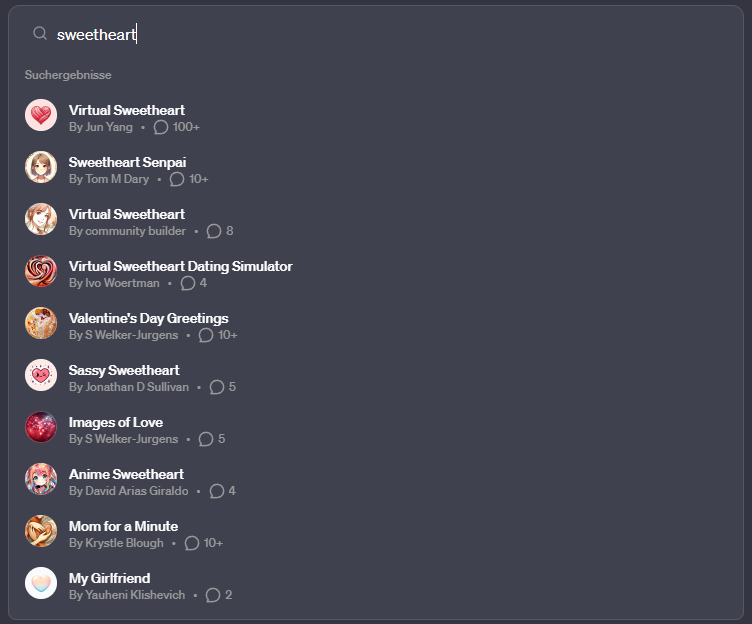

Der GPT-Store von OpenAI, der angepasste Versionen von ChatGPT anbietet, hat bereits Probleme mit Nutzern, die gegen die Regeln verstoßen, indem sie KI-Chatbots mit "virtuellen Freundinnen" erstellen. Diese Bots wie "Korean Girlfriend", "Virtual Sweetheart" und "Your AI Girlfriend, Tsu✨" verstoßen gegen die Nutzungsrichtlinien von OpenAI, die GPTs verbieten, die "romantische Freundschaften oder die Durchführung regulierter Aktivitäten fördern". OpenAI verwendet eine Kombination aus automatisierten Systemen, menschlicher Überprüfung und Nutzerberichten, um GPTs zu finden und zu bewerten, die möglicherweise gegen die Richtlinien verstoßen. Virtuelle Begleiter sind nicht neu, siehe character.ai, und an sich nichts Schlechtes. Aber wie Quartz bemerkt, hat es nur zwei Tage gedauert, bis die Benutzer diese Regeln gebrochen haben. Ich frage mich, was das für das Versprechen von OpenAI bedeutet, den Missbrauch von GPTs für Wahlpropaganda zu verhindern.

Anzeige

Unterstütze unsere unabhängige, frei zugängliche Berichterstattung. Jeder Betrag hilft und sichert unsere Zukunft. Jetzt unterstützen:

News, Tests und Berichte über VR, AR und MIXED Reality.

Wie es mit MIXED weitergeht

Mein persönlicher Abschied von MIXED

Meta und Anduril entwickeln jetzt gemeinsam VR-Brillen fürs US-Militär

MIXED.de

Community beitreten

Kommt in die DECODER-Community bei Discord,Reddit, Twitter und Co. - wir freuen uns auf euch!