Das neue Text-zu-Video-Modell von OpenAI, Sora, wird wohl noch einige Zeit in der Entwicklung sein.

Laut Bloomberg hat OpenAI noch keinen genauen Zeitplan für die Veröffentlichung festgelegt. Dafür gibt es zwei Gründe: Zum einen will OpenAI angesichts der zahlreichen Wahlen in diesem Jahr keine Sicherheitsrisiken eingehen. Der andere Grund ist schlicht, dass das Modell technisch bis jetzt nicht reif für eine Veröffentlichung ist.

Schon bei der Vorstellung von Sora hatte OpenAI auf Mängel beim physikalischen Verständnis des Modells und bei der Konsistenz hingewiesen.

Auch bei Tests von Bloomberg, die von OpenAI zwei Prompts generieren lassen konnten, traten visuelle Fehler auf. Im folgenden Video etwa verwandelt sich der Papagei am Ende in einen Affen.

Prompt: "An overhead view of a parrot flying through a verdant Costa Rica jungle, then landing on a tree branch to eat a piece of fruit with a group of monkeys. Golden hour, 35mm film." | Video: Rachel Metz via X

"Sora ist immer noch ein Forschungsprojekt, zu dem nur sehr wenige Leute Zugang haben, und bei unserer privaten Demonstration mit OpenAI gab es klare Grenzen für das Tool", schreibt Bloomberg.

Auffällig ist auch, dass Bloomberg OpenAI vier Prompts gab, OpenAI aber nur zwei Videos generierte. Als Grund nannte das Unternehmen zeitliche Beschränkungen der Forscher. Das deutet darauf hin, dass der Generierungsprozess noch recht langwierig oder nicht ausgereift ist.

Snack-Pause während Videogenerierung

Was die Generierungszeit betrifft, lässt sich OpenAI noch nicht in die Karten schauen. Sora benötigt aber definitiv mehr Zeit als gängige Bildgeneratoren. Derzeit könne man sich bequem einen Snack holen, während man auf das fertige Video wartet, sagt OpenAI-Forscher Bill Peebles.

Er räumt auch die Generierungsfehler von Sora ein, spricht aber dennoch von einem "deutlichen Sprung" in der KI-Videogenerierung, insbesondere in Bezug auf die Komplexität der Szenen.

Sora befindet sich derzeit in der Red-Teaming-Phase und ausgewählte Künstler, Filmemacher und Designer haben Zugang zum System erhalten. Das gab OpenAI bei der Vorstellung des Modells bekannt.

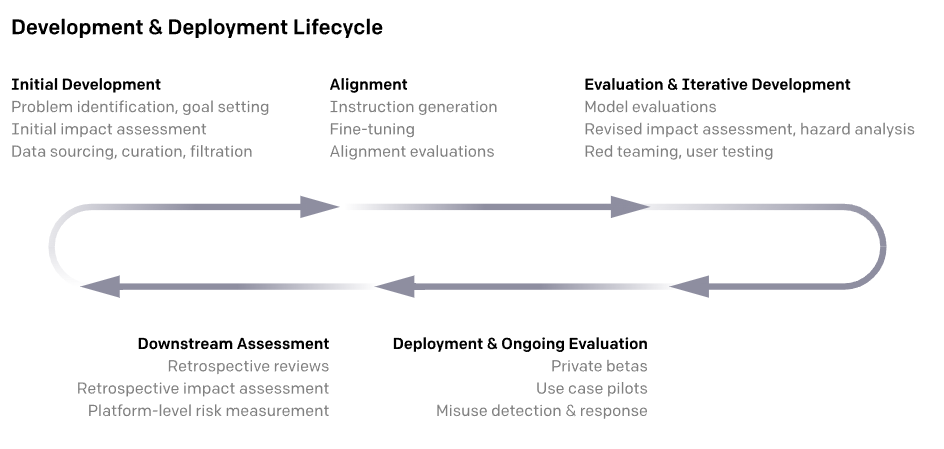

Betrachtet man den OpenAIs Modell-Rollout-Plan, scheint es sich um die Phase "Evaluation & Iterative Development" zu handeln. Der nächste Schritt wäre dann eine gestaffelte Rollout-Phase mit privaten Betas, Use-Case-Piloten und weiteren Sicherheitstests.

Aufmerksam auf das Projekt wurde auch der amerikanische Filmemacher Tyler Perry, der nach eigenen Angaben einen 800 Millionen Dollar teuren Ausbau seines Studios stoppte, nachdem er die Sora-Demos gesehen hatte. Perry geht davon aus, dass er in Zukunft viele Filmszenen einfach aus Text generieren kann.