Forschende zeigen, wie Stable Diffusion Gedanken lesen kann. Die Methode rekonstruiert mit verblüffender Genauigkeit Bilder aus MRT-Aufnahmen.

Forschende setzen bereits seit Jahren KI-Modelle ein, um Informationen aus dem menschlichen Gehirn zu dekodieren. Im Kern werden dabei vorher aufgezeichnete MRT-Aufnahmen als Input für ein generatives KI-Modell für Text oder Bild genutzt.

Anfang 2018 zeigte etwa eine Gruppe Forschende aus Japan, wie ein neuronales Netz Bilder aus MRT-Aufnahmen rekonstruierte. 2019 rekonstruierte eine Gruppe Bilder aus den Neuronen von Affen und Metas Forschungsgruppe um Jean-Remi King veröffentlicht seit Jahren neue Arbeiten, die etwa Sprache aus MRT-Daten ableiten.

Im Oktober 2022 zeigte ein Team der University of Texas, Austin, dass GPT-Modelle neben Sprache auch Text aus MRT-Daten ableiten können. Der Text beschreibt Inhalte, die eine Person in einem Video gesehen hat.

Im November 2022 zeigten Forschende der National University of Singapore, der Chinese University of Hongkong und der Stanford University mit MinD-Vis, wie sich mit Diffusionsmodellen, die aktuelle generative KI-Modelle wie Stable Diffusion, DALL-E oder Midjourney antreiben, Bilder aus MRT-Aufnahmen rekonstruieren lassen - mit einer deutlich höheren Genauigkeit damals verfügbare Ansätze.

Stable Diffusion kann ohne neues Training Gehirn-Bilder rekonstruieren

Forschende der Graduate School of Frontier Biosciences, Osaka University und CiNet, NICT, Japan setzen nun ebenfalls ein Diffusionsmodell - genauer Stable Diffusion - ein, um visuelle Erfahrungen aus MRI-Daten zu rekonstruieren.

Dabei verzichtet das Team auf das sonst oft notwendige aufwendige Training und Feintuning des komplexen KI-Modells. Trainiert werden müssen lediglich einfache lineare Modelle, die die MRT-Signale der unteren und oberen visuellen Hirnregionen auf einzelne Stable-Diffusion-Komponenten abbilden.

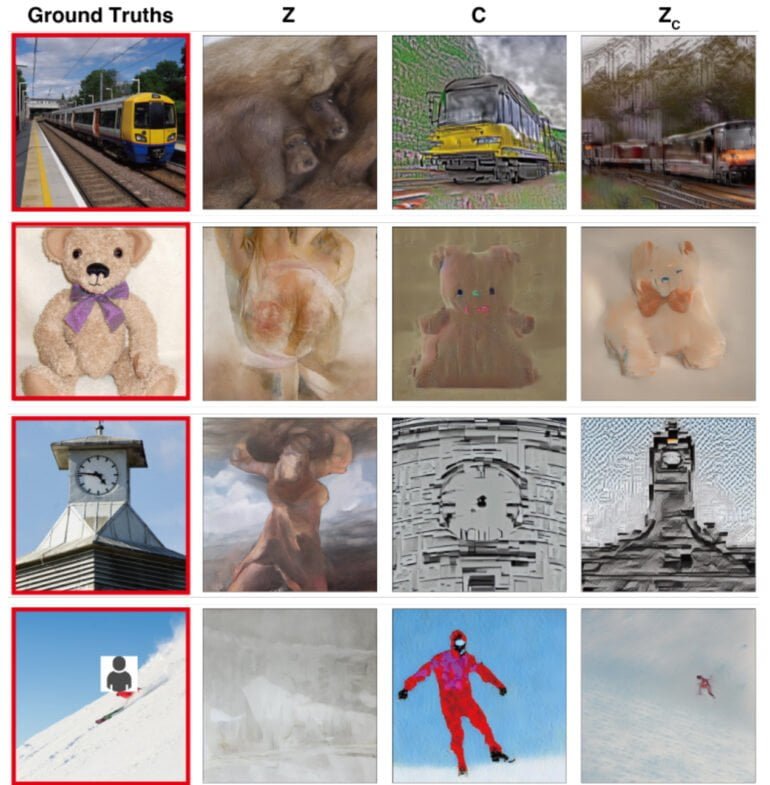

Konkret bilden die Forschenden zwei Hirnregionen ab und verwenden sie als Input für Bild- und Text-Encoder. Dabei werden die unteren Hirnregionen auf den Bild-Encoder und die oberen auf den Text-Encoder abgebildet. So soll das System einfache und semantische Bildeigenschaften für die Rekonstruktion nutzen können.

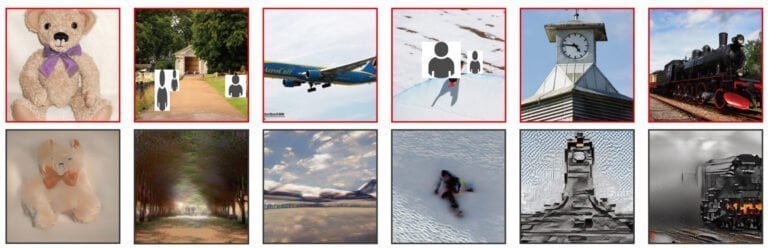

Die Forschenden verwenden für ihr Experiment MRI-Aufnahmen aus dem Natural Scenes Dataset (NSD) und überprüfen, ob sie mit Stable Diffusion rekonstruieren können, welche Motive die Versuchspersonen gesehen haben.

Sie zeigen, dass die Kombination von Bild- und Textkodierung die genaueste Rekonstruktion ermöglicht. Es gibt Unterschiede in der Genauigkeit zwischen verschiedenen Personen - diese korrelieren jedoch auch mit der Qualität der MRT-Aufnahmen, so das Team.

MRT-Rekonstruktion führt zu besserem Verständnis von Diffusionsmodellen

Die Qualität der Rekonstruktionen liegt nach Angaben des Teams auf dem Niveau der derzeit besten Methoden, ohne jedoch das dort notwendige Training der verwendeten KI-Modelle zu erfordern.

Umgekehrt untersucht das Team mit aus den MRT-Daten gewonnenen Modellen auch einzelne Bausteine von Stable Diffusion, z.B. wie semantische Inhalte im inversen Diffusionsprozess entstehen oder welche Prozesse im U-Netzwerk ablaufen.

Ferner nimmt das Team eine quantitative Interpretation der Bildtransformationen in verschiedenen Diffusionsstadien vor. Damit wollen die Forschenden aus biologischer Perspektive einen Beitrag zum besseren Verständnis der zwar weit verbreiteten, aber noch wenig erforschten Diffusionsmodelle leisten.