Xiaomi stellt mit MiMo-V2 drei KI-Modelle vor, die Agenten sehen, handeln und sprechen lassen

Kurz & Knapp

-

Xiaomi hat drei KI-Modelle gleichzeitig vorgestellt, die zusammen eine vollständige Plattform für KI-Agenten bilden sollen: ein großes Sprachmodell, ein multimodales Modell und ein Sprachsynthesemodell.

-

Das Flaggschiff MiMo-V2-Pro erreicht bei Coding und Agenten-Aufgaben fast das Niveau von Anthropics Claude Opus 4.6, kostet über die API aber nur einen Bruchteil. Das multimodale MiMo-V2-Omni kann sehen, hören und eigenständig handeln, etwa im Browser einkaufen oder Dashcam-Aufnahmen auf Gefahren analysieren.

-

Vor der offiziellen Vorstellung lief MiMo-V2-Pro unter dem Codenamen "Hunter Alpha" anonym auf der Plattform OpenRouter und führte dort tagelang die Rangliste an. Viele Nutzer hatten fälschlicherweise vermutet, es handle sich um ein neues Modell von Deepseek.

Das chinesische Technologieunternehmen Xiaomi will KI-Agenten bauen, die selbstständig Software steuern, im Browser einkaufen und perspektivisch auch Roboter kontrollieren. Dafür hat das hauseigene MiMo-Team drei Modelle gleichzeitig vorgestellt.

Das Flaggschiff MiMo-V2-Pro kommt mit seiner Mixture-of-Experts-Architektur laut Xiaomi auf mehr als eine Billion Parameter insgesamt, von denen 42 Milliarden pro Anfrage aktiv sind. Damit ist das Modell etwa dreimal so groß wie der im Dezember 2025 vorgestellte Vorgänger MiMo-V2-Flash. Trotz dieser Größe soll es dank eines Hybrid-Attention-Mechanismus effizient arbeiten und bis zu eine Million Token Kontext verarbeiten. Statt wie üblich ein Wort nach dem anderen vorherzusagen, erzeugt es mehrere Tokens gleichzeitig und wird dadurch deutlich schneller.

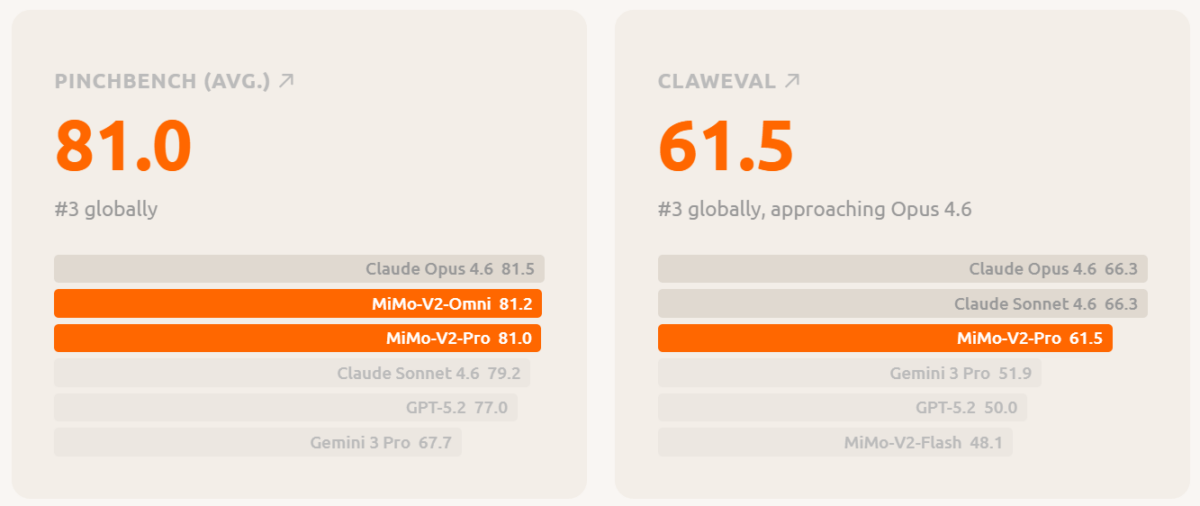

Im Artificial Analysis Intelligence Index belegt MiMo-V2-Pro weltweit Rang 7 und ist nach GLM-5 und MiniMax-M2.7 das stärkste chinesische Sprachmodell. Beim Coding-Benchmark SWE-bench Verified erreicht es 78 Prozent und liegt damit knapp unter Claude Opus 4.6 (80,8), aber nahe an Claude Sonnet 4.6 (79,6). Im Agenten-Benchmark ClawEval kommt es auf 81 Punkte und rückt damit dicht an Claude Opus 4.6 (81,5) heran, während GPT-5.2 bei 77 steht.

MiMo-V2-Pro deutlich günstiger als Anthropic

Xiaomi unterbietet die Konkurrenz beim Preis erheblich: MiMo-V2-Pro kostet laut der Plattform-Seite einen Dollar pro Million Input-Tokens und drei Dollar pro Million Output-Tokens bei Kontextlängen bis 256.000 Token. Claude Sonnet 4.6 liegt bei drei beziehungsweise 15 Dollar, Claude Opus 4.6 bei fünf oder 25 Dollar. Cache-Schreibkosten entfallen bei Xiaomi derzeit komplett.

Das Modell ist über eine öffentliche API verfügbar. Zum Start kooperiert Xiaomi mit fünf Agenten-Frameworks: OpenClaw, OpenCode, KiloCode, Blackbox und Cline. Entwickler weltweit sollen eine Woche lang kostenlosen API-Zugang erhalten.

MiMo-V2-Omni sieht, hört und handelt in einem Modell

MiMo-V2-Omni verschmilzt Bild-, Video- und Audio-Encoder in einem gemeinsamen Backbone. Das Modell soll nicht nur wahrnehmen, sondern aus dem Wahrgenommenen direkt handeln: Es unterstützt nativ strukturierte Tool-Aufrufe, kann Funktionen ausführen und sich in Benutzeroberflächen orientieren.

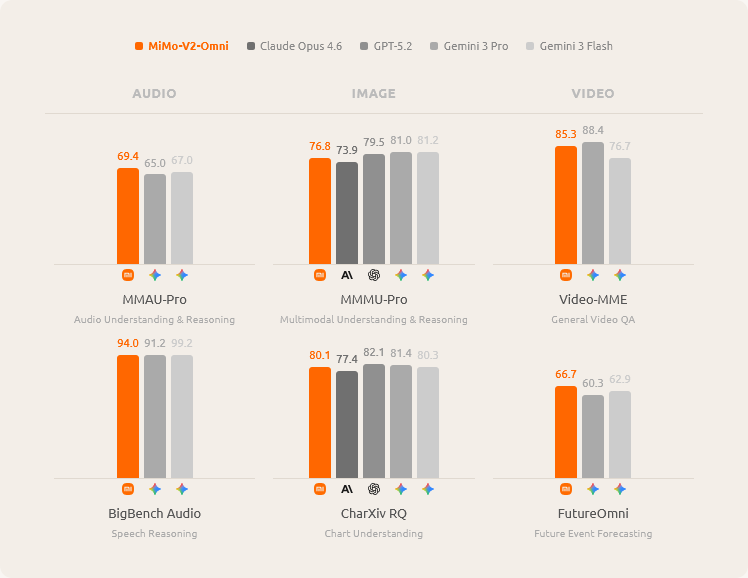

Bei Audio übertrifft MiMo-V2-Omni laut Xiaomi Gemini 3 Pro und versteht kontinuierliche Aufnahmen von über zehn Stunden Länge. Bei Bildern (MMMU-Pro: 76,8) schlägt es Claude Opus 4.6 (73,9). Bei den Agenten-Benchmarks fällt das Ergebnis gemischter aus: Im ClawEval erreicht das Omni-Modell 54,8, was deutlich hinter Claude Opus 4.6 (66,3) und GPT-5.2 (59,6) liegt. Beim MM-BrowserComp für Webnavigation übertrifft es allerdings Gemini 3 Pro und GPT-5.2.

Als Anwendungsbeispiel ließ Xiaomi das Modell Dashcam-Aufnahmen analysieren: Es identifizierte in Echtzeit Fußgänger, einfahrende Fahrzeuge und Engstellen als potenzielle Gefahren. In einem weiteren Szenario navigierte MiMo-V2-Omni eigenständig durch einen Browser, recherchierte Produktbewertungen auf der chinesischen Plattform Xiaohongshu, verglich Preise auf JD.com, verhandelte per Chat mit dem Kundenservice über Rabatte und schloss den Kauf ab.

In einer weiteren Demo erstellte das Modell eigenständig multimediale Inhalte, debuggte den dazugehörigen Code und veröffentlichte das Ergebnis über den Browser auf TikTok, ohne dass ein Mensch eingriff. In allen Fällen trifft MiMo-V2-Omni die Entscheidungen, während das Open-Source-Framework OpenClaw die eigentlichen Aktionen im Browser und Dateisystem ausführt.

MiMo-V2-TTS spricht mit Emotion statt aus einem Dropdown-Menü

Das Sprachsynthesemodell MiMo-V2-TTS wurde laut Xiaomi mit über 100 Millionen Stunden Sprachdaten trainiert. Es zerlegt Sprache intern in mehrere parallele Schichten diskreter Einheiten und soll dadurch Klang, Rhythmus und Emotion feiner steuern können als herkömmliche Systeme.

Der entscheidende Unterschied zu herkömmlichen TTS-Systemen: Nutzer wählen keine Emotion aus einer Liste, sondern beschreiben den gewünschten Sprechstil frei in natürlicher Sprache. "Schläfrig, gerade aufgewacht, leicht heiser" soll anders klingen als "wütend, aber bemüht, ruhig zu bleiben". Das Modell erzeugt zudem paralinguistische Elemente wie Husten, Zögern, Seufzer und Lachen als integrierte Bestandteile, nicht als nachträglich eingefügte Audioclips.

Laut Xiaomi ist MiMo-V2-TTS die einzige kommerziell verfügbare TTS-API, die sowohl Sprache als auch Gesang nativ im selben Modell beherrscht. Typografische Hinweise wie Großbuchstaben oder Zeichenwiederholungen liest das Modell als Regieanweisungen für Betonung und Rhythmus: "THIS IS IMPORTANT" klingt nicht einfach nur lauter, sondern wird mit Nachdruck gesprochen. Auch ohne explizite Stil-Anweisung leitet das Modell den passenden Tonfall direkt aus dem Textinhalt ab.

Starke Benchmarks, aber noch kein Spitzenreiter

Mit drei spezialisierten Modellen auf einmal signalisiert Xiaomi, dass es eine vollständige Plattform für KI-Agenten liefern will. Die Benchmarks zeigen, dass die Modelle in einzelnen Disziplinen an Anthropic und OpenAI heranreichen, in anderen aber noch zurückliegen. Besonders bei allgemeinen Agenten-Aufgaben trennen MiMo-V2-Pro noch einige Punkte von Claude Opus 4.6.

Als nächste Schritte nennt das MiMo-Team, dass es an Langzeit-Planung über Stunden und Tage arbeite, an Echtzeit-Streaming, an koordinierten Multi-Agenten-Systemen und an Robotik. "Wir glauben, dass der Weg zu allgemeiner Intelligenz durch die reale Welt führt", schreibt das Team. "Ein Modell, das nur Text liest, lebt in einer Bibliothek. Ein Modell, das sieht, hört, denkt und handelt, lebt in der Welt."

Hunter Alpha war nicht Deepseek

Bevor Xiaomi das Modell offiziell enthüllte, war MiMo-V2-Pro unter dem Codenamen "Hunter Alpha" anonym auf der API-Plattform OpenRouter gelistet. Dort stieg das Nutzungsvolumen laut Xiaomi stetig: Das Modell führte mehrere Tage die tägliche Rangliste an und wurde insgesamt mit über einer Billion Tokens genutzt. Die meistgenutzten Anwendungen seien durchweg Coding-Tools gewesen.

Viele Nutzer hatten spekuliert, dass es sich bei Hunter Alpha um Deepseek V4 handeln könnte. Deepseek lässt allerdings weiterhin auf sich warten: Laut einem Bericht verzögert sich das nächste große Deepseek-Modell wegen der wachsenden Modellgröße.

Stattdessen drängen andere chinesische Anbieter nach vorn: Zhipu AI hat kürzlich mit GLM-5 ein Open-Source-Modell mit 744 Milliarden Parametern veröffentlicht, das bei Coding und Agenten-Aufgaben mit Claude Opus 4.5 und GPT-5.2 mithalten soll. Moonshot AI setzt mit Kimi K2.5 auf parallel arbeitende Agenten-Schwärme, und Alibaba hat seine Qwen-3.5-Reihe erweitert.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren