Sieben Beispiele für mögliche KI-gestützte Propaganda in der Politik

Update –

- Vorwurf der Wahlbeeinflussung aus China mit Hilfe von KI-Bildern hinzugefügt.

Mit dem Fortschritt der Bildmodelle hin zu immer realistischeren Ergebnissen hat auch die politische Propaganda durch künstliche Intelligenz eine neue Dimension erreicht, wie zahlreiche Beispiele zeigen.

In dem Maße, in dem Bildmodelle zu immer fotorealistischeren Ergebnissen gelangen, wächst auch die Möglichkeit, sie für politische Propaganda zu missbrauchen. Eine neue durch KI geförderte Ära der "Fake News" hat begonnen, wie mehrere Beispiele aus der jüngsten Vergangenheit zeigen.

Nicht immer sind sie so vergleichsweise harmlos wie die Bilder vom Papst, der sich plötzlich überraschend modisch kleidet. Sie können auch ernsthafte Verwirrung stiften, wie im Fall der Bilder, die die vermeintliche Verhaftung von Donald Trump zeigen sollten.

Dass dies keine Einzelfälle sind, zeigen wir in diesem Artikel: Hier sammeln wir Beispiele, in denen KI für politische Manipulation eingesetzt wird. Der Artikel wird regelmäßig aktualisiert.

Bürgermeisterkandidat Anthony Furey in Toronto

In Toronto steht die Wahl eines neuen Bürgermeisters an. Anthony Furey, nach eigenen Angaben selbst seit 15 Jahren im Journalismus und Rundfunk tätig, hat das Potenzial von KI-Bildgeneratoren erkannt und illustriert damit Teile seiner Kampagne. Eines seiner Kernthemen: Er will Torontos Straßen von Obdachlosen "befreien".

So zeigt ein Bild seiner Kampagne eine Straße in Toronto, auf der Menschen ohne Obdach campieren. Ein anderes Bild zeigt einen Mann und eine Frau, ist aber schnell als KI-generiert zu entlarven: Die Frau hat drei Arme.

Eine Quellenangabe für die verschiedenen Bilder sucht man in der digitalen Werbebroschüre allerdings vergeblich. Das Bild mit den drei Armen wurde durch ein weniger auffälliges, ebenfalls KI-generiertes Bild ersetzt.

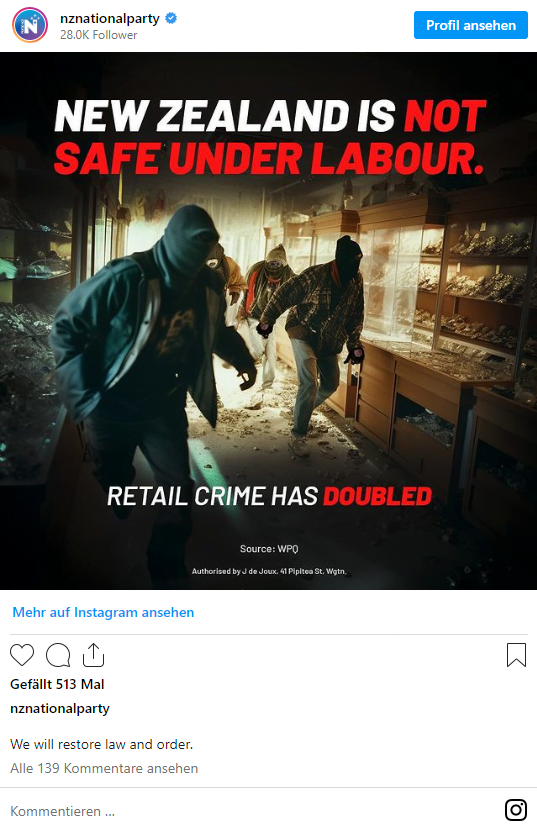

New Zealand National Party

Einen realistischeren Eindruck vermittelt das Bild, das die konservativ-rechtsliberale New Zealand National Party auf Instagram verwendet. "New Zealand is not safe under labour", ist auf ein Bild mit gesichtslosen Einbrechern:innen montiert. Einen Hinweis auf die Herkunft des Bildes gibt es nicht. Wähler:innen reagieren in den Kommentaren unterschiedlich: Während einige die "Trump-artige" Politik verurteilen, begrüßen andere den Einsatz moderner Technologien.

Bürgermeisterkandidat in Chicago

Der Einsatz von KI zur politischen Manipulation ist nicht auf die Erzeugung von Bildern beschränkt. Wie die New York Times berichtet, hat sich ein Kandidat für das Bürgermeisteramt in Chicago darüber beschwert, dass ein seriös erscheinendes Medium seine Stimme auf Twitter geklont habe. Auf diese Weise habe man ihn sagen lassen, er befürworte Polizeigewalt. Ob es sich um einen Fake handelt, kann nicht überprüft werden.

Pentagon

Im Mai 2023 kursierten auf Twitter Bilder eines brennenden Gebäudes, angeblich in der Nähe des Pentagons, die von Accounts verbreitet wurden, die auf den ersten Blick vertrauenswürdig erschienen, weil sie mit einem blauen Haken versehen waren.

Seit Elon Musk die Führung von Twitter übernommen hat, ist dies jedoch kein verlässliches Zeichen mehr für seriöse Informationen, da sich jeder für acht Dollar im Monat einen Account kaufen kann. Der vermeintliche Anschlag auf das Pentagon sorgte für Aufregung und schickte sogar den Aktienindex Dow Jones kurzzeitig auf Talfahrt.

Fake AI image of Pentagon exploding goes viral on Twitterhttps://t.co/xUcUwmZR3u

— The Independent (@Independent) May 23, 2023

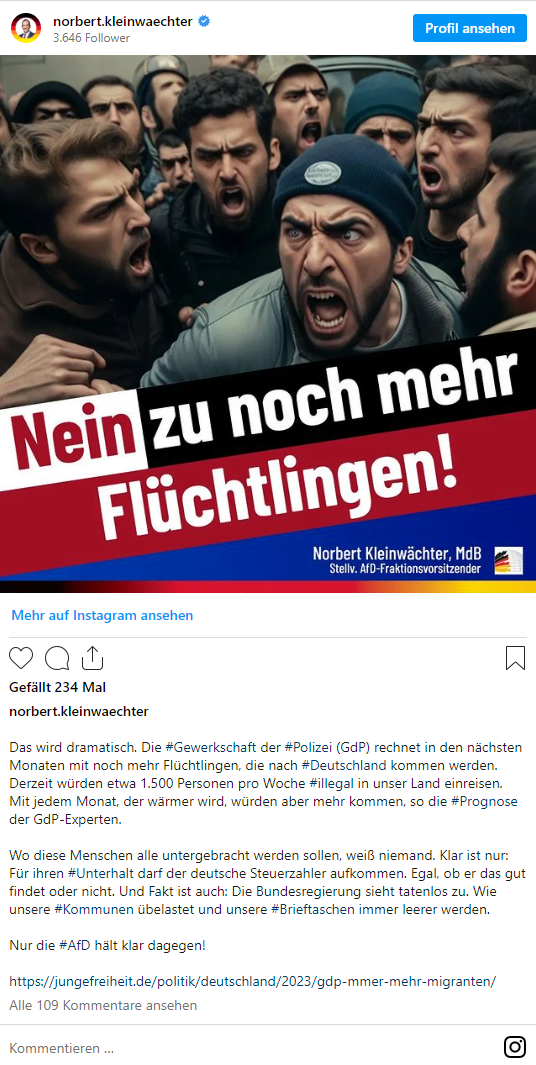

Alternative für Deutschland

Im März 2023 machte der stellvertretende AfD-Fraktionsvorsitzende Norbert Kleinwächter mit einem KI-Bild auf sich aufmerksam. "Nein zu noch mehr Flüchtlingen", heißt es plakativ in seinem Instagram-Post, auf dem wütende Menschen mit aufgerissenen Mündern zu sehen sind. Es war nicht das letzte KI-Bild auf Kleinwächters Kanal, auch politische Gegner karikiert er gerne mit Midjourney.

Verhaftung von Donald Trump

KI kann in Sekundenschnelle Bilder erstellen, die auf den ersten Blick wie echte Fotos aussehen. Das ermöglicht Nutzer:innen mit bösen Absichten, aktuelle Nachrichten aufzugreifen und entsprechende Visualisierungen schnell zu verbreiten.

Als etwa die Öffentlichkeit über eine mögliche Verhaftung des ehemaligen US-Präsidenten Donald Trump diskutierte, tauchten kurz darauf teils fotorealistische Bilder in den sozialen Medien auf, die dies vermeintlich bestätigen sollten.

Auslöser war Eliot Higgins, Gründer der niederländischen Recherche-Organisation Bellingcat, der seine Verhaftungsphantasie mit Midjourney visualisierte und die Ergebnisse auf Twitter teilte.

Vorwurf der Wahlbeeinflussung aus China durch KI-Bilder

Laut einem Bericht von Microsoft haben Forschende des Unternehmens ein Netzwerk gefälschter chinesischer Social-Media-Konten identifiziert, die offenbar versuchen, US-Wähler:innen mithilfe von KI zu beeinflussen. Die Accounts posten angeblich mindestens seit März 2023 politisch aufgeladene Inhalte in englischer Sprache und geben so vor, US-Bürger:innen zu sein.

Ein Beispiel ist laut Microsoft ein "sehr wahrscheinlich" KI-generiertes Bild der Freiheitsstatue mit einem Sturmgewehr und dem Text "Democracy & Liberties: Alles wird weggeworfen. Die Göttin der Gewalt" ("Democratic & Freedoms: Everything is being thrown away. Die Göttin der Gewalt"). Mindestens der Text des Bildes wurde nachträglich hinzugefügt, auch wenn das Bild KI-generiert war.

Microsoft zufolge ähneln die Aktivitäten dieser Accounts einer bereits bekannten chinesischen Informationsoperation, die das US-Justizministerium einer Eliteeinheit des chinesischen Ministeriums für öffentliche Sicherheit zuschreibt. Viele Details nennt der Bericht allerdings nicht.

Die Accounts versuchten, amerikanisch zu wirken, indem sie angeben, in den USA zu sein, amerikanische politische Slogans posten und Hashtags zu innenpolitischen Themen verwenden, schreibt Microsoft und sieht in der Kampagne eine Gefahr für die Integrität der US-Wahlen 2024. China hat die Vorwürfe als vorurteilsbeladen und böswillig zurückgewiesen.

Indes hat sich Google mit einer neuen Werberichtlinie auf KI-generierte Inhalte im US-Wahlkampf vorbereitet. Diese sieht vor, dass "synthetische Inhalte" prominent gekennzeichnet werden müssen.

Dürfen die das?

Das KI-Bildmodell Midjourney, das derzeit als das leistungsfähigste seiner Art gilt und gerade in den letzten Versionen immer näher an den Fotorealismus herangerückt ist, verbietet in seinen Nutzungsbedingungen ausdrücklich die Verwendung seiner Bilder für politische Zwecke.

Die Betreiber von Midjourney können allerdings - sofern sie von solchen Fällen Kenntnis erlangen - wenig dagegen unternehmen, außer Prompts zu moderieren und die entsprechenden Accounts zu sperren. Derartige Konsequenzen sind beim Open-Source-Modell Stable Diffusion ausgeschlossen, das mit SDXL langsam ein ähnliches Niveau erreicht.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.