KI nutzt Vibrationen in der Bildstabilisierung von Smartphone-Kameras für Lauschangriffe

Die Studie zeigt, wie Smartphone-Kameras akustische Informationen aus der Umgebung in Pixeln darstellen - auch wenn das Mikrofon ausgeschaltet ist.

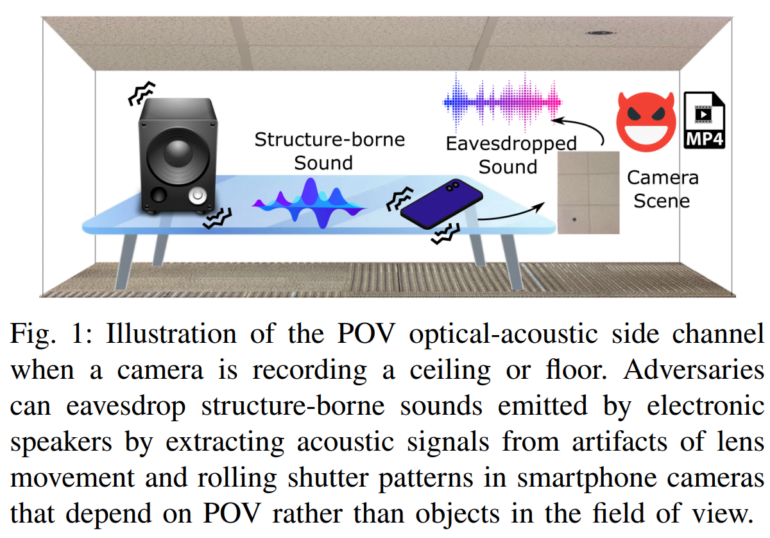

Forschende aus den USA zeigen in einer neuen Arbeit, wie Smartphones mit CMOS, OIS und Autofokus akustische Informationen durch subtile Artefakte in Videos hinterlegen. Diese Artefakte entstehen laut dem Team durch Vibrationen der Linse, die durch Umgebungsgeräusche verursacht werden.

Konkret versetzen Umgebungsgeräusche die Gehäuse und beweglichen Kameralinsen von Smartphones in Schwingung. Die winzigen Vibrationen der Linse werden verstärkt und als Rolling-Shutter-Artefakte im Video kodiert, wodurch unmerkliche Bildverzerrungen entstehen, die akustische Informationen enthalten.

Die Studie zeigt den Signalweg und den Modulationsprozess dieses "optisch-akustischen Nebenkanals" und demonstriert, wie KI-Methoden eingesetzt werden können, um akustische Signale zu extrahieren, indem Bewegungen zwischen Video-Frames verfolgt werden.

Side Eyes ist "im Grunde ein sehr rudimentäres Mikrofon"

"Die meisten heutigen Kameras verfügen über eine so genannte Bildstabilisierungshardware", erklärt Kevin Fu, Professor für Elektrotechnik und Informatik an der Northeastern University. "Es hat sich herausgestellt, dass, wenn man in der Nähe einer Kamera spricht, die über einige dieser Funktionen verfügt, sich das Objektiv leicht bewegt, was als Stimmmodulation bezeichnet wird und die Pixel im Bild verändert." Tausende solcher Bewegungen könnten pro Sekunde aufgezeichnet werden. "Es bedeutet, dass man im Grunde ein sehr rudimentäres Mikrofon erhält", sagt Fu.

In ihren Experimenten mit zehn Smartphones erreichte das Team eine Genauigkeit von knapp 81 Prozent, 91 Prozent und 99,5 Prozent bei der Klassifizierung von zehn gesprochenen Zahlen, 20 verschiedenen Sprechern und dem Geschlecht, wenn die Smartphones in der Nähe von Lautsprechern auf einem Tisch platziert wurden. Dabei ist das Mikrofon ausgeschaltet, das Team hat nur Zugriff auf einen Videostream, die Kamera ist auf den Tisch oder die Decke gerichtet.

Team schlägt Sicherheitsmaßnahmen vor

Mit dieser Methode lässt sich beispielsweise das Geschlecht einer Person, die sich im Raum befindet, aber nicht auf dem Video zu sehen ist, mit einer Genauigkeit von nahezu 100 Prozent bestimmen. Neben dem offensichtlichen Potenzial für Spionage oder andere Angriffe sieht Fu auch Anwendungen in der Strafverfolgung.

"Zum Beispiel in Rechtsfällen oder bei Ermittlungen, wenn es darum geht, die Anwesenheit einer Person zu beweisen oder zu widerlegen, können wir damit wissenschaftlich untermauern, ob jemand wahrscheinlich im Raum war und gesprochen hat oder nicht", sagt Fu. "Das ist ein weiteres Werkzeug, das wir nutzen können, um die Authentizität zu beweisen."

Das Team schlägt auch Hardware-Verbesserungen vor, um die Ursachen von Rolling Shutter und beweglichen Linsen anzugehen. Sie schlagen konkrete Änderungen vor, um die Bedrohung zu verringern, wie die Erhöhung der Verschlusszeit, die Randomisierung der Verschlussmuster und die mechanische Blockierung der Linsenbewegung. Die Kombination mehrerer Abwehrmaßnahmen könnte die Genauigkeit der Methode auf Zufallsniveau senken.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.