KI-Wettrüsten: Big Tech schert sich nicht um Urheberrechte, solange die Daten fließen

Ein Bericht der New York Times zeigt, dass sich die großen KI-Unternehmen nicht um Urheber- und Lizenzrechte scheren, wenn sie Daten für das KI-Training sammeln. Dabei kommen sie sich gegenseitig in die Quere.

Laut dem Bericht der New York Times ignorierten OpenAI, Google und Meta teilweise ihre eigenen Richtlinien und diskutierten sogar darüber, absichtlich Urheberrechte zu verletzen, weil sie davon ausgingen, dass die Konkurrenz dies tun würde.

OpenAI entwickelte etwa das Spracherkennungstool Whisper, um über eine Million Stunden YouTube-Videos zu transkribieren. Das Unternehmen wusste, dass dies rechtlich fragwürdig sein könnte, da YouTube die Nutzung seiner Inhalte für Anwendungen, die nicht mit der Videoplattform in Verbindung stehen, verbietet.

Die so gewonnenen Texte flossen dennoch in die Entwicklung von GPT-4 ein, dem fortschrittlichsten Sprachmodell von OpenAI. Dass OpenAI mit YouTube-Transkripten arbeitet, berichtete The Information schon im Sommer 2023.

Alles hängt an "Fair Use"

Auch Google nutzte Transkripte von YouTube-Videos, um seine eigenen KI-Modelle zu trainieren - möglicherweise ebenfalls eine Verletzung der Urheberrechte der Videomacher.

Google-Sprecher Matt Bryant beteuerte gegenüber der NYT zwar, dass der Konzern Vereinbarungen mit den YouTube-Autoren habe, die eine solche Nutzung erlaubten. Er räumt gegenüber The Verge aber ein, dass Google "unbestätigte Berichte" über die Praxis von OpenAI kenne.

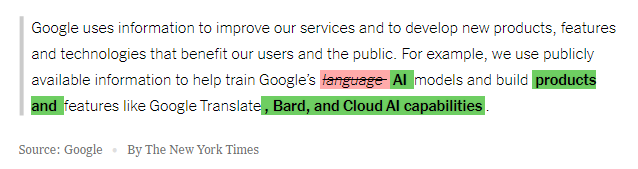

Google hat zudem seine Datenschutzbestimmungen geändert, um mehr Nutzerdaten aus den eigenen Diensten für das KI-Training abziehen zu können. Dies gilt sowohl für YouTube als auch für Inhalte aus Google Docs, Google Sheets und ähnlichen Produkten, um KI-Systeme wie Google Translate und Bard zu verbessern.

Die US-amerikanische Wettbewerbsbehörde FTC sieht solche nachträglichen Anpassungen von Datenschutzbestimmungen, um mehr Daten fürs KI-Training abzuziehen, kritisch und warnt Unternehmen vor diesem Vorgehen.

Auch bei Meta diskutierten Manager und Juristen laut Aufzeichnungen, wie sie trotz Urheberrechtsbeschränkungen an zusätzliche Daten kommen könnten - etwa durch den möglichen Kauf des Verlags Simon & Schuster, der Autoren wie J.K. Rowling und Stephen King verlegt.

Druck kam von Mark Zuckerberg, der schnell mit ChatGPT gleichziehen wollte. Intern wurde argumentiert, dass Lizenzverhandlungen mit Verlagen, Künstlern, Musikern und der Nachrichtenindustrie zu lange dauern würden und dass die Nutzung der Daten wahrscheinlich "Fair Use" sei.

Meta sagte auch, dass Lizenzvereinbarungen in der Größenordnung, wie sie für das KI-Training benötigt werden, nicht erschwinglich seien. Auch OpenAI sagte, dass aktuelle KI-Modelle ohne Training auf urheberrechtlich geschützten Daten nicht möglich seien.

Verklagt Google nun OpenAI?

Der Bericht der NYT macht eines deutlich: Die großen Tech-Konzerne scheren sich beim Datensammeln nicht um die Rechte Dritter, sie haben kaum ethische Bedenken oder biegen die Regeln so, dass sie in ihr Geschäftsmodell passen.

Der Gipfel der Widersprüchlichkeit wäre, wenn Google OpenAI wegen des YouTube-Trainings verklagen würde, wie es YouTube-CEO Neal Mohan kürzlich angedroht hat, während es selbst wegen zahlreicher möglicher Datenrechtsverletzungen vor Gericht steht.

Erst jetzt, wo die ersten großen KI-Modelle verfügbar sind, sich am Markt zu bewähren scheinen und Teile der Öffentlichkeit kritisch nachfragen, bemühen sich KI-Konzerne um die Lizenzierung von Trainingsdaten, etwa von Verlagen, Communities wie Reddit oder Online-Archiven wie Photobucket.

Zudem experimentieren die Unternehmen mit synthetischen Daten für das KI-Training, also Datensätzen, die von KI-Modellen generiert wurden. Diese bergen jedoch Risiken, etwa dass bestehende Fehler und Vorurteile weiter verstärkt werden, was mittelfristig unter anderem zu Leistungseinbußen führen könnte. Überdies stellt sich die Frage des legitimen Datenursprungs, wenn Modelle, die künstliche Trainingsdaten erzeugen, mit geschützten Originaldaten trainiert wurden.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.