"AI-Doomer" warnen vor existenziellen KI-Gefahren - und richten damit selbst Schaden an

Die Forscher Yann LeCun und François Chollet warnen davor, dass pessimistische Prognosen über die Gefahren der KI viele Menschen dazu verleiten, an eine unausweichliche Katastrophe durch KI zu glauben. Statt nach Lösungen zu suchen, könnten die Betroffenen Depressionen und Ängste entwickeln.

Yann LeCun, KI-Experte und Chief AI Scientist bei Meta, übt scharfe Kritik an den sogenannten "AI Doomern", die vor apokalyptischen Szenarien durch Künstliche Intelligenz warnen. In einem X-Thread bezeichnet er sie als "apokalyptische Kulte".

Laut LeCun führen Untergangsprophezeiungen dazu, dass sich viele Menschen hilflos fühlen. Sie glauben, dass es keine Lösungen gibt und der Untergang durch KI unvermeidlich ist. Anstatt sich auf die Suche nach Lösungen zu machen oder zumindest darauf zu hoffen, dass Lösungen gefunden werden, würden die Pessimisten depressiv werden und aufgeben.

"Pessimisten werden einfach depressiv und geben auf, während sie auf ihr Schicksal warten", schreibt LeCun. Seiner Meinung nach sollte ein Risiko nicht einfach abgelehnt werden, nur weil es Angst auslöst. Angst könne ein Weg sein, Energien zu bündeln, um Lösungen zu finden. Derzeit geschehe jedoch das Gegenteil.

Technisch versierte Menschen suchten nach technologischen Lösungen oder hofften zumindest darauf, so LeCun. Sie wüssten, dass mit den richtigen Investitionen und Innovationen technologische Lösungen möglich seien.

Die meisten Menschen fühlten sich jedoch machtlos und manchmal auch wütend oder depressiv. Einige suchten nach politischen oder verhaltensbezogenen Maßnahmen wie Regulierung, die jedoch manchmal radikal und unpraktisch seien, etwa Wachstumsrücknahme oder ein Pausieren des Fortschritts.

Diese "relativ kleine Zahl von Radikalen" werde von wohlhabenden, aber verängstigten Spendern sehr gut finanziert und habe großen Einfluss auf politische Entscheidungsträger und Regulierungsbehörden, so LeCun. Deshalb müsse man sich ihnen entgegenstellen.

Chollet: AI-Doomer und Singularitarier sind eschatologische Kulte

Auch François Chollet, KI-Forscher bei Google, sieht die Auswirkungen der Untergangsprophezeiungen als unterschätztes Problem.

Er höre manchmal von Menschen, die so sicher seien, dass sie in 10-20 Jahren "wegen der KI" tot sein würden, dass sie jegliche langfristige Lebensplanung eingestellt hätten, etwa das Sparen für die Rente.

Manchmal sei es auch umgekehrt: "Ich muss nicht für die Rente sparen, weil es in 10–20 Jahren eine Superintelligenz geben wird und wir in einem Paradies des Überflusses und der Glückseligkeit leben werden", zitiert Chollet entsprechende Aussagen.

"AI Doomer" und "Singularitarier" seien ähnlich geformte eschatologische Kulte, die ansonsten normale Menschen zu gänzlich irrsinnigen Überzeugungen und Verhaltensweisen treiben würden, schreibt Chollet.

Es gebe viele Dinge, über die man sich Sorgen machen müsse, aber eine Machtübernahme durch SkyNet gehöre nicht dazu. Auch das Aufkommen einer allgemeineren KI in den kommenden Jahren werde die Menschen nicht davor bewahren, eine Altersvorsorge zu benötigen. Die heutige KI habe noch kaum Intelligenz und keine Universalität, so Chollet.

Betroffene berichten über Depressionen und Angstzustände

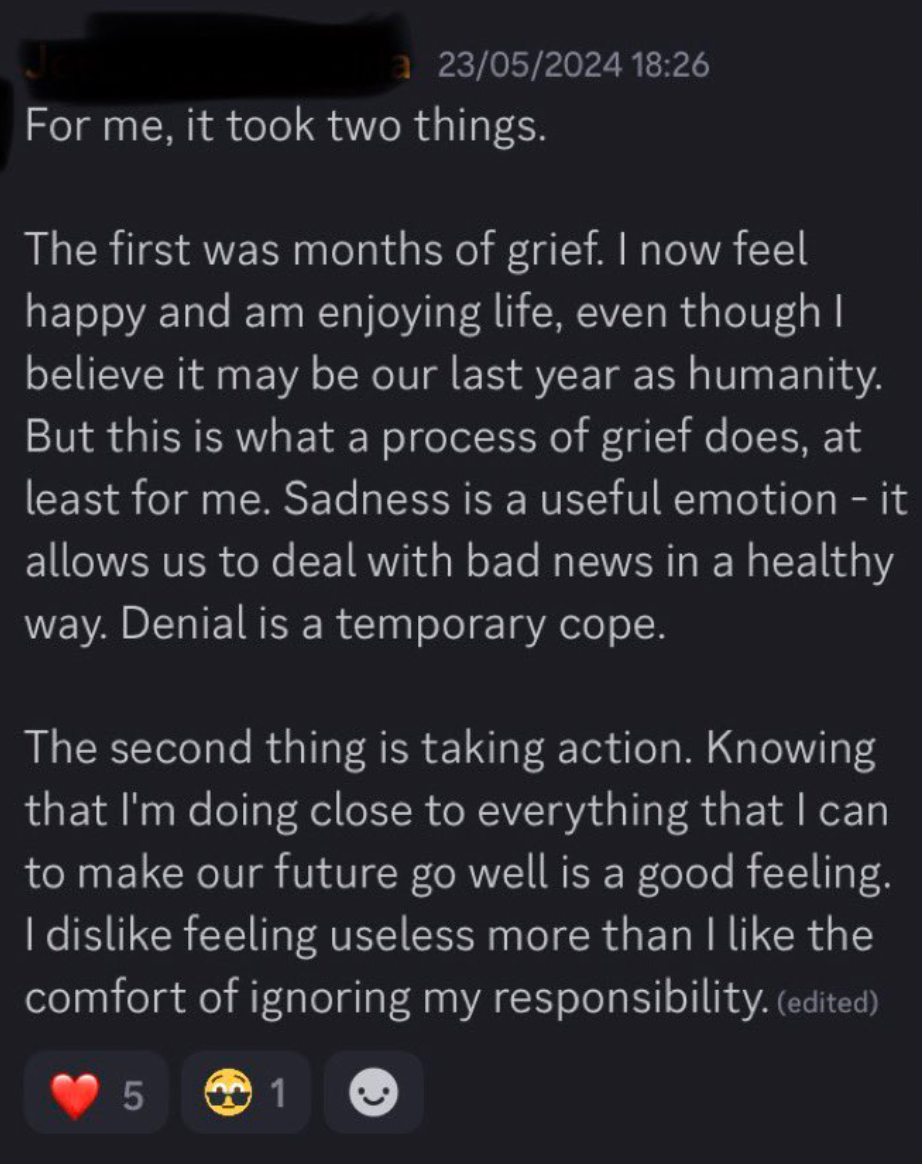

Wie sehr die apokalyptischen Warnungen einige Menschen belasten, zeigen Aussagen aus dem PauseAI-Discord, die der X-Nutzer Angantýr geteilt hat. Darin berichten Betroffene von "monatelanger Trauer" und "sechs Monaten Panik, um meine Familie zu retten". Dieser Beitrag war Anlass für die Kommentare von LeCun und Chollet.

Eine Person schreibt, sie sehe "keinen Ausweg" und wisse nicht, ob sie im letzten Jahr einmal gelacht habe. Eine andere Person berichtet, dass die Fortschritte in der KI sie "wirklich verängstigt" hätten und sie nun "am Rande einer Depression" stehe.

Angantýr betont, dass es nicht darum gehe, sich über die genannten Personen lustig zu machen. Sie seien Opfer einer "bösartigen Ideologie". Zudem sei nicht jede Person in der Gruppe gleichermaßen von den "Doomer-Memes" betroffen.

Ein Teilnehmer schreibt: "Es ist wichtig, sich daran zu erinnern, dass wir es nur mit Expertenmeinungen zu tun haben … Experten irren sich ständig."

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.