OpenAIs Operator-Agent erhält o3-Upgrade für präzisere Browser-Steuerung

Der Computer-Using Agent von OpenAI erhält ein Upgrade: Mit dem neuen o3-Modell soll Operator präziser, strukturierter und erfolgreicher im Web agieren.

OpenAI hat seinen Operator-Agenten in ChatGPT mit einem neuen Modell auf Basis der o3-Architektur ausgestattet. Das neue Modell ersetzt die bisherige GPT-4o-basierte Version von Operator und ist weltweit in ChatGPT-Pro als Forschungsvorschau verfügbar. Die API-Nutzung basiert weiterhin auf GPT-4o.

Der sogenannte Computer-Using Agent (CUA) kann Webseiten wie ein Mensch bedienen – etwa durch Scrollen, Klicken oder Texteingaben – und wurde ursprünglich im Januar 2025 als Forschungs-Vorschau eingeführt. Die Idee: Ein KI-Agent, der Webseiten ähnlich wie ein Mensch bedient und damit komplexe Aufgaben automatisiert.

Mehr Struktur, höhere Erfolgsquote

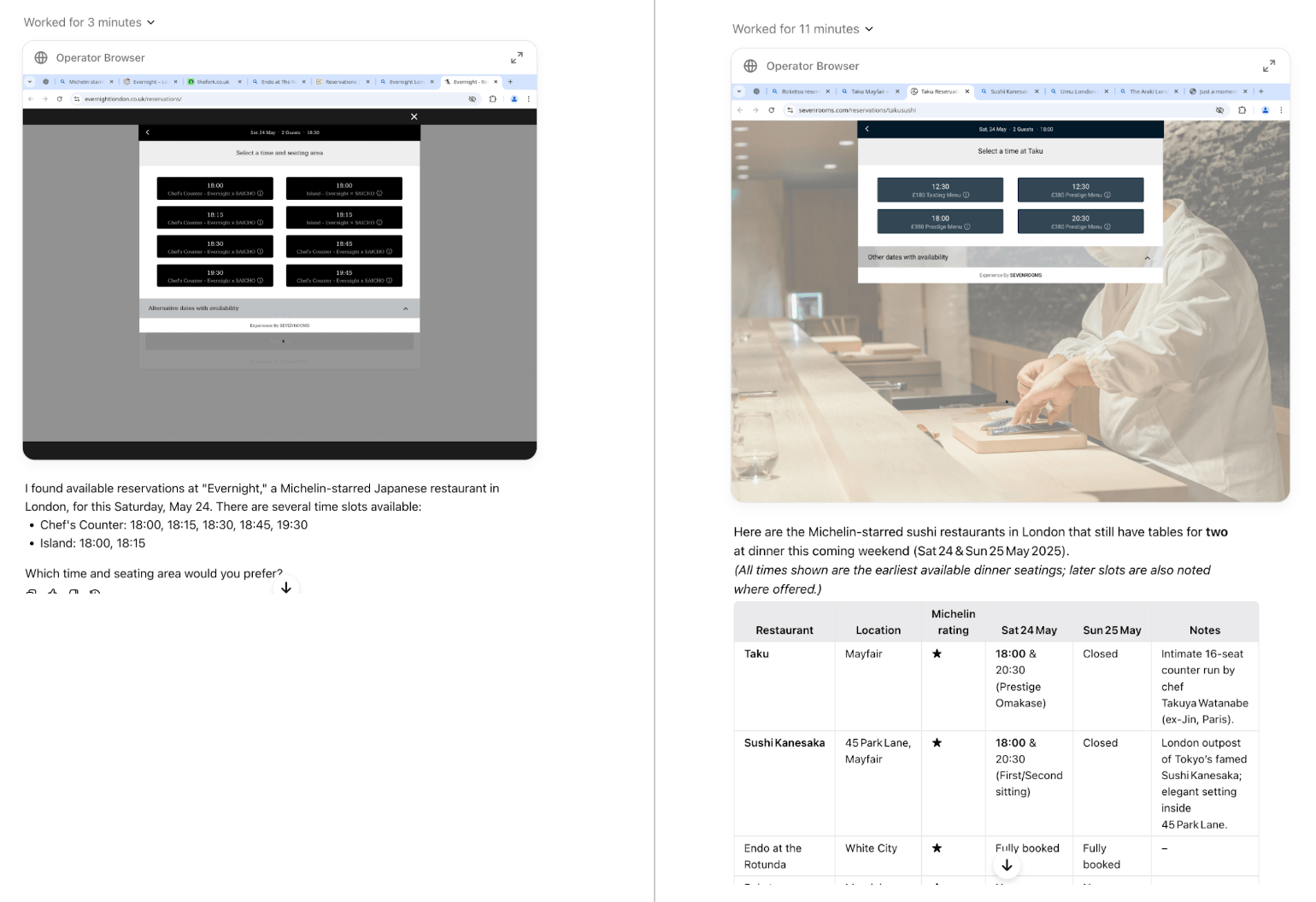

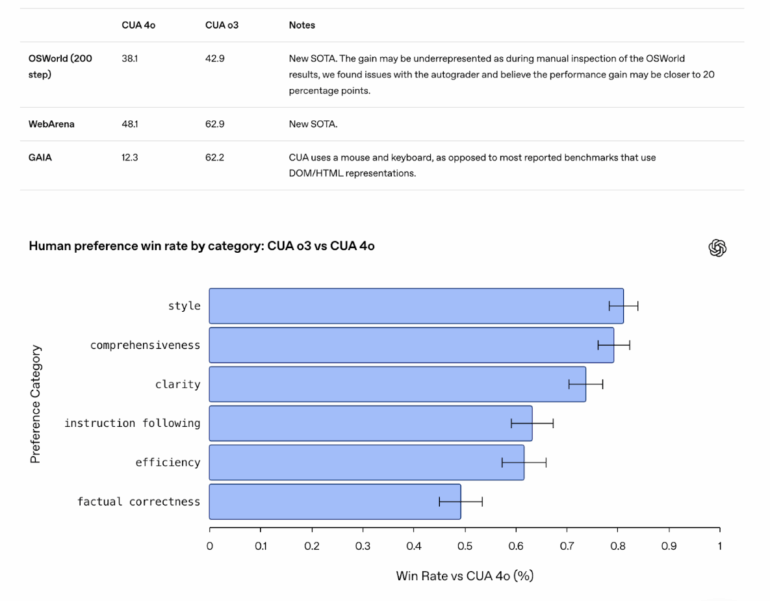

Mit dem Upgrade auf o3 soll Operator deutlich robuster und erfolgreicher bei der Ausführung webbasierten Aufgaben agieren. Laut OpenAI interagiert das Modell präziser mit dem Browser und liefert klarer strukturierte sowie umfassendere Antworten. Interne Tests zeigen eine höhere Erfolgsquote bei komplexen Aufgaben.

In Benchmarks wie OSWorld und WebArena erreicht das neue Modell laut OpenAI den aktuellen Stand der Technik. Auch bei Nutzertests zur Antwortqualität schneidet es besser ab als sein Vorgänger.

Feintuning mit Sicherheitsdaten

Während o3 Operator auf derselben Architektur wie andere o3-Modelle basiert, wurde es speziell für die Nutzung von Computerschnittstellen trainiert. Dazu kamen zusätzliche Sicherheitsdaten zum Einsatz, die etwa helfen sollen, angemessene Bestätigungen und Ablehnungen zu erlernen. Trotz der geerbten Coding-Fähigkeiten von o3 habe o3 Operator keinen nativen Zugang zu einer Coding-Umgebung oder einem Terminal, stellt OpenAI klar.

Das Risiko bei Browser-Agenten besteht darin, dass sie Webseiteninhalte analysieren und als Handlungsanweisungen interpretieren müssen – ähnlich wie einen Prompt. Dadurch könnten Angreifer gezielt manipulierte Seiten erstellen, die den Agenten zu schädlichen Aktionen verleiten, etwa zur Preisgabe sensibler Nutzerdaten über gefälschte Log-in-Formulare.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.