KI-Coding: Neuer Google-Report zeigt massive Adoption bei anhaltenden Vertrauensproblemen

Eine neue Umfrage von Google Cloud zeigt: KI-gestützte Softwareentwicklung ist längst kein Nischenthema mehr. Fast alle Befragten nutzen KI-Tools regelmäßig, mit wachsender Abhängigkeit.

Laut dem Bericht State of AI-assisted Software Development nutzen mittlerweile 90 Prozent der Befragten künstliche Intelligenz als Teil ihrer Arbeit. Das entspricht einem Anstieg um 14 Prozentpunkte gegenüber dem Vorjahr.

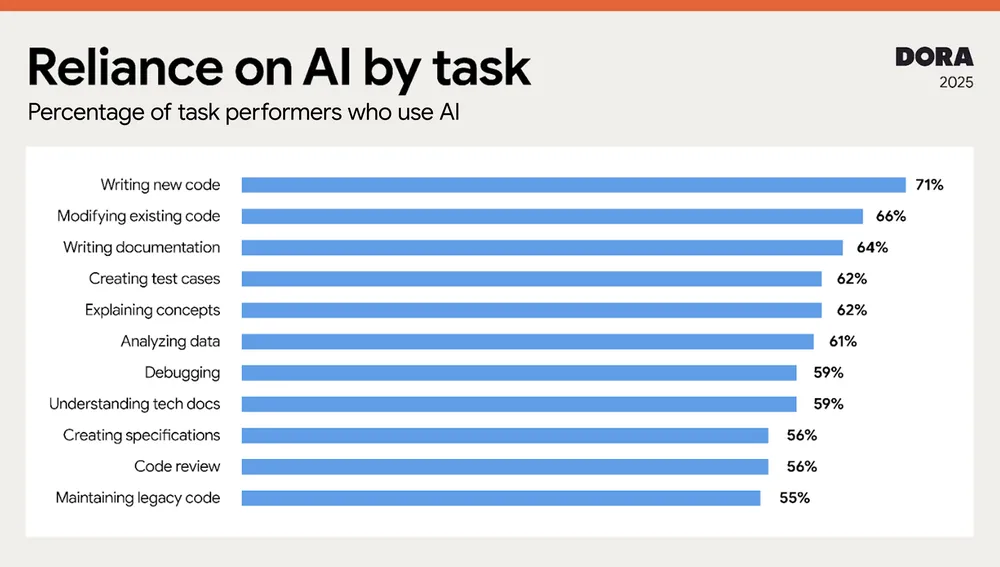

Die befragten Technologie-Professionellen – von Entwickler:innen bis Produktmanager:innen – integrieren KI zunehmend in ihre Kernarbeitsabläufe und verbringen im Median zwei Stunden täglich mit entsprechenden Tools.

Die Abhängigkeit von KI ist dabei beträchtlich: 65 Prozent der Befragten geben an, stark auf KI angewiesen zu sein. Davon berichten 37 Prozent von einer „moderaten“, 20 Prozent von „viel“ und 8 Prozent von „sehr viel“ Abhängigkeit.

Produktivität steigt, Vertrauen bleibt begrenzt

Die Vorteile der KI-Nutzung sind laut Google Cloud deutlich messbar: Über 80 Prozent der Befragten berichten von gesteigerter Produktivität durch KI, 59 Prozent sehen eine positive Auswirkung auf die Code-Qualität.

Gleichzeitig offenbart der Report ein "Vertrauensparadox": Zwar geben 24 Prozent der Teilnehmenden an, "viel" (20 Prozent) oder "großes" (4 Prozent) Vertrauen in KI zu haben, doch 30 Prozent vertrauen den KI-Outputs nur "wenig" (23 Prozent) oder "gar nicht" (7 Prozent). Die Studie legt nahe, dass KI-Ergebnisse trotz begrenzten Vertrauens als nützlich und wertvoll eingeschätzt werden.

Laut Google Cloud zeigt die diesjährige Studie eine Trendwende: Die Nutzung von KI-Werkzeugen geht nun mit einem höheren Software-Durchsatz einher – Teams veröffentlichen also mehr Anwendungen und Softwareprodukte. Das sei eine Umkehrung der Ergebnisse aus dem Vorjahr, als noch keine klare Verbindung zwischen KI-Nutzung und Produktivitätszuwachs festgestellt wurde.

Ein zentrales Problem bleibt jedoch bestehen: die Stabilität der ausgelieferten Software. Laut Bericht stellt die Sicherstellung funktionierender Software weiterhin eine große Herausforderung dar.

KI hemmt den Kompetenzaufbau

Der jüngste DORA-Bericht enthält auch eine kritische Analyse des KI-Einsatzes in der Softwareentwicklung, verfasst von Matt Beane, Professor an der University of California, Santa Barbara. Beane beschreibt KI als doppelschneidiges Schwert: Sie steigere kurzfristig die Produktivität, könne aber langfristig die Entwicklung technischer Fähigkeiten ausbremsen.

In traditionellen Entwicklerteams fließen Wissen und Erfahrung von Senior- zu Junior-Entwickler:innen – etwa durch Pair Programming und gemeinsames Problemlösen. Diese Strukturen würden durch den Einsatz intelligenter Automatisierung unterlaufen, so Beane.

Statt praktischer Lernerfahrungen würden Junioren zunehmend durch KI ersetzt oder marginalisiert. In über 31 untersuchten Berufen zeigte sich laut Beane, dass KI-Einsatz klassische Lernpfade unterbricht und damit zentrale Entwicklungsmöglichkeiten für Einsteigende einschränkt.

Beane plädiert für einen doppelten Fokus: Nur wenn Produktivität und Skill-Entwicklung gemeinsam gefördert werden, könne nachhaltige Softwarequalität entstehen. In seinen eigenen Studien zeigte sich, dass hohe Produktivität nur dort erreicht wurde, wo gleichzeitig aktiv an der Kompetenzentwicklung gearbeitet wurde.

Ein Lösungsansatz sei der gezielte Einsatz von API-Zugängen zur Analyse von Entwickler-Interaktionen mit KI-Systemen, etwa durch die Verknüpfung von KI-Nutzung mit Versionskontrolle und konkreten Lernergebnissen.

KI als "Spiegel und Verstärker"

Die Untersuchung von Google Cloud legt nahe, dass KI in Organisationen als "Spiegel und Verstärker" wirkt: In gut strukturierten Teams steigert sie die Effizienz, in fragmentierten Strukturen macht sie bestehende Schwächen sichtbarer.

Um diese Zusammenhänge besser zu verstehen, identifiziert der diesjährige Report sieben Team-Archetypen – von "harmonious high-achievers" bis zu Gruppen, die in einem "legacy bottleneck" stecken. Die Einordnung soll Organisationen dabei helfen, das Zusammenspiel von Leistung, Wohlbefinden und Arbeitsumfeld besser zu erfassen.

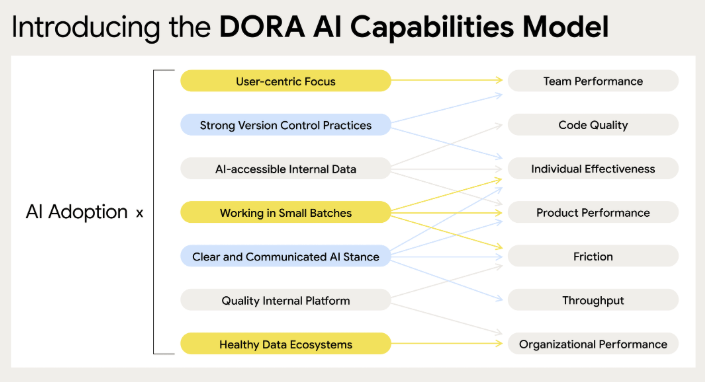

Laut Google Cloud reicht die bloße Einführung von KI-Werkzeugen nicht aus, um nachhaltige Erfolge zu erzielen. Deshalb stellt das Unternehmen in diesem Jahr ein neues Rahmenwerk vor: Das DORA AI Capabilities Model beschreibt sieben Fähigkeiten, die sowohl technische als auch kulturelle Aspekte abdecken und die Wirkung von KI in Teams verstärken sollen.

Auch andere Untersuchungen zeichnen ein klares Bild des Spannungsfelds zwischen Nutzung und Vertrauen: Laut der Stack Overflow Developer Survey 2025 setzen 84 Prozent auf KI-Tools oder planen dies, doch nur 33 Prozent halten deren Code-Ausgaben für zuverlässig – häufig wegen Lösungen, die „fast richtig, aber nicht ganz“ sind.

Gleichzeitig demonstriert die Forschung rasant steigende Fähigkeiten: Ein System von OpenAI löste bei den ICPC World Finals 2025 alle zwölf Aufgaben und übertraf damit menschliche Teilnehmende und Googles Konkurrenzmodell. Beide Wettbewerbsmodelle sind bisher nicht kommerziell verfügbar.

Weitere Studien aus 2025 schärfen den Blick auf Risiken und Effekte von KI im Coding-Alltag: Eine US‑Studie zu Deepseek zeigt, dass das Modell bei politisch sensiblen Anfragen häufiger unsicheren Code liefert. Eine randomisierte Untersuchung des Forschungsinstituts METR belegt zudem, dass erfahrene Open‑Source‑Entwickler mit KI‑Assistenz im Schnitt 19 Prozent länger benötigen – obwohl sie sich schneller fühlen, wie die Auswertung zeigt. Und eine Sicherheitsanalyse warnt vor „Slopsquatting“: Rund jeder fünfte KI‑Codeschnipsel enthält erfundene Bibliotheken – ein potenzielles Einfallstor für Supply‑Chain‑Angriffe.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.