Adobe Firefly integriert über 30 KI-Modelle und lässt Nutzer eigene Bildstile trainieren

Kurz & Knapp

- Adobe erweitert seine KI-Plattform Firefly um Custom Models: Nutzer können ein Modell mit zehn bis 30 eigenen Bildern trainieren, um einen visuellen Stil etwa für Illustrationen, Charaktere oder Fotolooks konsistent zu reproduzieren. Die Modelle bleiben privat, die erzeugten Inhalte gehören dem Nutzer.

- Firefly bündelt inzwischen über 30 KI-Modelle verschiedener Anbieter wie Google, Runway, OpenAI und neu Kling 2.5 Turbo in einer Umgebung. Nutzer können mit verschiedenen Modellen generieren, verfeinern und Ergebnisse vergleichen, laut Adobe mit unbegrenzten Bild- und Videogenerierungen.

- Mit Project Moonlight entwickelt Adobe konversationsbasierte KI-Assistenten, die über mehrere Apps hinweg arbeiten. Nutzer beschreiben Ziele im Chat, die Agenten führen dann konkrete Aktionen mit Adobes Werkzeugen aus. Moonlight befindet sich in einer privaten Beta.

Adobe erweitert seine KI-Kreativplattform Firefly um benutzerdefinierte Modelle, die auf eigenen Bildern trainiert werden können. Außerdem bündelt das Unternehmen über 30 KI-Modelle verschiedener Anbieter in einer einzigen Umgebung.

Das Unternehmen baut seine KI-Kreativplattform Firefly über die letzten Monaten zu einem umfassenden Studio aus, das Modelle verschiedener Anbieter, eigene Bearbeitungswerkzeuge und konversationsbasierte KI-Assistenten unter einem Dach vereint. Neu sind sogenannte Custom Models, die ab sofort als öffentliche Beta verfügbar sind.

Eigene Stile als wiederverwendbare KI-Modelle

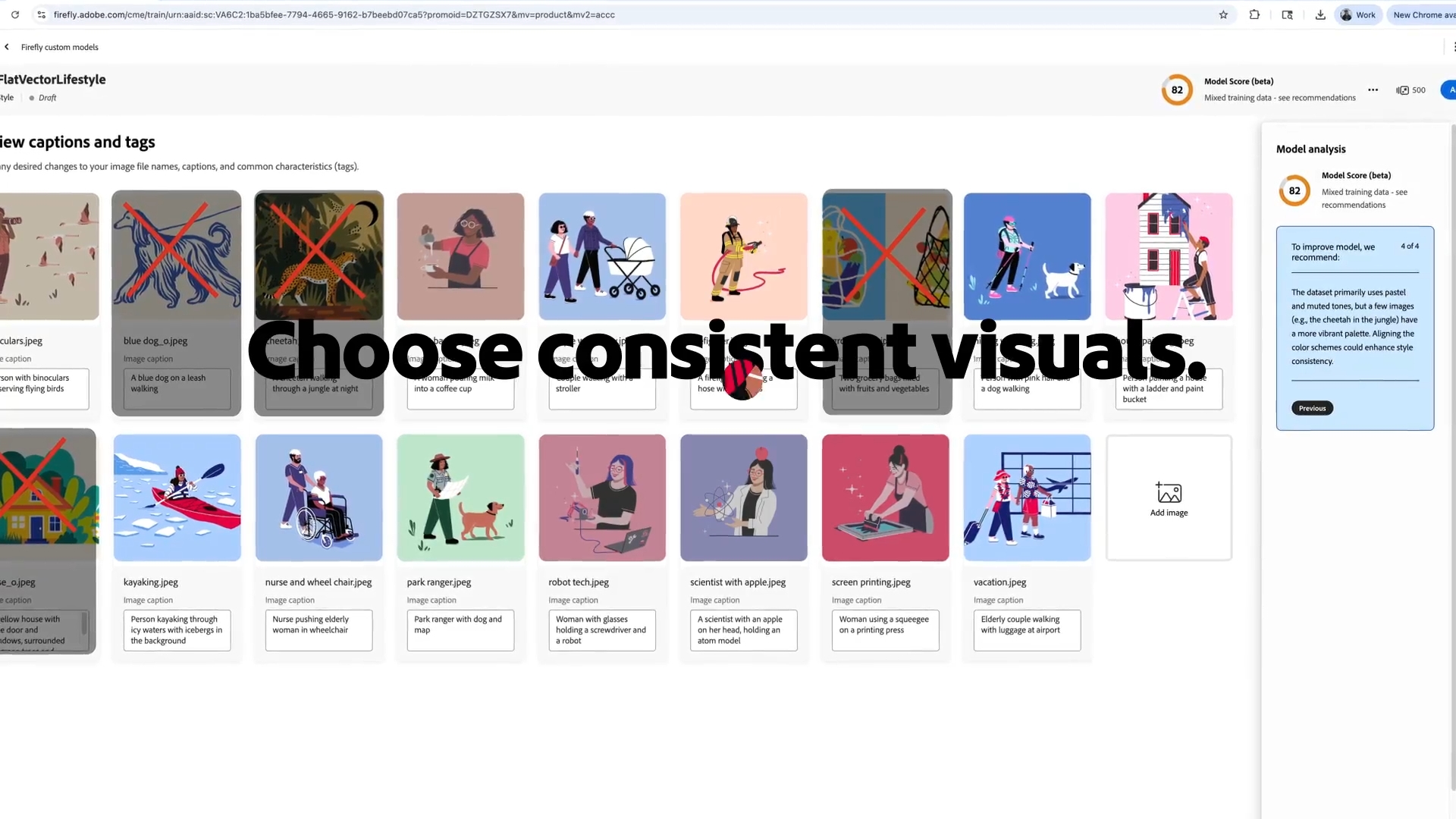

Mit den Custom Models können Nutzer ein KI-Modell auf Basis von zehn bis 30 Bildern (JPG oder PNG) trainieren, um einen bestimmten visuellen Stil zu erfassen. Laut Adobe ist die Funktion für drei Anwendungsbereiche optimiert: Illustrationsstile, bei denen Strichstärke, Füllungen und Farbkonsistenz entscheidend sind; Charaktere, die über verschiedene Szenen hinweg einheitlich erscheinen sollen; und fotografische Looks, bei denen ein bestimmter visueller Stil über viele Bilder hinweg reproduziert werden muss.

Das trainierte Modell soll Details wie Strichstärke, Farbpaletten, Beleuchtung und Charaktermerkmale über Generierungen hinweg bewahren. Einmal erstellt, lässt es sich laut Adobe über Projekte und Kampagnen hinweg wiederverwenden. Die Modelle sind standardmäßig privat, die damit erzeugten Inhalte gehören dem Nutzer.

Adobe bezeichnet die Funktion als besonders relevant für Teams, die große Mengen an Inhalten produzieren und dabei visuelle Konsistenz wahren müssen. Das Unternehmen will die Funktion auf Basis von Feedback aus realen Workflows weiterentwickeln.

Die Custom Models sind keine völlig neue Funktion: Adobe hatte das Konzept bereits auf dem Adobe Summit 2024 angekündigt. Damals stellte das Unternehmen die Möglichkeit vor, Firefly mit zehn bis 20 Trainingsbildern auf eine eigene Corporate-Design-Sprache anzupassen. Die jetzige öffentliche Beta erweitert diesen Ansatz und optimiert ihn gezielt für Illustration, Charakterdesign und fotografische Stile.

Über 30 Modelle verschiedener Anbieter in einer Plattform

Firefly bündelt mittlerweile mehr als 30 KI-Modelle in einer einzigen Umgebung. Neben Adobes eigenem Firefly Image Model 5, das nun allgemein verfügbar ist, stehen Modelle von Google (Nano Banana 2 und Veo 3.1), Runway (Gen-4.5) und OpenAI zur Verfügung. Neu hinzugekommen ist laut Adobe das Modell Kling 2.5 Turbo.

Die Plattformstrategie sieht vor, dass Nutzer mit einem Modell generieren, mit einem anderen verfeinern und Ergebnisse vergleichen können. Derzeit bietet Adobe nach eigenen Angaben unbegrenzte Video- und Bildgenerierungen über die verfügbaren Modelle hinweg an.

Project Moonlight führt vom Prompt zum Gespräch

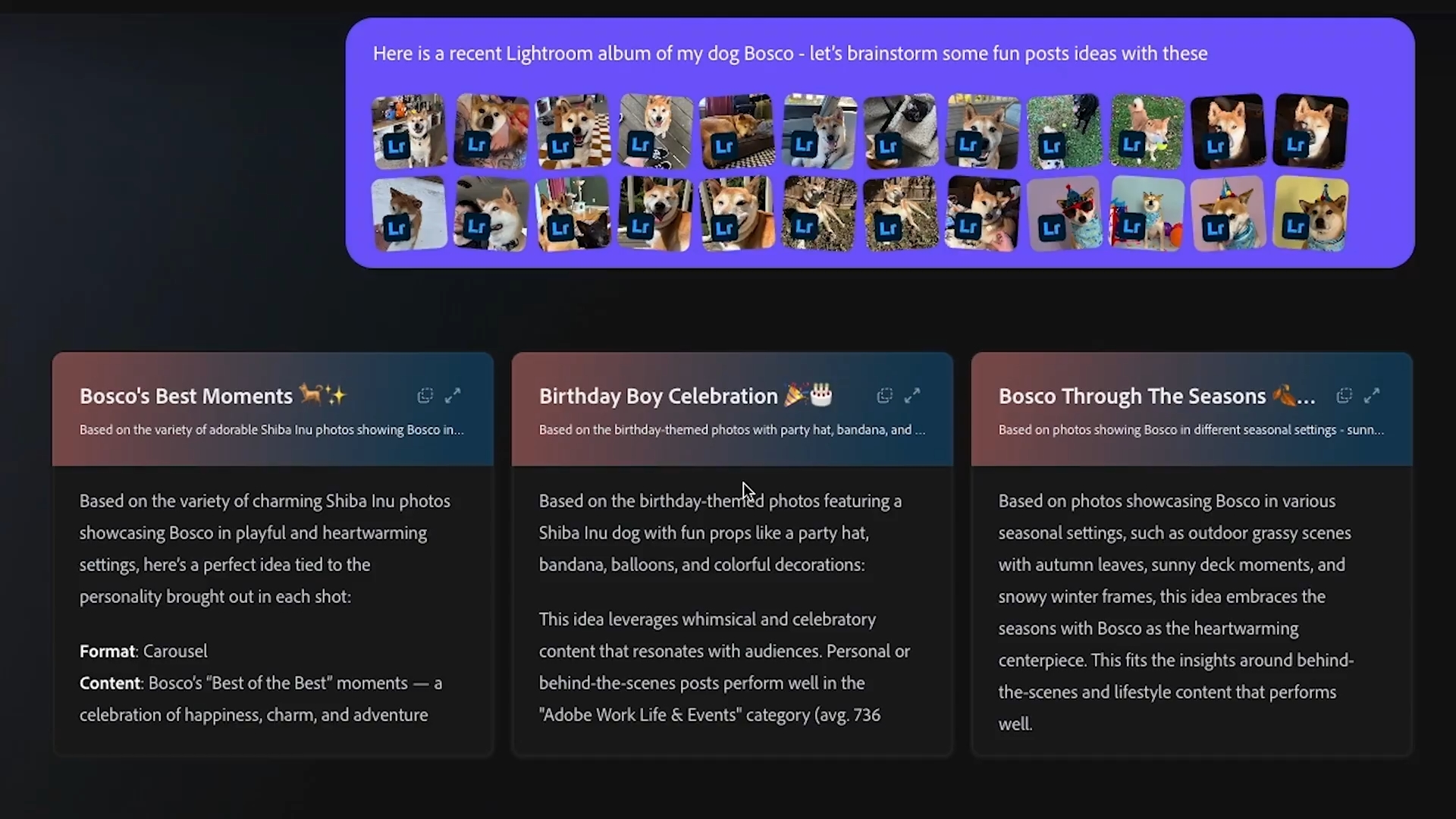

Adobe treibt zudem die Entwicklung konversationsbasierter KI-Assistenten voran. Das Unternehmen führt sogenannte agentische KI-Assistenten in mehreren Produkten ein, darunter Photoshop, Express und Acrobat. Nutzer beschreiben ihre Ziele in einem Chat, woraufhin die Agenten konkrete Aktionen mit Adobes Werkzeugen ausführen sollen.

Das übergreifende Projekt heißt Moonlight und wurde erstmals auf der MAX-Konferenz vorgestellt. Es handelt sich um ein konversationsbasiertes, agentisches Interface, das über mehrere Adobe-Apps hinweg arbeiten soll. Moonlight soll den Stil des Nutzers verstehen und auf dessen eigene Assets und Bibliotheken zugreifen. Das Projekt befindet sich derzeit in einer privaten Beta, deren Zugang Adobe nun per Formular erweitert.

Bereits auf der Adobe MAX 2025 im Oktober hatte Adobe die Integration externer KI-Modelle von Google, OpenAI, Runway und weiteren Anbietern in seine Creative Cloud angekündigt und erstmals Project Moonlight als Vorschau gezeigt. Seitdem hat das Unternehmen das Angebot schrittweise erweitert: Im Februar stellte Adobe die KI-Schnittfunktion Quick Cut vor, die Rohmaterial automatisch in einen strukturierten Erstedit verwandelt.

Parallel dazu integrierte Adobe Photoshop, Acrobat und Express direkt in ChatGPT, sodass Nutzer Bilder und Dokumente per Texteingabe im Chatbot bearbeiten können. Auch Konkurrent Midjourney hat kürzlich mit V8 eine neue Modellversion zum Community-Test freigegeben, die fünfmal schneller generieren soll, aber als reines Diffusionsmodell bei der Prompt-Präzision weiterhin hinter hybriden Architekturen zurückbleibt.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnieren