Aus Angst vor Killer-Robotern: KI-Forscher boykottieren südkoreanische Universität

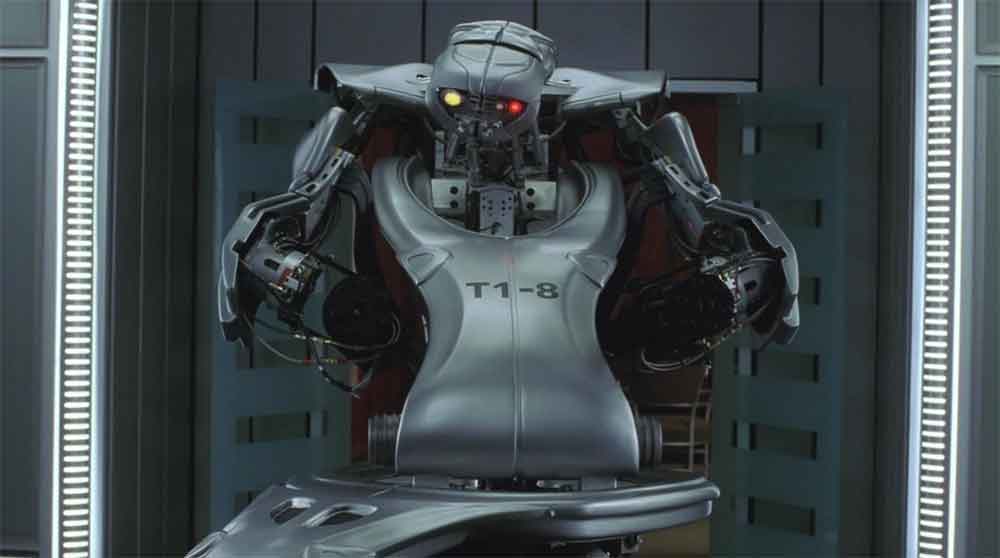

Eine südkoreanische Universität soll mit einem Rüstungsunternehmen an autonomen Waffensystemen arbeiten. KI-Experten weltweit sind besorgt und rufen zu einem internationalen Boykott auf.

Das Korea Advanced Institute of Science and Technology (KAIST) eröffnete im Februar ein Forschungszentrum, das nationale Verteidigungssysteme auf Basis künstlicher Intelligenz entwickeln soll. In einer mittlerweile gelöschten Ankündigung hieß es, dass die Universität unter anderem an KI-gestützten Entscheidungssystemen, U-Booten und Flugzeugen arbeitet.

Für die Forschung kooperiert KAIST mit Hanwha, einem der größten südkoreanischen Konzerne. Hanwha stellt Streumunition her, die in 120 Ländern verboten ist - mit Ausnahme der USA, Russland, China und Südkorea.

Widerstand der internationalen KI-Gemeinschaft

Die Allianz hat unter KI-Experten Besorgnis erregt. Toby Walsh, ein KI-Professor der Universität von South Wales, wurde durch einen Zeitungsartikel auf die Kooperation aufmerksam und versuchte, mit KAIST in Kontakt zu treten, erhielt jedoch keine Antwort.

Nun organisiert der KI-Spezialist einen Widerstand gegen die Pläne der Universität. Mit einem offenen Brief, der von mehr als 50 KI-Forschern aus knapp 30 Ländern unterzeichnet wurde, ruft er zu einem Boykott der Forschungseinrichtung auf.

In dem Schreiben steht, dass man künftig nicht mehr mit KAIST zusammenarbeiten oder Forscher der Universität empfangen werde. Der Grund: Die Allianz zwischen der Universität und dem Waffenhersteller würde zu einem KI-Waffenwettrüsten beitragen, der Killer-Roboter hervorbringen könnte.

"Es gibt viele großartige Dinge, die man mit KI machen kann, die - auch im militärischen Kontext - Leben retten können. Aber offen zu verkünden, dass man autonome Waffen mit einem derartigen Partner entwickelt, ist besorgniserregend", sagt Walsh gegenüber The Guardian.

Der Leiter der Universität Sung-Chul Shin bedauert den Boykott und weist alle Anschuldigungen von sich. "KAIST hat keine Absichten, autonome Waffensysteme und Killer-Roboter zu bauen", schreibt Shin in einer Stellungnahme. "Als akademische Institution halten wir Menschenrechte und ethische Standards hoch."

Wehret den Killer-Roboter-Anfängen

Der KI-Philosoph Max Tegmark sieht in der Künstlichen Intelligenz eine große Chance für die Menschheit - sofern sie die Zügel in der Hand behält. Laut Tegmark muss die Menschheit für eine positive Entwicklung von KI-Technologie drei Grundregeln beachten. Eine dieser Regeln lautet, die Entwicklung und den Einsatz autonomer Waffensysteme zu verhindern. Hierfür brauche es internationale Abkommen.

Tegmark gehört zum Kreis der Forscher und Tech-Experten, die sich im Juli in einem offenen Brief an die UN gegen Killer-Roboter aussprachen. Angeführt werden die 116 Experten von Tech-Visionär Elon Musk und Mustafa Suleyma, Mitgründer von Googles KI-Abteilung Deepmind.

Der Boykott der südkoreanischen Universität wurde im Vorfeld eines Treffens der Vereinten Nationen ausgerufen, das nächste Woche in Genf stattfindet und sich mit der Entwicklung autonomer Waffensysteme beschäftigt.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.