Matthias Bastian

Online-Journalist Matthias ist Gründer und Herausgeber von THE DECODER. Er ist davon überzeugt, dass Künstliche Intelligenz die Beziehung zwischen Mensch und Computer grundlegend verändern wird.

Read full article about: o3-Benchmark: OpenAIs KI-Modell erreicht Bestwert bei Verarbeitung langer Texte

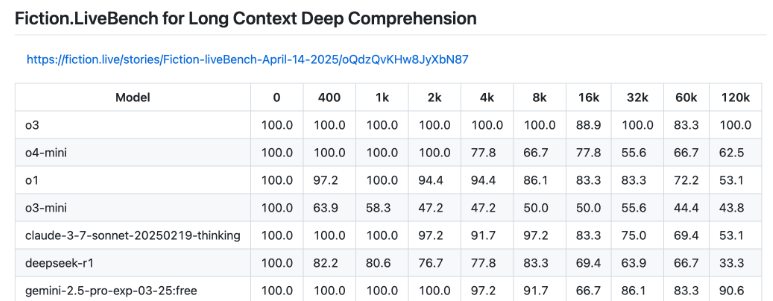

Der wohl interessanteste o3-Benchmark ist die Ausperformance bei der Verarbeitung langer Kontexte. Bei 128K Token (etwa 96.000 Wörter) von maximal 200K Token erreicht o3 im Fiction.live-Benchmark als erstes Modell 100 Prozent – das ist vielversprechend für KI-Anwendungen mit sehr langen Texten. Nur Googles Gemini 2.5 Pro kann mithalten und kommt auf 90,6 Prozent. o3-mini und o4-mini fallen deutlich ab. Fiction.LiveBench prüft, wie gut KI-Modelle komplexe Geschichten und Zusammenhänge bei sehr langen Texten komplett verstehen und korrekt wiedergeben. Ein Negativbeispiel ist Metas Llama 4, das zwar mit einem Kontextfenster von bis zu zehn Millionen Token wirbt, das aber über eine einfache Wortsuche hinaus kaum brauchbar ist.

Read full article about: Googles Hybrid-Reasoning-Modell Gemini 2.5 Flash jetzt für Entwickler testbar

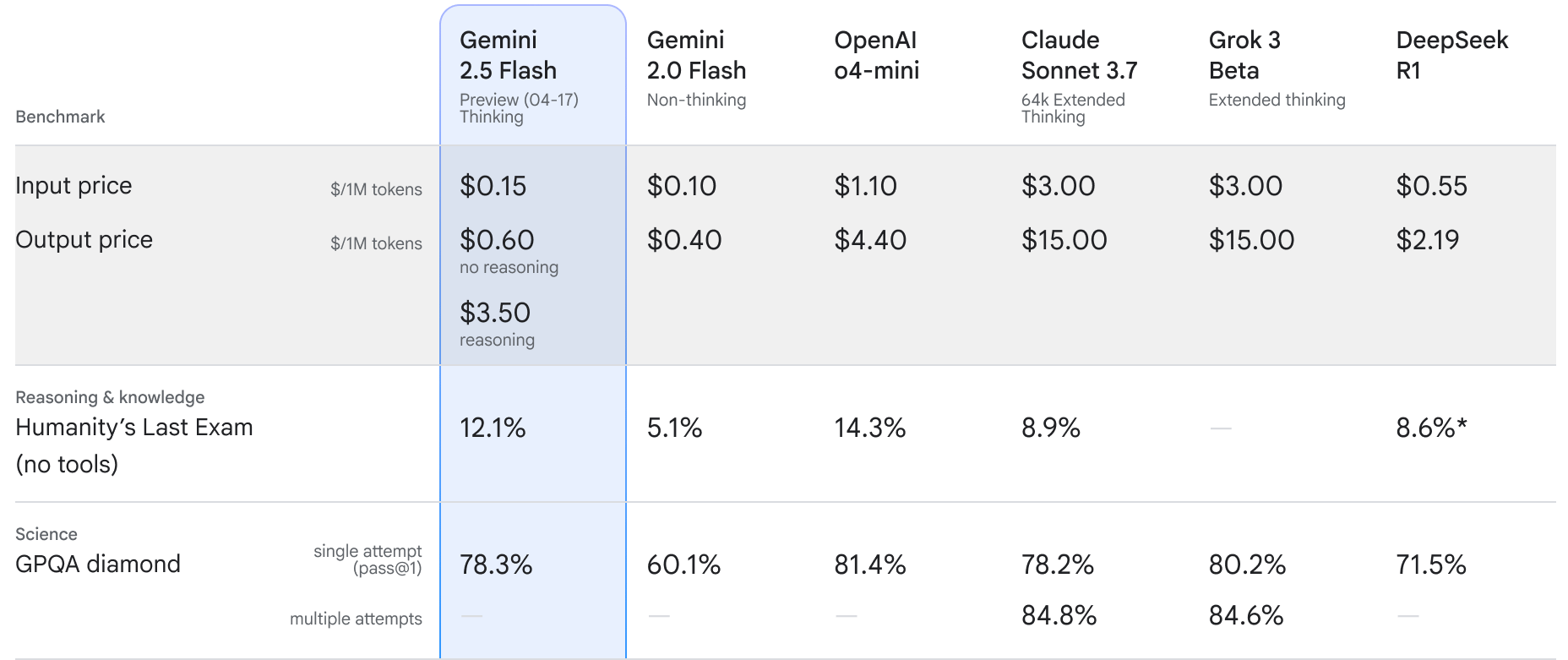

Google hat eine frühe Vorschau von Gemini 2.5 Flash veröffentlicht. Entwickler können das Modell über die Gemini API mittels Google AI Studio und Vertex AI testen. Das Modell ist auch für Nutzer in der Gemini App verfügbar. Es basiert auf dem Vorgänger 2.0 Flash, soll aber verbesserte Fähigkeiten zum logischen Denken bieten, bei gleichzeitiger Optimierung von Geschwindigkeit und Kosten. Laut Google ist es ein hybrides Modell, bei dem Entwickler das "Denken" steuern und Budgets dafür festlegen können, um Qualität, Kosten und Reaktionszeit abzuwägen. Auch bei abgeschaltetem "Denken" sei die Leistung besser als bei 2.0 Flash. Mit "Denken" steigt der Preis für die Ausgabe zwar von 0,40 Cent auf 3,50 US-Dollar, ist aber immer noch deutlich günstiger als vergleichbare Modelle. Das zeigt, dass Google mit der Gemini-Reihe insbesondere den Preis-Leistungs-Sieger stellen will.

Read full article about: Google will mit Firebase Studio die App-Entwicklung mit KI erleichtern

Google hat mit Firebase Studio eine umfassende, Cloud-basierte Entwicklungsumgebung mit KI im Kern vorgestellt. Sie erweitert die Tool-Plattform Firebase um KI-Workspaces, in denen Entwickler komplette Full-Stack-Anwendungen, mobile Apps und Webseiten mit dem KI-Chat bauen können. Firebase Studio verknüpft dafür verschiedene Dienste, Plattformen und Schnittstellen und erzeugt neben der Programmlogik das UI, Backend, Frontend, mobile Apps, API-Schemata und Datenanbindungen. Neben einem klassischen Code-Editor bietet Firebase Studio einen Prototyp-Agenten, der komplett über natürliche Sprache oder Bilder wie Diagramme und UI-Skizzen gesteuert wird. Die KI baut dann eine Anwendung nach diesen Vorgaben eigenständig zusammen.