Das Videospiel "Lord of the Rings: Gollum" war so katastrophal, dass sich das Spielstudio und der Publisher dafür entschuldigen mussten. Dass diese Entschuldigung möglicherweise mit ChatGPT geschrieben wurde, ist nun ein Thema. Warum?

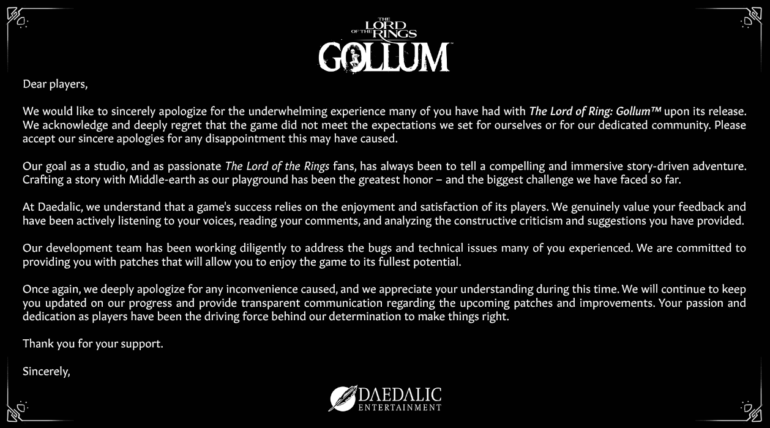

In den redaktionellen und sozialen Medien ist es in Überschriften und Threads zu lesen: Erst liefern das Spielestudio Daedalic Entertainment und der Publisher Nacon ein miserables Videospiel über einen der beliebtesten und bekanntesten Charaktere der Herr der Ringe-Saga ab. Danach soll Publisher Nacon über ChatGPT eine Entschuldigung verfasst haben, sagen Quellen von Game Two.

Wer das glauben will, findet Hinweise in einem Tippfehler, in der Antwort des Publishers steht "The Lord of Ring" statt "The Lord of the Rings" und in der Tatsache, dass die Antwort recht generisch klingt. Außerdem ist es mit ChatGPT recht einfach, ähnlich klingende generische Entschuldigungen zu generieren.

Das sind natürlich keine Beweise und laut Nacon wurde der Brief nicht mit ChatGPT geschrieben. Und das ist glaubwürdig, da die oben genannten Erkennungsmerkmale keine sind. Öffentlichkeitsarbeit ist oft allgemein und vage, um Türen offen zu halten und rechtliche Aspekte zu berücksichtigen. Und der Tippfehler deutet eher auf menschliches als auf maschinelles Eingreifen hin.

Tatsächlich kann ChatGPT mit ein paar Details im Prompt eine viel bessere Entschuldigung schreiben als die, die Nacon für Daedalic Entertainment veröffentlicht hat. Es schreibt auch "The Lord of the Rings: Gollum" richtig, weil es im Prompt steht. ChatGPT kann den Originaltitel nicht kennen, da das Spiel nach dem Ende der Trainingsdaten veröffentlicht wurde.

Dear Fans of Middle-earth,

I am writing this letter today not as a faceless development team but as fans, just like you, who are deeply passionate about the world J.R.R. Tolkien crafted. It is with a heavy heart that we address the widespread disappointment many of you have expressed regarding "The Lord of the Rings: Gollum."

We embarked on this journey with the vision of creating a unique narrative experience that would delve deeper into the life and struggles of one of Tolkien's most iconic characters. We hoped to provide fans with a new perspective, one that would enrich their understanding and appreciation of Middle-earth. However, based on your feedback, we fell short of the mark, and for that, we are truly sorry.

We acknowledge the shortcomings of the game, and we are taking your feedback seriously. Many have raised concerns about the game mechanics, story decisions, and overall quality, and we understand the pain these issues have caused, especially to a community as dedicated and passionate as this one. We never intended to tarnish the beloved legacy of "The Lord of the Rings."

Our commitment to you is twofold:

- We will immediately work on patches and updates to address some of the most pressing issues you've pointed out. While we cannot change every aspect of the game post-release, we promise to do our best to enhance your experience where we can.

- This experience has been a humbling lesson for us. Moving forward, we will be more cautious, more attentive, and more dedicated to preserving the integrity and spirit of Middle-earth in any future endeavors. We have learned the importance of not just understanding but truly respecting the source material and its fanbase.

We truly hope that in time, with your guidance and feedback, we can earn back your trust and deliver experiences that resonate with the depth, intricacy, and beauty of Tolkien's world.

From the deepest caverns of our hearts, we apologize. We are grateful for your passion and dedication, and we promise to strive for the standards that Middle-earth and its fans deserve.

Sincerely,

[Game Development Team Name]

ChatGPT heißt, sich keine Mühe zu geben

Viel interessanter ist die Frage: Warum ist es überhaupt wichtig, ob die Entschuldigung von ChatGPT geschrieben wurde? Es sollte doch nur wichtig sein, ob die Entschuldigung das wiedergibt, was die entschuldigende Instanz mitteilen will.

Niemand würde fragen, ob eine Entschuldigung von Hand, auf einem Laptop oder auf einem Desktop-Computer geschrieben wurde. Und es würde ausreichen, sich über den allgemeinen Inhalt und die Tippfehler zu ärgern, ohne ChatGPT zu erwähnen.

Warum ist es also wichtig, dass ChatGPT vielleicht als Schreibhilfe benutzt wurde?

Die Antwort gibt eine kürzlich veröffentlichte Studie: KI-generierte Nachrichten können Beziehungen schädigen, weil sie als "Abkürzung" und "Unaufrichtigkeit" wahrgenommen werden. Das gilt offenbar auch für die Kommunikation zwischen Unternehmen und ihren Kunden.

Die Frage bleibt, ob es sich dabei um ein vorübergehendes Problem handelt, das auf die Neuheit dieser Texttaschenrechner zurückzuführen ist und sich in Luft auflösen wird, wenn ihr Einsatz alltäglich wird.

Die Hauptautorin der Studie, Kommunikationsprofessorin Bingjie Liu von der Ohio State University, hält es jedoch für möglich, dass Menschen ein unbewusstes Verhalten entwickeln, bei dem sie Nachrichten nach KI-Mustern scannen und sie abwerten, wenn sie solche Muster erkennen. Sie bezeichnet diesen Vorgang als "Turing-Test im Kopf".