Claude Mythos ist ein Weckruf für Europas KI-Sicherheitsarchitektur

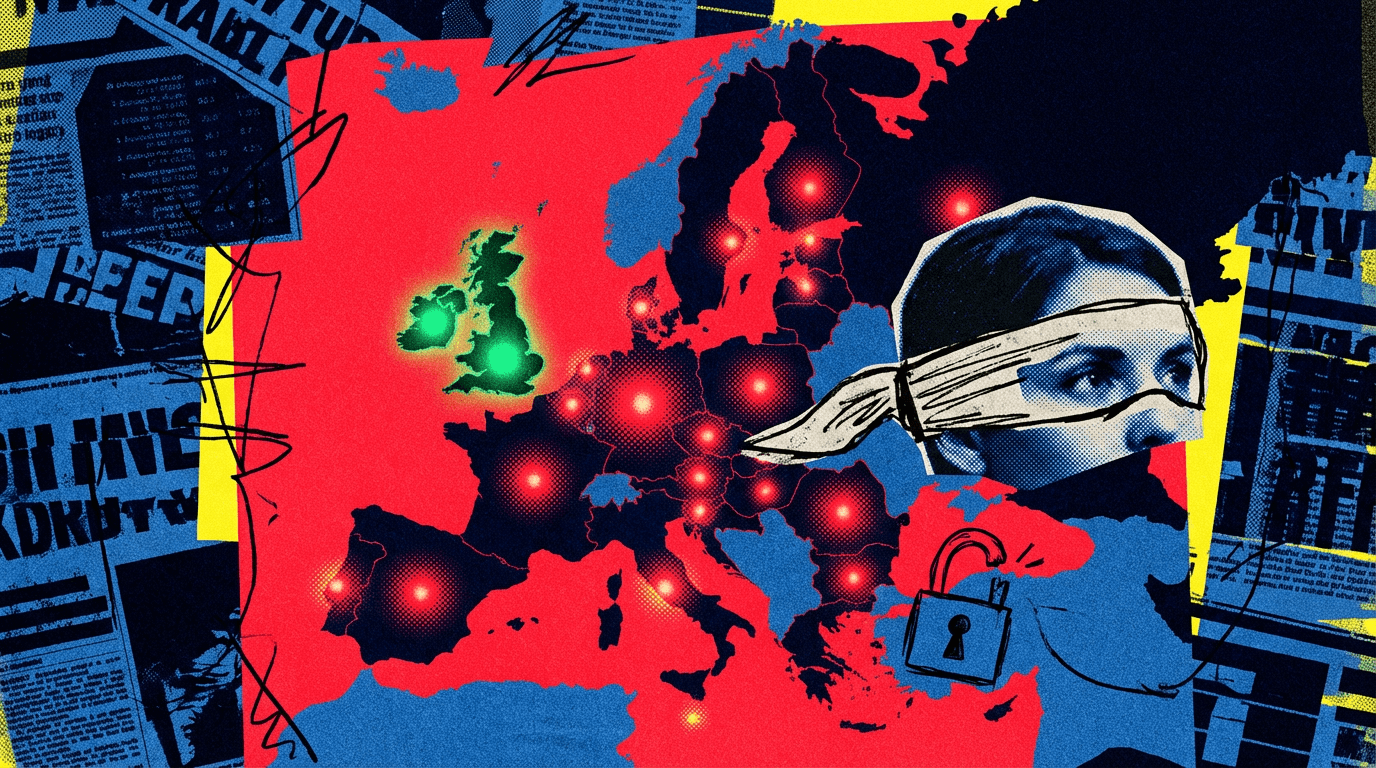

Anthropic beschränkt den Zugang zu seinem neuen KI-Modell Claude Mythos, das Schwachstellen besser als die meisten Menschen finden soll. Europäische Behörden haben kaum Einblick, während das Vereinigte Königreich bereits eigene Tests durchführt. Der Fall offenbart ein strukturelles Problem.

Anthropic hat vergangene Woche angekündigt, den Zugang zu seinem neuesten KI-Modell Claude Mythos Preview auf ausgewählte Technologiepartner zu beschränken: Es gibt einer Gruppe von Big-Tech- und Cybersicherheitsfirmen Zugang zu einer Preview-Version von Mythos, weil das Unternehmen befürchtet, dass das neue Modell beispiellose Cybersicherheitsrisiken bergen und die Wahrscheinlichkeit großflächiger KI-gestützter Cyberangriffe erhöhen könnte.

Im Rahmen des "Project Glasswing" genannten Programms wurden 12 US-Technologieunternehmen als engster Kreis handverlesen, darunter Apple, Microsoft und Amazon. Zugang erhielten demnach 40 weitere Organisationen, die Anthropic nicht namentlich nannte.

Europäische Regulierungsbehörden spielen in diesem Arrangement kaum eine Rolle.

Acht europäische Cyberbehörden, nur eine im Gespräch

POLITICO sprach laut eigenem Bericht mit Beamten von acht nationalen europäischen Cybersicherheitsbehörden. Nur die deutsche Behörde BSI gab an, Gespräche mit Anthropic über Mythos aufgenommen zu haben, ohne das Modell bisher direkt testen zu können. Andere europäische Regierungsinstitutionen verfügten offenbar nur über punktuelle Einblicke.

BSI-Chefin Claudia Plattner bezeichnete die Frage, ob Werkzeuge "von solch außergewöhnlicher Macht" wie Mythos künftig auf dem offenen Markt verfügbar sein werden, als "drängend". Diese Frage habe "tiefgreifende Implikationen für die nationale und europäische Sicherheit und Souveränität", so Plattner in einer Stellungnahme gegenüber POLITICO. Ihr BSI sei zwar in "aktivem Dialog" mit Anthropic, aber die Gespräche hätten bisher nur "aussagekräftigen Einblick" in die Funktionsweise geliefert, nicht aber direkten Zugang zum Testen.

Die EU-Cyberbehörde ENISA wollte sich nicht dazu äußern, ob sie mit Anthropic in Kontakt steht. Das AI Office der EU-Kommission führt zwar einen Dialog mit Anthropic im Rahmen des EU-Verhaltenskodex für KI-Modelle. Ob Mythos Teil dieser Gespräche ist und ob das Office Zugang erhalten hat, blieb unkommentiert.

Im scharfen Kontrast dazu steht das Vereinigte Königreich. UK-KI-Minister Kanishka Narayan bestätigte, dass das britische AI Security Institute (AISI) Mythos kürzlich getestet und bereits "Maßnahmen auf Grundlage unserer Erkenntnisse ergriffen" habe. Am Montag veröffentlichte das Institut seine Bewertung. Die Ergebnisse zeigen, dass Mythos Preview einen deutlichen Sprung gegenüber früheren Frontier-Modellen darstellt, in einer Landschaft, in der die Cyber-Leistung bereits rapide zunahm. Das AISI schränkt allerdings ein, dass es nicht mit Sicherheit sagen könne, ob Mythos auch gut verteidigte Systeme angreifen könnte.

Fehlende globale Aufsicht und Europas regulatorische Grenzen

Europas fehlender Zugang zu Mythos ist nicht nur ein Governance-Problem. Wer keine belastbaren technischen Details hat, kann Risiken nur eingeschränkt einschätzen und Schutzmaßnahmen schwerer priorisieren.

Daniel Privitera, Gründer der Berliner KI-Non-Profit-Organisation KIRA, sagte laut POLITICO, Mythos gebe "einen frühen Vorgeschmack darauf, wie entscheidend der Zugang zu Frontier-KI-Fähigkeiten in den kommenden Jahren sein wird". Europa habe derzeit keinen Plan, wie es sich diesen Zugang sichern könne.

KI-Pionier Yoshua Bengio nannte es gegenüber POLITICO "zutiefst besorgniserregend", dass Technologieunternehmen und nicht Regulierungsbehörden darüber entscheiden, wie mit den Risiken umgegangen wird. Es zeige, wie wichtig es sei, Wege für Regierungen oder Dritte zu schaffen, die Technologie zu überprüfen.

Die ehemalige Europaabgeordnete Marietje Schaake, die als Beraterin der EU-Kommission den Verhaltenskodex für KI-Entwickler mitgestaltete, bezeichnete es ebenfalls als "besorgniserregend", dass Modelle mit weitreichender Wirkung von einem privaten Unternehmen gesteuert werden. Jetzt sei ein guter Zeitpunkt, sich auf Offenlegungsregeln und Aufsichtsmechanismen zu einigen.

Die unabhängige KI-Forscherin Laura Caroli, die an der Ausarbeitung des EU AI Act beteiligt war, erklärte laut POLITICO, die EU sei "an die Seitenlinie gedrängt" worden, weil das Modell nicht auf dem Markt veröffentlicht werde. Würde es veröffentlicht, hätte Anthropic bindende Verpflichtungen nach EU-Recht. Allerdings stellt laut den EU-Leitlinien auch die interne Nutzung eines KI-Modells bereits ein Inverkehrbringen dar, wenn sie wesentlich für die Bereitstellung eines Produkts oder einer Dienstleistung auf dem Unionsmarkt ist oder die Rechte natürlicher Personen in der Union berührt.

Thomas Regnier, Sprecher der EU-Kommission für Digitales, sagte laut POLITICO, die Kommission "prüfe derzeit mögliche Implikationen" in Bezug auf EU-Gesetzgebung. Unter dem AI Act müssten Anbieter wie Anthropic Cyberrisiken ihrer Modelle adressieren, der Cyber Resilience Act schreibe zudem verbindliche Cybersicherheitsanforderungen für alle Produkte mit digitalen Elementen auf dem EU-Markt vor.

Warum Europa keinen Zugang hat und was das für die Zukunft bedeutet

Ist der fehlende Zugang zu Mythos ein Symptom europäischer Überregulierung? Die Gründe sind wohl komplexer. Anthropic hat den EU-Verhaltenskodex für allgemeine KI-Modelle unterzeichnet, ebenso Amazon, Google, IBM, Microsoft und OpenAI. An mangelnder Kooperationsbereitschaft liegt es also nicht.

Das Problem scheint eher ein fehlendes Gegenüber zu sein, das technisch auf Augenhöhe agieren kann. Das britische AI Security Institute, 2023 als Frontier AI Taskforce gegründet und 2025 umbenannt, verfügt über 100 Millionen Pfund öffentliche Finanzierung. In bemerkenswert kurzer Zeit hat es sich Zugang zur KI-Industrie verschafft, indem es Sicherheitstests durchführte und namhafte Forscher von OpenAI und Google DeepMind abwarb. Mindestens 16 Modelle hat es bisher getestet, darunter drei Frontier-Modelle vor deren öffentlichem Start. Es beschäftigt mehr als 100 technische Mitarbeitende und verfügt über die nötigen Beziehungen für frühzeitigen Zugang zu Spitzenmodellen.

Auf EU-Ebene gibt es mit dem AI Office zwar eine Stelle mit mehr als 125 Mitarbeitenden und einer eigenen Safety-Einheit. Doch noch im Herbst vergangenen Jahres kämpfte das Büro laut Transformer News mit erheblichen Rekrutierungsproblemen. Zentrale Führungspositionen waren nicht besetzt. Starre Gehaltsstrukturen böten kaum Spielraum für Talente aus dem Privatsektor, so der EU-Personalexperte András Baneth. Der Einstellungsprozess dauere durch interne Bürokratie mehrere Monate, sodass Kandidaten zwischenzeitlich andere Stellen annehmen. Das britische Pendant könne dagegen übertariflich zahlen.

Einzelne EU-Staaten haben parallel eigene Strukturen aufgebaut: Frankreich startete Anfang 2025 mit INESIA ein Institut für KI-Bewertung und -Sicherheit, Spanien überwacht mit der AESIA den sicheren Einsatz von KI.

Der Fall Mythos ist insofern weniger ein Beleg für Überregulierung als vielmehr eine strukturelle Altlast: Europa ist bei Rechenkapazität, Wachstumskapital, eigenen Frontier-Laboren und sicherheitsnaher Evaluierung schwächer aufgestellt. All das beeinflusst den Pool an Talent und Einfluss, der für solche Untersuchungen nötig wäre. Seit GPT-3 gab es einige solcher Weckrufe. Immerhin lässt sich festhalten: Europa ist nicht mehr im Modus völliger Verweigerung. Ob das reicht, wenn das nächste Modell dieser Klasse nicht von Anthropic kommt, sondern etwa von DeepSeek, steht auf einem anderen Blatt.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.